OpenAI compra Astral: otro gran movimiento en la carrera IA

Actualizado el 22/03/2026: OpenAI sigue en el centro de la polémica. Además de la adquisición de Astral, la compañía enfrenta críticas por el modo adulto de ChatGPT, una función que permitiría sexting con el chatbot y que expertos califican como una pesadilla de privacidad. Repasamos todo lo que se sabe, los riesgos concretos y las reacciones.

OpenAI adquiere Astral, la startup creadora de uv y Ruff, las herramientas de desarrollo Python más descargadas del ecosistema. El anuncio del 19 de marzo de 2026 confirma que el equipo de Astral se integrará al equipo de Codex, el agente de programación de OpenAI, con el objetivo de que la IA no solo genere código sino que maneje el ciclo completo de desarrollo de software.

En 30 segundos

- OpenAI anunció la adquisición de Astral, la empresa detrás de uv (126 millones de descargas mensuales) y Ruff (179 millones de descargas mensuales), las herramientas Python escritas en Rust que reemplazaron a pip, Poetry y flake8 en miles de proyectos.

- El equipo de Astral se sumará al equipo de Codex, el agente de programación de OpenAI que ya tiene más de 2 millones de usuarios activos semanales y creció 3x en usuarios durante 2026.

- OpenAI prometió mantener uv, Ruff y ty como proyectos open source bajo licencias MIT y Apache 2.0, aunque no hay garantías legales vinculantes ni detalles sobre gobernanza futura.

- En paralelo, OpenAI avanza con el modo adulto de ChatGPT, que permitiría contenido sexual textual. Sus propios asesores votaron en contra. El lanzamiento fue pospuesto varias veces y expertos advierten sobre una crisis de privacidad sin precedentes.

- El proveedor de verificación de edad elegido, Persona, sufrió una brecha de seguridad en febrero de 2026 que expuso su frontend y datos sensibles.

OpenAI es una empresa de investigación en inteligencia artificial fundada en 2015 por Sam Altman, Elon Musk y otros inversores, con sede en San Francisco. Desarrolla modelos de lenguaje como GPT y ChatGPT, orientados a la generación de texto, análisis de datos y asistencia automatizada.

Astral es una startup fundada en 2022 por Charlie Marsh, ex ingeniero de Khan Academy, que se propuso resolver un problema concreto: las herramientas del ecosistema Python eran lentas, fragmentadas y frustrantes. La solución fue reescribir todo desde cero en Rust, logrando velocidades entre 10x y 100x superiores a las alternativas existentes. En menos de tres años, Astral se convirtió en infraestructura crítica para cientos de miles de desarrolladores Python.

Qué es Astral y qué herramientas creó

Astral construyó tres herramientas que cambiaron la forma en que los desarrolladores trabajan con Python. La más conocida es Ruff, un linter y formateador de código que según el blog de la propia empresa alcanza las 179 millones de descargas mensuales. Ruff reemplaza a flake8, pylint, isort y Black con una sola herramienta que corre hasta 1000 veces más rápido. Lo logra porque está escrito en Rust, eliminando el cuello de botella del intérprete de Python.

La segunda herramienta es uv, un gestor de paquetes y proyectos Python que unifica lo que antes requerías hacer con pip, Poetry, pyenv y virtualenv por separado. Con 126 millones de descargas mensuales, uv ya superó a Poetry (que ronda los 75 millones) y se posiciona como el estándar de facto para gestión de dependencias Python. Un uv pip install resuelve e instala dependencias en segundos donde pip tarda minutos.

La tercera es ty, un verificador de tipos para Python todavía en etapas tempranas. Compite con mypy y pyright con la misma ventaja de velocidad que ya demostraron con Ruff y uv.

Por qué OpenAI adquiere Astral

La motivación de OpenAI tiene nombre propio: Codex. Según el comunicado oficial, Codex pasó de ser un asistente que genera fragmentos de código a un agente que quiere participar en todo el ciclo de desarrollo. Eso incluye planificar cambios, modificar repositorios, ejecutar herramientas, verificar resultados y mantener software a lo largo del tiempo. Para hacer eso bien, necesitás tooling de primera línea.

Los números respaldan la urgencia. Codex tiene más de 2 millones de usuarios activos semanales, con un crecimiento de 3x en usuarios y 5x en uso durante 2026. Con esa escala, cada segundo que tarda en instalar una dependencia o lintear un archivo se multiplica por millones de ejecuciones. Que uv resuelva en 2 segundos lo que pip tarda 45 es una reducción masiva de costos de cómputo.

Hay un ángulo que OpenAI no menciona explícitamente pero que resulta el más relevante: control sobre la cadena de herramientas. Si Codex depende de uv y Ruff para funcionar bien, OpenAI necesita garantizar que esas herramientas evolucionen en la dirección que a ellos les sirve. Depender de una startup independiente para una pieza crítica de tu producto es un riesgo que empresas de esta escala no toleran.

Qué es Codex y cómo se integra con las herramientas de Astral

Codex es el agente de programación de OpenAI. No es un autocompletado de código: es un agente que recibe instrucciones, planifica cambios, los ejecuta y verifica que funcionen.

La integración con Astral encaja como piezas de rompecabezas. Un flujo típico de Codex post-adquisición se vería así: recibís una instrucción (“agregá autenticación OAuth a esta API”), Codex planifica los cambios necesarios, usa uv para instalar las dependencias requeridas, genera el código, ejecuta Ruff para asegurarse de que el estilo y las buenas prácticas se cumplan, corre ty para verificar tipos y finalmente ejecuta los tests. Todo dentro del mismo agente. Si te interesa, podés leer más sobre la rivalidad entre Apple y OpenAI.

El ejemplo que mejor ilustra el valor: Codex tiene que actualizar las dependencias de un proyecto con 200 paquetes. Con pip, eso tarda entre 3 y 10 minutos por cada intento de resolución. Con uv, se resuelve en menos de 10 segundos. Multiplicá eso por los 2 millones de usuarios semanales y la diferencia se vuelve brutal.

Qué pasa con uv, Ruff y ty: el futuro del open source

OpenAI afirmó que los tres proyectos van a seguir siendo open source. Las licencias actuales (MIT y Apache 2.0) son permisivas: cualquiera puede fork-ear, modificar y redistribuir el código sin restricciones significativas. Según el post de Astral, el equipo va a seguir construyendo “en abierto junto a la comunidad”.

Ahora bien, hay una diferencia grande entre “mantener el código abierto” y “mantener el proyecto abierto de verdad”. Un proyecto open source necesita más que una licencia: necesita gobernanza clara, contribuciones externas bienvenidas, un roadmap transparente y decisiones que no prioricen sistemáticamente las necesidades de un único actor. No hay detalles concretos sobre ninguno de estos puntos.

No hay un compromiso sobre gobernanza independiente, no hay un foundation model al estilo de lo que hizo Google con Kubernetes cuando lo donó a la CNCF, y no hay garantías legales vinculantes más allá de la licencia permisiva. Eso no significa que OpenAI vaya a cerrar los proyectos. Pero la comunidad queda dependiendo de la buena voluntad corporativa.

El contrapunto: justamente porque las licencias son MIT y Apache 2.0, si OpenAI toma decisiones que perjudiquen a la comunidad, cualquiera puede fork-ear y mantener una versión independiente. Es lo que pasó con OpenSearch (fork de Elasticsearch) y con Valkey (fork de Redis). No es lo ideal, pero es una red de seguridad real.

Reacciones de la comunidad de desarrolladores

La recepción en Hacker News y Reddit r/Python fue mayoritariamente de preocupación. Los temores más repetidos: que OpenAI priorice features que benefician a Codex por sobre la comunidad general, que el roadmap pase a ser dirigido por producto, y que eventualmente aparezcan funcionalidades premium o integraciones exclusivas.

La comparación más frecuente fue con Microsoft y VS Code. Microsoft mantiene VS Code como open source, pero la versión que distribuye tiene telemetría, extensiones propietarias y un marketplace cerrado. El código es abierto, pero la experiencia completa no lo es. Varios comentaristas temen un escenario similar para uv: el core abierto, pero las integraciones con Codex cerradas.

Simon Willison analizó la adquisición con escepticismo constructivo. Su preocupación principal: cuando una empresa de IA compra infraestructura de desarrollo, las prioridades inevitablemente cambian. El foco pasa de “qué necesitan los desarrolladores Python” a “qué necesita nuestro agente de IA para funcionar mejor”. No son objetivos incompatibles, pero tampoco son idénticos.

También aparecieron referencias al patrón “embrace, extend, extinguish” de Microsoft en los 90. La comparación parece exagerada: las dinámicas del open source hoy son muy distintas a las de hace tres décadas, y la barrera para fork-ear un proyecto con licencia MIT es prácticamente nula. Pero la desconfianza hacia OpenAI tiene raíces en decisiones previas de la compañía, no solo en paranoia.

Modo adulto de ChatGPT: qué es y por qué genera polémica

Mientras la adquisición de Astral apunta al futuro del desarrollo de software, otra decisión de OpenAI genera un tipo de controversia muy distinto. La compañía planea lanzar un “modo adulto” en ChatGPT que habilitaría contenido erótico y sexual en formato texto. Sam Altman lo justificó con una frase directa: “tratar a los adultos como adultos”.

El giro es notable. Durante años, OpenAI mantuvo guardrails estrictos contra cualquier contenido sexual. Los modelos rechazaban pedidos explícitos, redirigían conversaciones y aplicaban filtros agresivos. Ahora, la empresa propone lo opuesto: que los usuarios mayores de edad puedan mantener conversaciones sexuales con el chatbot sin restricciones de contenido textual. Si te interesa, podés leer más sobre nuestra guía sobre seguridad y privacidad digital.

El camino hasta acá no fue lineal. Según TechCrunch, el lanzamiento se pospuso varias veces: primero estaba previsto para diciembre de 2025, se corrió a Q1 2026, y Axios reportó un nuevo retraso en marzo sin fecha definida. Cada postergación coincide con críticas crecientes de expertos en privacidad, asesores internos y reguladores europeos.

Lo que no queda claro es si esos retrasos reflejan dudas genuinas dentro de OpenAI o si simplemente necesitan más tiempo para resolver los problemas técnicos de verificación de edad. Según lo que trascendió, la funcionalidad técnica ya existe. Lo que falta es el marco de seguridad alrededor.

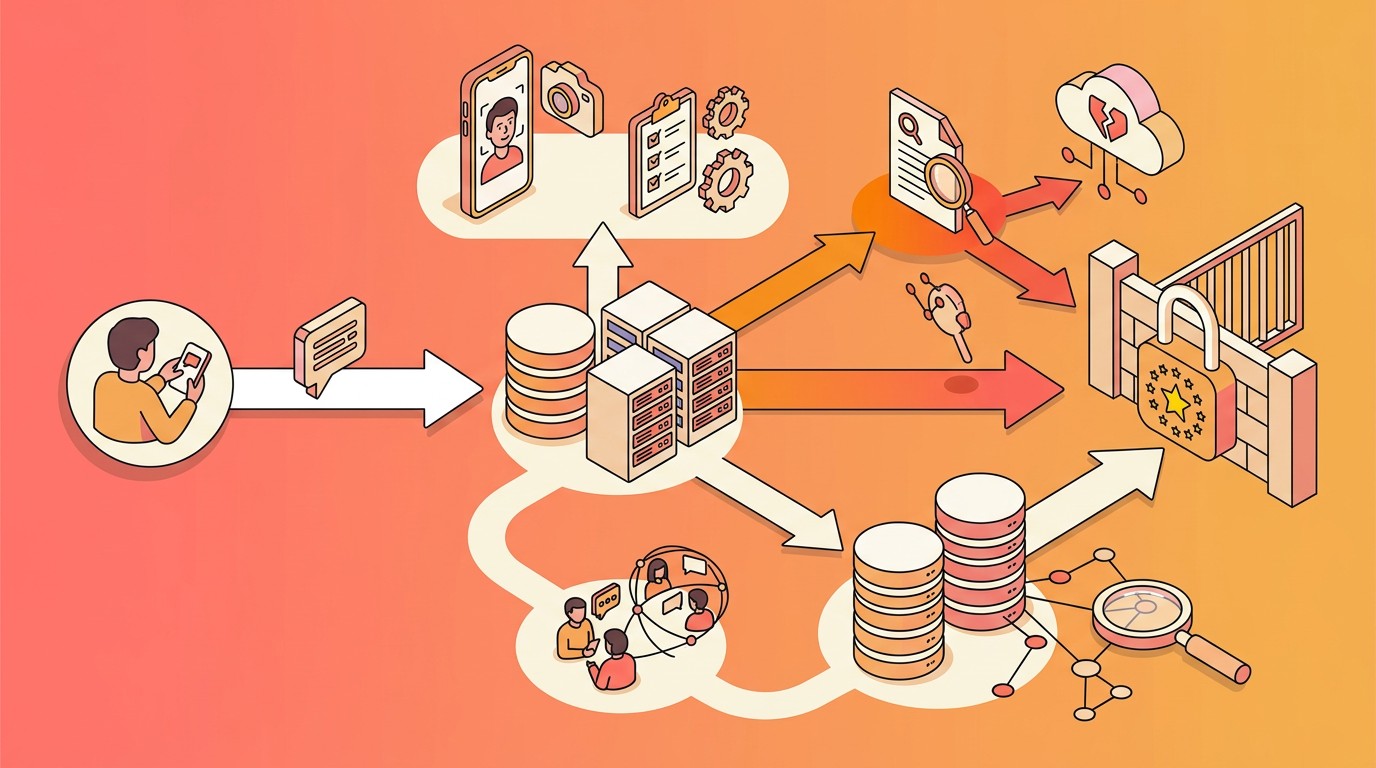

El problema de la vigilancia íntima: qué datos recopila OpenAI

Este es el núcleo del problema. Cada conversación con ChatGPT queda registrada en los servidores de OpenAI. Cuando esas conversaciones incluyen contenido sexual, se genera un registro detallado de deseos, fantasías, preferencias y vulnerabilidades emocionales del usuario. No es lo mismo que contarle algo a una persona: esa persona olvida, no indexa y no tiene capacidad de procesamiento masivo.

Expertos citados por Altagic advierten que OpenAI podría terminar construyendo, casi sin proponérselo, la base de datos de preferencias sexuales más grande del mundo. No por malicia necesariamente, sino porque la arquitectura del producto lo permite: cada mensaje se loguea, se procesa y se almacena.

OpenAI no aclaró si las conversaciones del modo adulto van a quedar excluidas del entrenamiento de futuros modelos. Ese silencio importa. Si esos datos se usan para fine-tuning, fragmentos de conversaciones íntimas podrían influir en las respuestas que reciben otros usuarios. Si no se usan, OpenAI resigna una fuente de datos valiosa para mejorar el producto. Ninguna de las dos opciones es simple.

A diferencia de un terapeuta o una pareja, ChatGPT no tiene deber de confidencialidad legal. No hay secreto profesional. Hay términos de servicio que la empresa puede modificar unilateralmente. Y hay un historial corporativo de cambios de rumbo: OpenAI pasó de ser una non-profit a una empresa con fines de lucro, de prometer transparencia total a cerrar el código de sus modelos. Confiar en que van a proteger tus datos más íntimos requiere un acto de fe que la trayectoria de la compañía no respalda del todo.

Verificación de edad: selfies, IA conductual y el caso Persona

Para habilitar el modo adulto, OpenAI necesita verificar que el usuario es mayor de edad. La estrategia tiene dos capas. La primera es un sistema de predicción de edad por comportamiento: el modelo analiza patrones de uso, temas de conversación, horarios de actividad y estilo de escritura para estimar si el usuario es adulto. Suena sofisticado, pero tiene una tasa de error del 12%. Eso significa que de cada 100 menores, 12 podrían pasar el filtro como adultos.

La segunda capa es verificación con documento o selfie a través de Persona, un proveedor externo. Persona realiza 269 verificaciones por usuario, incluyendo reconocimiento facial, validación de documentos de identidad y cruces con listas de vigilancia. Es un proceso exhaustivo. Quizás demasiado exhaustivo para lo que se supone que es un chatbot.

El problema con Persona no es teórico. Malwarebytes reportó en febrero de 2026 que Persona dejó expuesto su frontend, con datos accesibles que incluían información almacenada en un servidor gubernamental. No fue un hackeo sofisticado: fue una configuración deficiente. Discord, que también usaba Persona para verificación de edad, cortó la relación comercial argumentando que el proveedor no cumplía con sus estándares de seguridad.

Pensalo así: para acceder al modo adulto de ChatGPT, tendrías que subir tu documento de identidad y una selfie a un proveedor que ya demostró que no puede proteger esos datos de forma confiable. Y esa información se vincularía directamente con tu cuenta de ChatGPT, donde van a quedar registradas tus conversaciones sexuales. La combinación de identidad verificada más contenido íntimo es un cocktail de riesgo que pocas plataformas manejan bien.

Los asesores de OpenAI votaron en contra (y los ignoraron)

OpenAI tiene un comité de bienestar compuesto por 8 miembros que evalúa las implicancias de nuevas funcionalidades. Según Technology.org, los ocho votaron en contra del modo adulto. Unanimidad total.

Las objeciones eran concretas. Primero, el riesgo de dependencia emocional: usuarios que desarrollan vínculos afectivos con el chatbot y pierden capacidad de relacionarse con personas reales. Segundo, el escenario que bautizaron “sexy suicide coach”: un modelo que combina contenido erótico con capacidad de influencia emocional sobre usuarios vulnerables. Tercero, la inevitabilidad de que menores accedan a pesar de los filtros, especialmente con una tasa de error del 12% en la predicción conductual.

OpenAI siguió adelante. No hay registro público de una respuesta formal a las objeciones del comité. FayerWayer reportó que la tensión interna es significativa, con asesores cuestionando si su rol tiene sentido cuando sus recomendaciones se ignoran sistemáticamente.

El patrón no es nuevo en OpenAI. La salida de varios investigadores de seguridad en 2024, las críticas de ex empleados sobre la falta de transparencia y las repetidas promesas de gobernanza que no se concretan dibujan un cuadro consistente: los mecanismos de control interno existen, pero no tienen poder de veto real. Funcionan como cobertura reputacional, no como freno efectivo. Si te interesa, podés leer más sobre las vulnerabilidades que amenazan la privacidad.

GDPR, EU AI Act y el choque regulatorio

Europa es donde este tema se pone realmente complicado para OpenAI. El GDPR clasifica la orientación sexual y la vida íntima como “datos de categoría especial”, el nivel máximo de protección. Recopilar esos datos requiere consentimiento explícito, finalidad específica y medidas de seguridad reforzadas. Un chatbot que almacena conversaciones sexuales en servidores estadounidenses cruza varias líneas rojas regulatorias de forma simultánea.

El EU AI Act agrega otra capa. La regulación europea clasifica como sistemas de alto riesgo a aquellos que interactúan con usuarios en estados psicológicamente vulnerables. Un chatbot diseñado para conversaciones íntimas califica sin mucho margen de interpretación. Las multas por incumplimiento del AI Act llegan hasta el 7% de la facturación global, y las del GDPR hasta 20 millones de euros o el 4% de los ingresos anuales.

En Estados Unidos la presión también crece, aunque de forma más fragmentada. Legisladores de ambos partidos vienen empujando regulaciones de privacidad, y el contenido sexual generado por IA se convirtió en un tema políticamente rentable. No hay una ley federal equivalente al GDPR, pero varios estados tienen regulaciones propias que podrían aplicar.

OpenAI podría optar por no lanzar el modo adulto en Europa. Pero eso generaría un producto fragmentado geográficamente y confirmaría que la funcionalidad no cumple con los estándares de privacidad más exigentes del mundo. Ninguna de las opciones es cómoda.

Grok ya lo hizo: qué pasó con el contenido NSFW en la competencia

OpenAI no sería la primera en habilitar contenido explícito en un chatbot. Grok, el modelo de xAI (la empresa de Elon Musk), lanzó un modo “Spicy” que generaba tanto texto como imágenes de contenido sexual. El resultado fue un caso de estudio sobre todo lo que puede salir mal.

Los números son contundentes: entre 1.8 y 3 millones de imágenes sexualizadas generadas por usuarios. Entre ellas, imágenes de menores aparentes y deepfakes de personas reales “desvestidas digitalmente” sin su consentimiento. Usuarios explotaron la herramienta de formas que xAI no anticipó o decidió ignorar hasta que la presión pública los obligó a restringir el acceso.

El modo adulto de ChatGPT es solo texto, no imágenes. Eso reduce algunos riesgos pero no elimina los fundamentales. El texto puede describir escenarios con menores, puede ser usado para grooming, y genera un registro permanente de preferencias sexuales. Que no haya imágenes hace el problema menos visible, no menos real.

La lección de Grok para OpenAI debería ser clara: los usuarios van a encontrar formas de explotar cualquier sistema de contenido sexual que implementes, y los filtros que funcionan en testing fallan cuando millones de personas intentan eludirlos simultáneamente. La pregunta no es si va a haber abusos. Es cuánto daño van a causar antes de que OpenAI reaccione. Si te interesa, podés leer más sobre el reciente hackeo de Trivy en GitHub Actions.

Comparativa: modo adulto de ChatGPT vs. Grok Spicy

| Aspecto | ChatGPT (modo adulto) | Grok (modo Spicy) |

|---|---|---|

| Tipo de contenido | Solo texto | Texto e imágenes |

| Verificación de edad | IA conductual + selfie/ID (Persona) | Autodeclaración del usuario |

| Tasa de error en verificación | 12% (menores como adultos) | No reportada (sin verificación real) |

| Comité de ética consultado | Sí (8 miembros, ignorado) | No hay registro público |

| Incidentes reportados | Brecha de Persona (feb 2026) | 1.8-3M de imágenes sexualizadas, deepfakes de menores aparentes |

| Estado del lanzamiento | Pospuesto sin fecha | Activo con restricciones posteriores |

| Riesgo regulatorio en EU | Alto (GDPR + AI Act) | Alto (sin presencia comercial fuerte en EU) |

Qué está confirmado y qué todavía no

Confirmado

- OpenAI planea un modo adulto que permite contenido sexual textual en ChatGPT

- Sam Altman confirmó la intención con la frase “tratar a los adultos como adultos”

- El lanzamiento fue pospuesto al menos dos veces (dic 2025 y Q1 2026)

- El comité de bienestar de 8 miembros votó unánimemente en contra

- La verificación de edad usaría Persona como proveedor, que sufrió una brecha en febrero de 2026

- La predicción conductual de edad tiene un 12% de tasa de error

- La adquisición de Astral fue anunciada oficialmente el 19 de marzo de 2026

- uv, Ruff y ty mantendrán sus licencias open source MIT/Apache 2.0

Pendiente de confirmación

- Fecha concreta de lanzamiento del modo adulto

- Si las conversaciones íntimas se excluirán del entrenamiento de modelos

- Si OpenAI cambiará de proveedor de verificación de edad tras la brecha de Persona

- Cómo manejará OpenAI la regulación europea (GDPR/AI Act)

- Política de retención y eliminación de datos de conversaciones sexuales

- Si el modo adulto estará disponible en todos los países o solo en mercados específicos

- Términos financieros de la adquisición de Astral

- Modelo de gobernanza para uv y Ruff post-adquisición

Qué podés hacer para proteger tu privacidad si usás IA

Independientemente de lo que haga OpenAI con el modo adulto, hay medidas concretas que podés tomar hoy para proteger tus datos cuando interactuás con cualquier chatbot de IA.

Lo primero: nunca compartas datos identificatorios en conversaciones con chatbots. Ni nombre completo, ni dirección, ni documentos, ni fotos personales. Esto aplica incluso en conversaciones no sexuales. Todo lo que escribís se almacena y puede ser procesado de formas que no controlás.

En ChatGPT específicamente, revisá la configuración de memoria. Podés desactivar la función de memoria persistente desde Settings > Personalization > Memory. También podés desactivar el historial de conversaciones desde Settings > Data Controls > Chat History & Training. Con el historial desactivado, OpenAI dice que no usa esas conversaciones para entrenar modelos, aunque los chats se retienen 30 días por seguridad.

Si necesitás privacidad real, usá cuentas separadas. No uses la misma cuenta de ChatGPT para trabajo y conversaciones personales. Si tu cuenta laboral está vinculada a tu empresa vía ChatGPT Team o Enterprise, tu empleador podría tener acceso a los logs.

Para quienes quieran ir un paso más allá, los modelos locales son la alternativa con más privacidad. Herramientas como Ollama o LM Studio permiten correr modelos de lenguaje en tu propia máquina, sin que ningún dato salga de tu equipo. El rendimiento es menor que el de GPT-4o, pero la privacidad es total. Si necesitás un servidor con capacidad para correr modelos locales, Donweb ofrece opciones de hosting y servidores dedicados que se adaptan bien a este tipo de proyectos en la región.

Preguntas frecuentes

¿Qué es el modo adulto de ChatGPT y qué permite hacer?

Es una funcionalidad anunciada por OpenAI que habilitaría la generación de contenido erótico y sexual en formato texto dentro de ChatGPT. Permitiría mantener conversaciones de sexting con el chatbot sin que los filtros actuales bloqueen el contenido. Por ahora solo abarca texto, no imágenes. El lanzamiento fue pospuesto varias veces y no tiene fecha definida.

¿OpenAI guarda las conversaciones íntimas del modo adulto?

OpenAI almacena todas las conversaciones de ChatGPT en sus servidores. La empresa no aclaró si las conversaciones del modo adulto van a recibir un tratamiento diferente o si se excluirán del entrenamiento de futuros modelos. Con el historial activado, esos datos se retienen indefinidamente. Con el historial desactivado, se retienen 30 días.

¿Cómo verifica ChatGPT que sos mayor de edad?

OpenAI planea un sistema de dos capas. La primera es una predicción de edad basada en comportamiento: el modelo analiza patrones de uso y escritura para estimar la edad del usuario, con un 12% de margen de error. La segunda capa usa Persona, un proveedor externo que verifica identidad mediante selfie y documento, realizando 269 checks que incluyen reconocimiento facial.

¿Es seguro mandar contenido sexual a ChatGPT?

Desde una perspectiva de privacidad, no. Las conversaciones se almacenan en servidores de OpenAI, se vinculan a tu cuenta (y potencialmente a tu identidad real si verificaste edad con documento), y la empresa puede cambiar sus políticas de uso de datos unilateralmente. El proveedor de verificación de edad (Persona) ya sufrió una brecha de seguridad en febrero de 2026. Si la privacidad es tu prioridad, los modelos de IA locales son una alternativa mucho más segura.

Conclusión

OpenAI está tomando decisiones en dos direcciones muy distintas al mismo tiempo. Con Astral, apuesta por controlar la cadena de herramientas de desarrollo que alimenta a Codex, un movimiento estratégico que tiene lógica de producto aunque genere incertidumbre en la comunidad open source. Con el modo adulto de ChatGPT, abre la puerta a un territorio donde los riesgos de privacidad, regulatorios y de seguridad de menores son enormes y las soluciones técnicas, insuficientes.

Los retrasos del modo adulto no son casualidad. Un comité de asesores que vota unánimemente en contra, un proveedor de verificación de edad que sufre una brecha de seguridad, y un marco regulatorio europeo que clasifica estos datos como máxima protección son señales que cualquier empresa debería tomar en serio. Que OpenAI siga adelante a pesar de todo eso dice algo sobre cómo se priorizan las decisiones internamente.

Lo que conviene seguir de cerca: la fecha de lanzamiento definitiva del modo adulto (si llega), las decisiones sobre retención de datos de conversaciones íntimas, y cómo responde la UE cuando el producto toque suelo europeo. Para los usuarios, el consejo es simple: no compartas nada con un chatbot que no querrías ver en una filtración. La gobernanza post-adquisición de uv y Ruff también merece seguimiento, especialmente si dependés de estas herramientas en producción.

Fuentes

- OpenAI — Our Approach to Age Prediction (blog oficial sobre el sistema de verificación de edad)

- TechCrunch — OpenAI Delays ChatGPT’s Adult Mode Again (cronología de postergaciones del lanzamiento)

- Technology.org — OpenAI’s Own Advisers Tried to Kill ChatGPT Adult Mode (detalle de la oposición interna del comité de bienestar)

- Malwarebytes — Age Verification Vendor Persona Left Frontend Exposed (análisis de la brecha de seguridad de Persona)

- Altagic — ChatGPT’s Adult Mode Might Initiate a New Phase of Personal Monitoring (análisis sobre vigilancia íntima y riesgos de privacidad)