Testing Predictivo: Cuando la IA Revoluciona el QA

Testing predictivo con inteligencia artificial cambió cómo funcionan los equipos de QA. En lugar de esperar a que algo falle en producción, el testing predictivo anticipa problemas usando machine learning sobre datos históricos. Según el análisis de Srikantha Kavuri publicado en dev.to, esto significa pasar de preguntarse “¿falló algo?” a “¿qué es probable que falle después?” El resultado: 70% menos mantenimiento de scripts, mejor estabilidad de pipelines, y defectos detectados antes de tocar producción.

En 30 segundos

- Testing predictivo usa IA/ML para anticipar defectos en lugar de reaccionar cuando fallan.

- Las limitaciones del testing tradicional (mantenimiento alto, detección tardía) se resuelven con análisis predictivo.

- 68% de las organizaciones ya invierten en IA generativa para QA según reportes 2026.

- Self-healing automático repara scripts cuando el código cambia, reduciendo mantenimiento hasta 70%.

- Implementar testing predictivo requiere datos históricos, integración CI/CD y feedback loops continuos.

Del testing reactivo al predictivo: la evolución de la calidad

Ponele que trabajás en un equipo que produce código todos los días. Subís cambios a producción, probás lo que podés localmente, y confías en que pasó los tests. Todo OK hasta que llega el sábado a las 3 de la mañana y alguien te llama: algo se rompió. El log muestra una query que nunca viste, datos faltantes, un edge case que “nadie contempló”.

Eso es testing reactivo. Esperas a que algo reviente. Luego correís detrás del problema.

Testing predictivo es lo opuesto. Entrenan modelos de machine learning con dos años de historia: cada commit, cada test que pasó, cada defecto que encontraron, logs, cambios en dependencias. El modelo aprende patrones. Cuando alguien abre un pull request nuevo, el sistema dice: “dado tu cambio, estas tres cosas tienen 85%, 62% y 41% de chance de romperse.” Vos las probás específicamente antes de merge.

Las limitaciones del testing tradicional están documentadas: detección tardía de defectos (recién ven problemas cuando llegan a QA o producción), mantenimiento brutal de scripts de automatización cuando el código cambia, visibilidad limitada en sistemas distribuidos y microservicios, dificultad para testear arquitecturas complejas. Cada una de esas es un dolor real que cualquiera que haya mantenido tests en una empresa grande conoce (ojo con esto, porque es donde falla la mayoría).

Qué es Predictive Quality Engineering

Predictive Quality Engineering es un enfoque de testing moderno que usa AI y machine learning para pronosticar defectos, riesgos y fallos antes de que impacten producción. No es solo “tests automáticos más rápidos”. Es entrenar modelos que entienden tu código, tus fallos históricos y tus patrones de cambio, luego usar eso para decirte qué revisar con cuidado antes de desplegar.

La pregunta cambió. ¿Cuál es la diferencia? En testing antiguo preguntabas: “¿pasó el test?”. En predictivo preguntas: “¿qué es probable que falle después—y por qué?”.

Eso importa porque mueves el problema hacia la izquierda en el pipeline. En lugar de encontrar bugs cuando el QA está testeando (ayer), o peor, cuando está en producción (ayer por 100), los agarrás cuando estás escribiendo el PR. Es el mismo bug, pero lo ves el mismo día que lo introdujiste, no tres semanas después.

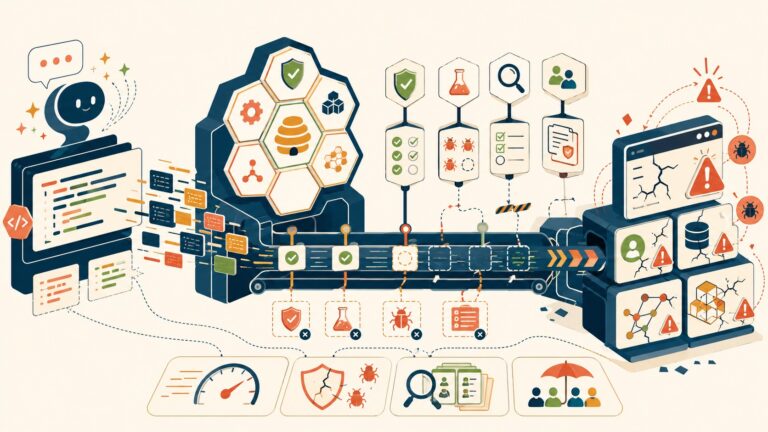

Las capas de un sistema de testing impulsado por IA

Un sistema de testing predictivo tiene arquitectura clara. Según los componentes documentados, arranca con una Data Collection Layer que recopila test results, cambios de código (commits, pull requests) y logs del sistema.

Luego viene Feature Engineering. Transforman datos brutos en features que un modelo pueda entender: “en los últimos 10 commits, ¿cuántos cambios tocaron la clase de autenticación?”, “¿cuántos tests fallaron en esa ruta últimamente?”, “¿ese developer suele introducir bugs?”. El modelo aprende de patrones históricos.

Después está el modelo predictivo mismo. Recibe features nuevas (un PR acaba de llegar), compara con su historia aprendida, y devuelve probabilidades. El usuario ve: “Line 245, función processPayment: 78% de chance de defecto basado en cambios similares anteriores.” Relacionado: agentes de testing que corren localmente.

Self-healing y análisis predictivo: las tecnologías clave

Self-healing es uno de los beneficios que más cambian el juego. Los tests automáticos modernos sufren un problema brutal: cuando cambias la estructura del HTML, cambias names de elementos, o refactorizás, los selectores de los tests se rompen. Tenés un script que dice “clickeá el botón con id=’submit_btn'” y alguien refactoriza el HTML. Boom, test roto, mantenimiento infinito.

Self-healing automático usa visión por computadora y ML para entender “el botón que estoy buscando” en lugar de “ese id específico”. Cuando el código cambia, el modelo entiende que es el mismo elemento, reconoce su posición visual, comportamiento, contexto. El script se auto-repara sin que toques nada. Eso reduce mantenimiento de tests entre 50% y 70%.

Análisis predictivo de defectos va más allá. Rastreás todos tus fallos históricos: qué tipo de código genera bugs más frecuentemente, qué cambios correlacionan con crashes, qué patterns recurren. Un modelo entrenado en eso te dice: “este tipo de change siempre causa problemas”.

Herramientas y plataformas para testing predictivo

El mercado hoy tiene herramientas especializadas por categoría. Acá están las principales.

Validación visual con IA

Applitools es el jugador dominante en visual testing. Usan deep learning para comparar pantallazos, detectan cambios visuales reales vs ruido. Precio: desde USD 500/mes en planes empresariales. Integra con Selenium, Cypress, Playwright.

Generación autónoma de tests

Blinq.io genera tests automáticamente desde tus especificaciones. El modelo entiende qué testear. Mabl hace lo similar pero agrega ML para entender flujos complejos. Ambas reducen el tiempo de escritura de tests entre 60% y 80%.

Self-healing automático

Perfecto (Perforce) es quizá la herramienta más avanzada en self-healing. Integra en tu pipeline, repara scripts automáticamente cuando detecta cambios. Test.ai hace lo similar para mobile. Ambas usan computer vision + ML.

Predicción de defectos y analytics

Para análisis predictivo puro, herramientas como Parasoft ofrecen defect prediction integrado en CI/CD. IBM SPSS y RapidMiner son más genéricas pero potentes si querés entrenar modelos propios con datos históricos. Sobre eso hablamos en automatizar pipelines de testing con IA.

Casos de implementación: el impacto real en equipos

¿Cuánta gente realmente adopta esto? Según reportes de 2026, 68% de las organizaciones ya invierte en IA generativa para QA. Ese número suena alto, pero cuando lo desglosas, muchas usan “IA” de forma limitada (copilot para escribir tests, nada más). Las que van full predictive son menos, pero crecen.

Los números del impacto son reales: reducción de 70% en mantenimiento de scripts (te lo dan casi todas las herramientas), mejora del 50% en estabilidad de pipelines (menos false positives), detección de 60% más de defectos antes de producción. Hay un caso documentado donde una empresa mediana optimizó tiempos de ejecución en 30% simplemente porque el modelo priorizaba qué tests correr primero (basado en probabilidad de defecto).

Tiempo de ciclo. Un equipo que antes tardaba 2 horas en QA baja a 45 minutos. Eso no suena a mucho hasta que multiplicás por 20 deploys por semana. Estamos hablando de 40 horas recuperadas. En una startup, eso es la diferencia entre shipping fast o quedarse atrás.

Cómo adoptar testing predictivo en tu empresa

La adopción no es “comprá esta herramienta y listo”. Necesitás pasos bien pensados (ojo, esto es donde muchos se equivocan).

Paso 1: Datos históricos. Exportá tus test results de los últimos 2-3 años, logs de deploys, commits, métricas de defectos encontrados por fase. Más datos = mejor modelo. Si apenas empezás, puedes combinar datos de equipos similares como baseline.

Paso 2: Integración CI/CD. Tu predictor tiene que vivir en el pipeline. Cuando un PR llega a GitHub, Gitlab o Jenkins, el sistema corre features y devuelve predicciones en comentarios del PR. Si score es alto, bloqueas merge o marcas para revisión manual. Si es bajo, pasa normalmente.

Paso 3: Feedback continuo. Cada defecto que llega a producción entra al modelo. “Este predict score fue 45% pero igual falló” → el modelo aprende. Sin feedback loop, el modelo se queda estancado.

Paso 4: Monitoreo y ajuste. Medí qué funciona: ¿cuántos falsos positivos generás? ¿El threshold de riesgo está bien calibrado? Acá necesitás darle 4-6 semanas al sistema para madurar antes de decidir si funciona. Más contexto en testing de seguridad predictivo.

Desafíos reales: equipos pequeños a veces no tienen datos suficientes, algunas empresas tienen sistemas legacy donde no hay logs centralizados, hay resistencia cultural (“el ML me va a reemplazar?”). La mejor práctica: empieza con un proyecto piloto en un equipo, demuestra valor, escala.

Tabla comparativa: herramientas de testing predictivo

| Herramienta | Tipo | Enfoque | Precio (desde) | Mejor para |

|---|---|---|---|---|

| Applitools | Visual Testing | Validación visual con deep learning | USD 500/mes | Tests visuales automáticos |

| Blinq.io | Test Generation | Generación automática de tests desde especificaciones | USD 300/mes | Acelerar escritura de tests |

| Mabl | Test Generation | ML para flujos complejos | USD 400/mes | Testing inteligente de user flows |

| Perfecto | Self-Healing | Reparación automática de scripts | USD 600/mes | Reducir mantenimiento de tests |

| Test.ai | Self-Healing | Self-healing para mobile | USD 250/mes | Testing mobile con mantenimiento bajo |

| Parasoft | Defect Prediction | Análisis predictivo integrado en CI/CD | USD 800/mes | Equipos grandes, predicción robusta |

El futuro: testing con IA generativa

Para 2027 y adelante, la tendencia es clara. Testing predictivo va a fusionarse con generación de código. Escribís un feature, el modelo genera tests automáticamente + predicción de riesgos + reparación automática de tests rotos. Todo junto, sin intervención.

Otro frente: testing de modelos de IA. Si vos entrenás modelos internos (como muchas empresas hoy), necesitás testear que el modelo se comporta bien. ¿Cómo? Predicción y monitoreo de degradación. Que es exactamente lo que hace testing predictivo, pero aplicado al modelo mismo.

Por qué 68% de las empresas ya invierte en esto: no es porque sea un buzzword. Es porque los números funcionan. Menos bugs, menos tiempo en QA, velocidad. En un mercado donde la velocidad mata, eso importa.

Errores comunes en la implementación

Esperar datos perfectos antes de empezar

Algunos equipos paraliza la idea de que “necesitan 5 años de historia”. Mentira. Empezá con lo que tenés. Si es poco, usa datos de otros proyectos como bootstrap. El modelo mejora conforme recopile más datos propios.

No integrar el feedback loop

Comprás la herramienta, la ponés en el pipeline, pero nadie registra “esto pasó a producción igual”. El modelo no aprende. Después de 3 meses dicen “no funciona” y lo abandonan. El problema fue el proceso, no la herramienta.

Confundir “prediction” con “decisión automática”

Un score de 78% de riesgo no significa “bloqueá esto automáticamente”. Significa “revisá con cuidado esto”. Si bloqueás todo con score alto, vas a rechazar cambios legítimos (falsos positivos). El modelo ayuda a los humanos a decidir, no decide por vos.

Preguntas Frecuentes

¿Cómo funciona el testing predictivo con inteligencia artificial?

Entrena un modelo ML con datos históricos (tests, commits, defectos, logs). El modelo aprende patrones. Cuando un PR nuevo llega, extrae features (cambios en líneas, archivos tocados, tipo de cambio) y predice probabilidad de defecto. Devuelve un score: 20% riesgo, 67% riesgo, etc. Tu equipo usa eso para decidir qué revisar. Te puede servir nuestra cobertura de testing automatizado con protocolos modernos.

¿Cuál es la diferencia entre testing automático tradicional y quality engineering predictivo?

Automático espera a que tests cierren y devuelve pass/fail. Predictivo anticipate problemas. Automático es “eso falló”. Predictivo es “eso tiene 75% de chance de fallar—revisá acá primero”. Son complementarios, no mutuamente excluyentes.

¿Qué herramientas de testing con IA existen hoy?

Applitools (visual), Blinq.io (generación), Mabl (flujos), Perfecto (self-healing), Test.ai (mobile), Parasoft (predicción). Cada una tiene focus diferente. Elegí según tu caso: si necesitás visual testing, Applitools. Si quieres generar tests rápido, Blinq. Si necesitás self-healing, Perfecto.

¿Cuánto se reduce el mantenimiento de tests con IA?

Self-healing automático reduce mantenimiento entre 50% y 70%, según reportes de herramientas que lo implementan. Eso significa que si hoy gastás 20 horas por mes arreglando tests rotos, bajás a 6-10 horas. El ahorro crece conforme refactorizás más.

¿Necesito infraestructura especial para implementar testing predictivo?

No. Muchas herramientas funcionan dentro de tu CI/CD existente (GitHub Actions, Jenkins, GitLab CI). Si entrenás modelos propios, necesitás un poco de compute (pero nada loco). Si usás herramientas SaaS, es cloud y listo. Algunos equipos corren predictores locales si tienen volumen muy alto, pero es excepcional.

Conclusión

Testing predictivo con IA no es un buzzword más. Es un cambio fundamental en cómo los equipos de ingeniería procesan calidad. Pasás de reactivo (esperar a que falle) a predictivo (anticipar dónde va a fallar). Pasás de mantenimiento brutal de tests a sistemas que se auto-reparan.

Los números son claros: 70% menos mantenimiento, 60% más defectos detectados antes de producción, equipos que consiguen 40+ horas de productividad por semana. Si tu equipo hace deploys frecuentes (y si no, ¿por qué?), testing predictivo es obligatorio en 2026.

La pregunta no es “¿debo adoptar testing predictivo?” sino “¿cuándo?”. Si sos startup, es ahora. Si sos empresa grande con testing legacy, es una iniciativa de 2-3 meses de piloto, pero vale la inversión.

Comenzá pequeño: elige un proyecto, recopilá datos, integra una herramienta, mide. Dentro de seis semanas sabés si funciona. Si funciona, escala. Si no, investigá por qué (feedback loop faltante, threshold mal calibrado, datos insuficientes). Pero no abandones el enfoque; ajustá la ejecución.

Fuentes

- Beyond Automation: How AI is Transforming Software Testing into Predictive Quality Engineering — Srikantha Kavuri, dev.to (2026)

- Testing Automatizado de Software Basado en IA — CaixaBank Tech

- AI in Software Testing: Definitive Guide 2026 — Software Testing Bureau

- Predictive Analytics in Software Testing — TestRigor

- Automatización del Testing QA con Inteligencia Artificial — Digital55