Claude Desktop con endpoints de terceros: cómo configurarlo

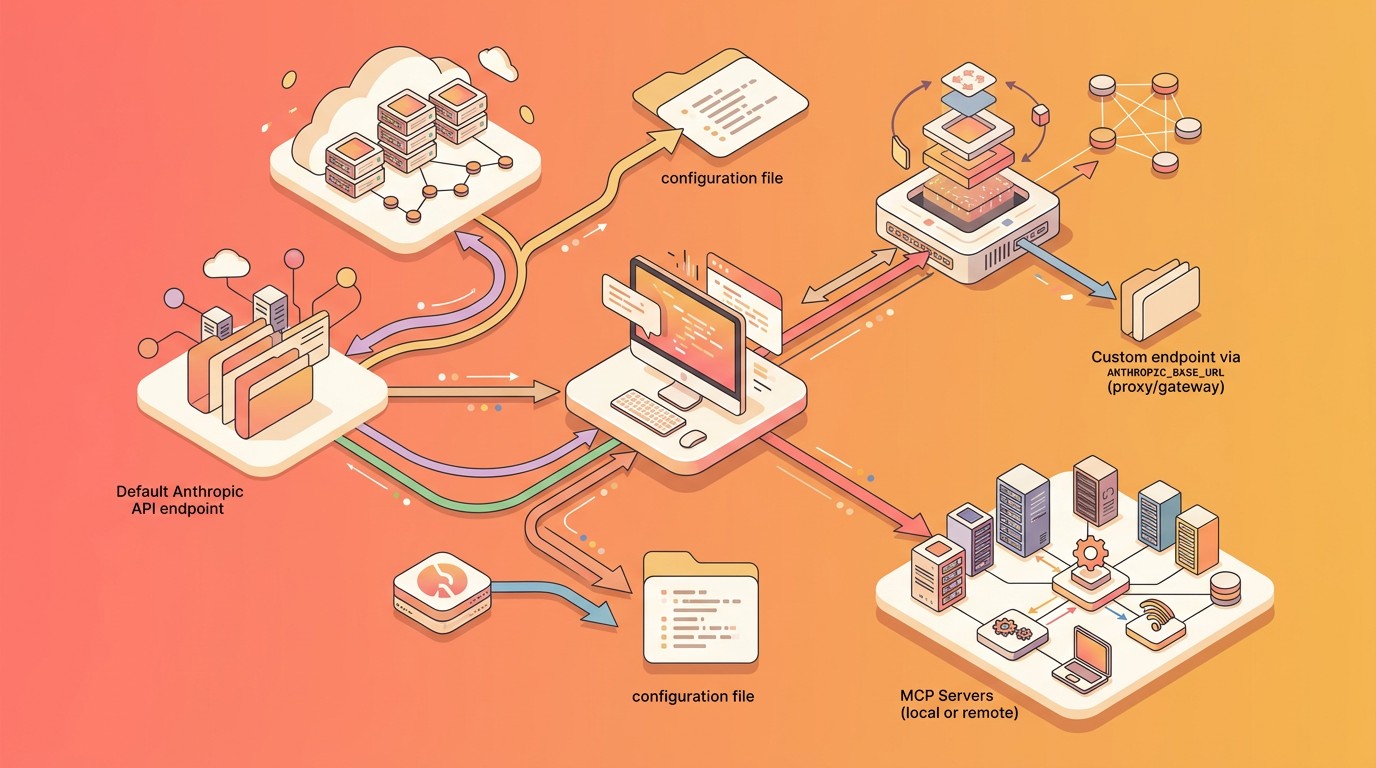

Claude Desktop ahora permite apuntar sus llamadas a la API a endpoints de terceros mediante la variable de entorno ANTHROPIC_BASE_URL, lo que habilita proxies corporativos, gateways de observabilidad y servidores compatibles con la API de Anthropic sin necesidad de modificar el código de la app.

En 30 segundos

- Claude Desktop acepta

ANTHROPIC_BASE_URLpara redirigir el tráfico a cualquier servidor compatible con la API de Anthropic. - La configuración va en el

settings.jsonde la app o como variable de entorno del sistema operativo. - Casos de uso reales: proxies corporativos, Amazon Bedrock, LM Studio, gateways de auditoría y cachés.

- Los MCP servers (Model Context Protocol) son un mecanismo distinto: conectan herramientas locales, no reemplazan el endpoint de inferencia.

- Algunas funcionalidades, como computer use y extended thinking, pueden no funcionar con proxies que no implementen las extensiones propietarias de Anthropic.

Claude es un modelo de lenguaje grande desarrollado por Anthropic en 2023 para tareas de procesamiento de texto, análisis, escritura y programación. Está disponible a través de múltiples interfaces, incluyendo aplicaciones de escritorio.

¿Qué son los endpoints de terceros en Claude Desktop?

Un endpoint personalizado en Claude Desktop es una URL alternativa que la app usa en lugar de https://api.anthropic.com para enviar las requests de inferencia. Claude Desktop, la aplicación de escritorio oficial de Anthropic para Windows y macOS, es el cliente que la mayoría de los usuarios usa para chat y para conectar herramientas via MCP. Desde mediados de 2026, la app expone soporte explícito para la variable ANTHROPIC_BASE_URL, lo que significa que podés pararse entre el cliente y Anthropic sin parchear nada.

¿Y para qué querrías hacer eso? Hay varios casos que tienen sentido real:

- Proxy corporativo: tu empresa exige que todo el tráfico a APIs externas pase por un gateway que loguea y filtra requests.

- Observabilidad: querés ver latencias, tokens consumidos y errores en tu propio stack antes de que lleguen a Anthropic.

- Caché: servidores como LiteLLM o similares pueden cachear respuestas idénticas para bajar costos.

- Modelos propios o alternativos: cualquier servidor que implemente la API de Anthropic puede recibir esas llamadas, incluso uno que exponga un modelo local.

La diferencia con los MCP servers es importante: los MCP no reemplazan el endpoint de inferencia, sino que agregan herramientas (acceso a archivos, bases de datos, APIs) que Claude puede usar durante la conversación. Son cosas distintas.

Configuración con ANTHROPIC_BASE_URL

Hay dos formas de establecer esta variable. La más limpia es hacerlo directamente en el entorno del sistema operativo antes de arrancar Claude Desktop. La otra opción, para quienes usan Claude Code o variantes CLI, es pasarla en el settings.json del proyecto.

En Windows

Abrís PowerShell como administrador y ejecutás:

[System.Environment]::SetEnvironmentVariable("ANTHROPIC_BASE_URL","https://tu-proxy.ejemplo.com","User")

Después cerrás Claude Desktop y lo volvés a abrir. Las GUI apps en Windows no heredan las variables de entorno de sesiones de terminal activas (ese es el error más común). Tema relacionado: comparativa entre Claude Code y Gemini.

En macOS

Agregás la variable en ~/.zshrc o ~/.bash_profile:

export ANTHROPIC_BASE_URL="https://tu-proxy.ejemplo.com"

El tema acá es que Claude Desktop en macOS se lanza desde el Dock, no desde la terminal, así que no levanta las variables del shell. Hay que usar launchctl setenv o editar el plist de la app para que las reciba. Un detalle que parece menor y te puede tener dando vueltas media hora.

Trailing slash: el clásico problema

Si tu proxy devuelve 404 en todos los endpoints, fijate si la URL que configuraste tiene o no tiene barra al final. https://proxy.ejemplo.com y https://proxy.ejemplo.com/ se comportan diferente según cómo esté implementado el servidor proxy. Probá las dos variantes antes de ponerte a debuggear el lado del servidor.

Integración con MCP Servers

El Model Context Protocol (MCP) es un estándar abierto, documentado en modelcontextprotocol.io, que define cómo Claude puede conectarse a herramientas externas: sistemas de archivos, bases de datos, APIs de terceros, editores de código. No reemplaza la API de inferencia; la complementa.

Para agregar un MCP server local, el archivo relevante es claude_desktop_config.json, que en Windows vive en %APPDATA%\Claude\ y en macOS en ~/Library/Application Support/Claude/. Un ejemplo mínimo:

{ "mcpServers": { "mi-servidor": { "command": "node", "args": ["/ruta/al/servidor.js"] } } }

Si querés un MCP server remoto en lugar de local, usás "url" en vez de "command". La diferencia práctica: los locales arrancan como proceso hijo de Claude Desktop; los remotos son servidores HTTP que ya están corriendo y que la app consulta vía SSE o WebSocket.

Autenticación en endpoints personalizados

Por defecto, Claude Desktop manda el header x-api-key con el valor de ANTHROPIC_API_KEY. Si tu proxy necesita credenciales distintas, podés usar ANTHROPIC_AUTH_TOKEN para sobreescribir el token que se envía. Lo explicamos a fondo en diferencias entre Claude Code y GPT.

Para proxies que requieren autenticación completamente distinta (tokens Bearer, API keys propias), la situación es menos limpia: Claude Desktop no expone un mecanismo nativo para headers personalizados arbitrarios. En esos casos, lo más prolijo es correr un proxy local ligero que haga la traducción, y apuntar ANTHROPIC_BASE_URL a localhost.

Sobre dónde guardar las credenciales: el Keychain de macOS y el Credential Manager de Windows son las opciones correctas para no dejar tokens en texto plano en variables de entorno del usuario. Particularmente si compartís la máquina o trabajás en un entorno corporativo.

Casos de uso prácticos con Claude Desktop endpoints terceros

Amazon Bedrock

Bedrock de AWS expone una API compatible con el formato de Anthropic. Podés apuntar ANTHROPIC_BASE_URL a tu endpoint regional de Bedrock y usar los modelos Claude que tengas habilitados en tu cuenta de AWS, facturando directamente a esa cuenta. Útil si ya tenés compromisos de consumo con AWS o si tu organización requiere que el procesamiento de datos no salga de cierta región.

LM Studio y modelos locales

LM Studio levanta un servidor local en el puerto 1234 con una API compatible con OpenAI y, dependiendo de la versión, también con Anthropic. Si configurás tu instancia local y apuntás Claude Desktop ahí, podés usar modelos open source sin mandar datos a ningún servidor externo. La calidad de respuesta va a ser notoriamente inferior a Claude Sonnet o Opus, pero para ciertos casos de uso con datos sensibles tiene sentido.

Gateways de observabilidad

Herramientas como LiteLLM o proxies propios con logging permiten registrar cada request: prompt enviado, respuesta recibida, tokens consumidos, latencia, modelo usado. Si administrás Claude Desktop para un equipo, esto te da visibilidad real del uso y los costos antes de que llegue la factura de Anthropic.

Problemas comunes y troubleshooting

Ponele que configuraste todo y sigue sin funcionar. Estos son los culpables más frecuentes: Te puede servir nuestra cobertura de posicionar contenido en múltiples idiomas.

- Claude Desktop no levantó las variables de entorno: cerraste el proceso completo (no solo la ventana) y volviste a abrir. En Windows, verificá con

echo %ANTHROPIC_BASE_URL%desde CMD, no desde PowerShell, que a veces muestra estados distintos. - Error SSL: tu proxy tiene un certificado autofirmado o de una CA interna que el sistema operativo no reconoce. Hay que agregar el certificado raíz al trust store del OS.

- 404 en todos los endpoints: probá con y sin trailing slash. Revisá que el proxy implemente los paths exactos que usa Claude Desktop (

/v1/messages, principalmente). - Variables funcionan en terminal pero no en la app: es el problema de GUI apps que mencioné antes. En macOS, usá

launchctl setenv ANTHROPIC_BASE_URL "https://..."y reiniciá el Dock.

Lo que no funciona con endpoints personalizados

No todo es compatible. Las funcionalidades que dependen de extensiones propietarias de la API de Anthropic requieren que el proxy las implemente explícitamente:

| Funcionalidad | Requiere soporte especial en el proxy | Funciona con proxy genérico |

|---|---|---|

| Chat básico (messages API) | No | Sí |

| Streaming | SSE estándar | Sí, si el proxy lo pasa |

| Extended thinking | Sí (headers propietarios) | Generalmente no |

| Computer use | Sí | Generalmente no |

| Cache control (prompt caching) | Sí | Depende del proxy |

| Files API | Sí | No |

¿Alguien verificó que todos los proxies del mercado implementan correctamente extended thinking? Todavía no hay una suite de tests estándar para eso, así que tenés que probar caso por caso.

Si tu equipo usa Claude Desktop con un endpoint personalizado y nota que las respuestas “piensan menos” de lo esperado en tareas complejas, probablemente extended thinking está silenciosamente desactivado porque el proxy no maneja esos headers. El modelo responde igual, pero sin el paso de razonamiento extendido (que no es poco).

Errores comunes

Confundir MCP servers con endpoints de inferencia

Son mecanismos distintos. Agregar un MCP server no cambia a qué servidor manda Claude Desktop sus requests de inferencia. Si querés redirigir la inferencia, usás ANTHROPIC_BASE_URL. Si querés agregar herramientas (búsqueda, archivos, código), usás MCP.