API de Twitter v2 vs Web Scraping: ¿Cuál usar?

Si necesitás menos de 10K tweets al mes y tenés presupuesto, la API oficial de Twitter v2 es la ruta confiable (aunque cuesta $5,000+ en el plan Pro). Si precisás escala masiva (50K+ tweets/mes) o no tenés capital para APIs, web scraping es 10-50 veces más barato, pero X bloqueó agresivamente: requiere proxies rotativos, sortea fingerprinting de navegador y CAPTCHAs, y violás el TOS (riesgo de ban real).

En 30 segundos

- La API oficial v2 de X/Twitter cuesta entre $5,000 y $42,000+ al mes según volumen; para 50K tweets necesitás el plan Pro ($5,000/mes).

- Web scraping es 10-50 veces más barato (USD 0.0009 por página en Scrapingdog), pero X te bloquea con fingerprinting, rate limiting y CAPTCHAs.

- Las defensas anti-scraping combinan user agent + resolución de pantalla + análisis TLS + canvas fingerprinting para crear IDs únicos de dispositivo.

- Herramientas como Apify, Scrapingdog y Bright Data usan proxies residenciales rotativos para evitar bloqueos, pero requieren presupuesto.

- Para menos de 10K tweets/mes: API oficial. Para más de 50K tweets/mes con presupuesto bajo: scraping con herramientas pagadas. Para análisis de sentimiento: combina ambas estrategias.

Qué es la API de Twitter v2 y el web scraping

La API oficial de X/Twitter v2 es el acceso autorizado a datos públicos de la plataforma: tweets, usuarios, métricas, trends. Requiere OAuth 2.0, respetar rate limits, pagar por volumen, y tu acceso puede ser revocado si violás los términos. Es lento pero legal.

Web scraping es lo opuesto: extraés datos públicos directamente del HTML/JavaScript de las páginas, sorteando la API. Es rápido y no cuesta nada, pero X implementó defensas sofisticadas porque va contra sus términos de servicio. El riesgo es tu dirección IP se bloquea, tu cuenta se bane (si scrapeas con login), o el scraper se rompe en el próximo cambio de Twitter.

Por qué los datos de Twitter siguen siendo valiosos en 2026

Twitter es donde las noticias quiebran primero. Analistas financieros monitorizan la plataforma para detectar movimientos de mercado. Equipos de PR y crisis management necesitan reaccionar en minutos, no horas. Una queja viral sobre tu competidor es inteligencia accionable si la atrapás a tiempo.

El segundo punto es que los opiniones en Twitter son sin filtro. Encuestas y focus groups te dan respuestas pulidas; Twitter te da lo que la gente realmente piensa de tus productos. (Si alguna vez buildaste algo, sabés que los tweets negativos duelen más que los positivos, pero son más valiosos.)

El análisis de sentimiento a escala es un goldmine. Monitorear menciones de marca, entender qué funciona y qué no, detectar tendencias antes de que peguen: todo requiere volumen de datos. Un sentimiento positivo del 60% vs 45% en tweets sobre tu categoría puede mover inversiones.

Precios de la API oficial de Twitter v2 en 2026

Acá viene lo malo. En 2023, Elon cambió el modelo a pagos, y en 2026 está aún más caro. Lo explicamos a fondo en ejecutar agentes sin APIs externas.

- Plan Gratuito: solo escritura (no lectura). Inútil si necesitás datos.

- Plan Básico (Starter): USD 100-200 por mes. Te da 50K tweets/mes máximo. Perfecto para startups pequeñas que necesitan un stream limitado.

- Plan Pro: USD 5,000 por mes. Un millón de tweets/mes. Este es donde empiezan los equipos serios.

- Plan Enterprise: USD 42,000+. Múltiples millones de tweets, soporte dedicado, acceso a endpoints privados.

Si necesitás 50K tweets por mes (el mínimo para análisis de sentimiento decente), estás pagando USD 5,000. Eso es USD 0.1 por tweet. En Scrapingdog, a USD 0.0009 por página extraída (y una página = ~10 tweets), el costo es USD 0.00009 por tweet. La diferencia es de 1000x.

Lo que no queda claro es si el modelo de créditos en beta desde diciembre 2025 bajará estos precios. Hasta hoy, no hay información oficial.

Web scraping: cómo funciona y qué requiere en 2026

El web scraping de Twitter extrae el HTML y JavaScript del navegador, parsea los tweets, y te devuelve JSON. No usa la API oficial. No pide permiso. Y X lo odia.

Ponele que querés 100K tweets sobre “chatbots en Argentina” de los últimos 30 días. Un scraper abre una sesión de navegador, ejecuta búsquedas, se desplaza por los resultados (infinite scroll), y extrae datos mientras lo hace. La velocidad es similar a un navegador humano si no querés que te detecten (200ms entre requests, user agents realistas). Pero funciona 24/7 sin fatiga.

El costo directo de herramientas es donde la cosa se pone interesante:

- Scrapingdog: USD 0.0009 por página. Planes desde USD 50/mes (56K páginas). Incluye proxy rotativo automático, manejo de CAPTCHAs con IA, reintentos.

- Apify: modelo pay-per-use con crawlers preconfigurados. Favorito de devs porque el code es simple. Típicamente USD 100-500/mes dependiendo de volumen.

- Bright Data: USD 500+ al mes. Para equipos grandes. Proxies residenciales de verdad (roban ancho de banda de usuarios reales, técnicamente legal pero éticamente cuestionable). Garantiza tasa de éxito 99%+.

- Twint (open source): gratis, pero cada vez más bloqueado por X. Requiere VPN/proxy sí o sí. Mantenimiento irregular.

Cualquiera que sea la herramienta, vas a necesitar proxies rotativos residenciales. Si usás la misma IP, te banean en minutos.

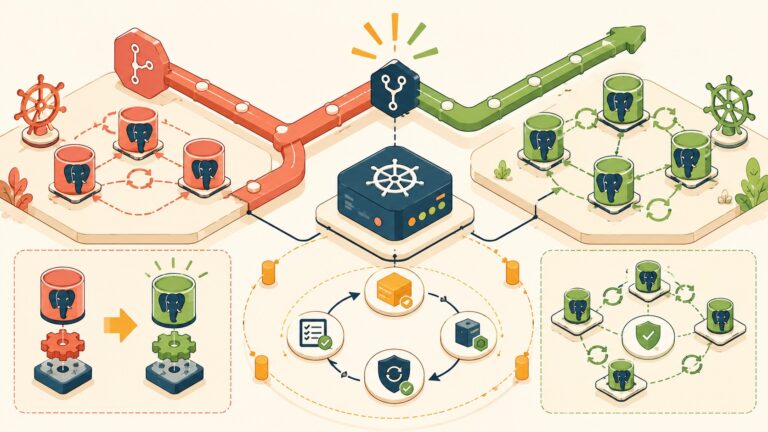

Defensas anti-scraping de X/Twitter: cómo te bloquean

Twitter implementó un combo de defensas que evolucionó en 2025-2026. No es un solo mecanismo; es un stack.

User agent y header fingerprinting. X sabe si sos un navegador real o un bot. Verifica el user agent (Chrome vs Firefox vs Safari), la resolución de pantalla, el sistema operativo, y hasta el orden específico de headers HTTP. Canvas fingerprinting dibuja imágenes invisibles en el navegador para crear un ID único de tu máquina. Si varias peticiones vienen de dispositivos “imposibles” (resolución 1920×1080, Windows 11, Chrome 127, pero IPs diferentes), la IA de X te bloquea. Relacionado: problemas de privacidad al extraer datos.

Rate limiting en dos capas. Límites corto plazo (por minuto) y largo plazo (por hora/día). Si mandás 1000 requests en 5 minutos desde una IP, te bloquean 30 minutos. Si después probás desde proxies rotativos pero el patrón es consistente (muchos requests de muchas IPs al mismo endpoint), X te banea permanentemente.

CAPTCHAs y desafíos JavaScript. Random. Si el scraper los pasa, Twitter levanta las sospechas: ¿por qué un usuario humano necesita pasar 5 CAPTCHAs en 10 minutos? Correlación + fingerprinting = ban.

Cloudflare y DataDome en el medio. Twitter usa estos servicios para análisis de comportamiento en tiempo real. Combinan reputación IP (¿ya fue bloqueada?), fingerprinting TLS (certificados SSL del cliente), análisis de patrón de clics (¿hace click normal o es un bot scrolleando?).

Herramientas reales para extraer tweets en 2026

Scrapingdog: la opción equilibrada

Servicio cloud que maneja el scraping de Twitter. Mandás un request JSON con la URL o búsqueda, y te devuelve los tweets parseados.

Código Python real:

import requests

url = "https://api.scrapingdog.com/scrape"

params = {

"api_key": "TU_API_KEY",

"url": "https://twitter.com/search?q=chatbots+argentina&lang=es",

"render": "false"

}

response = requests.get(url, params=params)

tweets = response.json()["data"]

for tweet in tweets:

print(tweet["text"], tweet["likes"])

Ventajas: proxy rotativo incluido, reintentos automáticos, pricing transparente. Desventajas: requiere crédito prepagado, limits por mes, el endpoint de Twitter está menos documentado que otros (Facebook, Amazon).

Apify: el favorito de developers

Ofrece “actors” (crawlers preconfigurados) para Twitter. El code está en JavaScript/Node, pero podés orquestarlo desde Python con su API REST. Sobre eso hablamos en herramientas de IA para análisis de datos.

La ventaja es que el código es limpio, la documentación es extensa, y tenés control granular sobre qué extraés. El problema es que el modelo de créditos (USD 0.25 por 1000 ejecutores) es opaco si no sabés cuánto va a costar tu crawl.

Bright Data (antes Luminati): para equipos con presupuesto

Proxies residenciales de verdad (USD 500+/mes). Garantía de no ban, tasa de éxito 99%+. Se usa en Intel, Nasdaq, compañías Fortune 500. El costo duele, pero si tu negocio depende de datos de Twitter, es lo más confiable.

Análisis de sentimiento en tweets: técnicas que funcionan

Una vez que tenés los tweets, necesitás puntuarlos. Positivo, negativo, neutral. (O más granular: entusiasta, critico, neutro, confundido.)

El dataset Sentiment140 tiene 1.6 millones de tweets etiquetados. Es la base para entrenar cualquier modelo. Métodos clásicos usan Naive Bayes, SVM o Regresión Logística. Deep learning usa LSTM, Bi-LSTM o CNN. En 2026, los mejores resultados vienen de transformers fine-tuned (BERT, DistilBERT, modelos específicos para español como RobertuIta).

El problema práctico es procesar tweets en tiempo real. Si tenés 100K tweets/hora, necesitás inference rápido (100ms por tweet máximo). La mayoría de modelos transformer toman 500ms-2s por tweet en CPU. Necesitás GPU, batching, o un servicio cloud como Hugging Face Inference API.

Un ejemplo: si querés monitorear menciones de tu marca en Twitter, extractar tweets cada 5 minutos, puntuar sentimiento, y alertar si el sentimiento cae 20 puntos en 1 hora, necesitás un pipeline async. Scrapingdog → tu base de datos → LSTM inference → Telegram bot alert. El costo total: USD 500/mes (scraping) + USD 50/mes (inference API) + tu tiempo de setup.

Tabla comparativa: API vs Scraping en números

Métrica | API Oficial v2 (Plan Pro) | Web Scraping (Scrapingdog) | Web Scraping (Bright Data) |

|---|---|---|---|

Precio/mes (50K tweets) | USD 5,000 | USD 45 | USD 500+ |

Costo por tweet | USD 0.1 | USD 0.00009 | USD 0.01 |

Tasa de éxito | 99.9% | 85-90% (X lo bloquea) | 99%+ |

Velocidad (tweets/hora) | Ilimitada (rate limits suaves) | 10-50K (depende proxies) | 100K+ |

Legalidad | Legal (autorizado) | Viola TOS (riesgo ban) | Viola TOS (riesgo bajo con Bright Data) |

Setup tiempo | 2 horas (OAuth, app approval) | 30 minutos (API key, script Python) | 1-2 días (onboarding, verificación) |

Mantenimiento | Bajo (X mantiene endpoints) | Alto (X cambia defensas constantemente) | Medio (Bright Data mantiene proxies) |

Análisis histórico | 7 días libres, después USD $$ | Ilimitado (si lograste scrapear antes) | Ilimitado (si lograste scrapear antes) |

Qué está confirmado / Qué no en 2026

Confirmado

- API v2 de X cuesta USD 5,000+ al mes (según documentación oficial de Twitter).

- X implementó defensas anti-scraping con fingerprinting, rate limiting y CAPTCHAs (confirmado por reportes de Apify y Scrapingdog en 2025-2026).

- Proxies residenciales rotativos son necesarios para scraping a escala (cualquier herramienta de scraping lo requiere).

- El dataset Sentiment140 tiene 1.6 millones de tweets etiquetados (confirmado en Kaggle).

No confirmado / Especulativo

- El modelo de créditos en beta desde diciembre 2025 va a bajar precios (no hay comunicado oficial de X confirmando fechas o reducciones).

- Twint va a volver a funcionar sin proxies (está cada vez más bloqueado; los maintainers no prometen soporte).

- Las defensas anti-scraping de X van a estabilizarse (históricamente, X agrega defensas cada 3-6 meses, obligando a los scrapers a adaptarse).

Errores comunes que comete la gente

Error 1: Pensar que Twint sigue funcionando sin configuración

Twint fue el scraper open source estándar en 2020-2023. Ojo: en 2026 está casi completamente bloqueado. Si lo usás sin VPN/proxy, conseguís 0 tweets. Gente dedica horas a debuggear Twint cuando simplemente X lo rompió. Solución: usa Scrapingdog, Apify, o Bright Data si necesitás algo confiable. Ya lo cubrimos antes en comparar APIs de distintas plataformas.

Error 2: Ignorar que el scraping viola TOS

Web scraping de Twitter es más barato, pero X puede banear tu IP, tu cuenta, o tu empresa. Si X detecta scraping a escala, congela acceso por meses. Algunos clientes de Bright Data sufrieron bans igual porque X mejoró sus defensas. La falsa sensación de seguridad te cuesta más que una API oficial cara. Solución: evalúa el riesgo vs. beneficio costo. Para un startup con presupuesto ajustado, scraping tiene sentido. Para un equipo que depende de datos de Twitter, la API es más segura.

Error 3: No configurar rate limiting en tu lado

Si llamás Scrapingdog 1000 veces en 1 minuto, X ve patrones de bot y te banea la IP subyacente (incluso si Scrapingdog rotó proxies). Necesitás backoff exponencial en tu código: si un scrape falla, esperá 5s, luego 10s, luego 30s. Y distribuí requests a lo largo del tiempo, no todo junto. Solución: implementá circuit breaker pattern. Si 10 requests fallan seguidos, pausá 1 hora.

Preguntas Frecuentes

¿Cuánto cuesta realmente extraer datos de Twitter en 2026?

Para 50K tweets/mes: API oficial $5,000 al mes (USD 0.1 por tweet), Scrapingdog $45-150 (USD 0.00009 por tweet), Bright Data $500+ (seguro pero caro). Elegí según presupuesto y tolerancia al riesgo de ban.

¿Qué defensas tiene Twitter contra scrapers?

Fingerprinting de navegador (user agent, resolución, TLS), rate limiting por IP, CAPTCHAs, análisis de comportamiento vía Cloudflare/DataDome. X monitorea patrones: IPs diferentes con exactamente el mismo navegador = bot. Requiere proxies residenciales rotativos para pasar.

¿Es legal scrapear datos públicos de Twitter?

Técnicamente legal (datos públicos), pero viola el TOS de X. X puede banear tu IP indefinidamente sin aviso. En EE.UU., casos como hiQ Labs vs. LinkedIn confirmaron que scrapar datos públicos es legal, pero la plataforma puede bloquear el acceso. Riesgo: ban real, costo: tiempo sin datos. En Argentina, no hay jurisprudencia clara.

¿Cuál es mejor para análisis de sentimiento: API o scraping?

Ambas funcionan. API es más confiable y legal, pero caro. Scraping es barato pero requiere mantener proxies, sortear defensas, y asumir riesgo de ban. Para análisis exploratorio o startups: scraping. Para producción en equipos grandes: API. Algunos usan hybrid: scrapean datos históricos barata, luego monitorean nuevos tweets por API.

¿Apify o Scrapingdog: cuál elegir?

Apify tiene mejor documentación y código más limpio; Scrapingdog es más barato y directo. Probá gratis con Apify primero (USD 0 crédito inicial), luego migrá a Scrapingdog si el costo es problema. Ambas manejan proxies y reintentos, así que la diferencia es UI y precio.

Conclusión

En 2026, extraer datos de Twitter es un tradeoff costo-riesgo. API oficial es legal, confiable, pero cuesta USD 5,000+ al mes. Web scraping cuesta 1% de eso, pero viola TOS y X lo bloquea cada vez mejor. Si tu negocio depende de datos de Twitter (análisis de sentimiento, monitoreo de marca, inteligencia competitiva), la decisión es:

Menos de 10K tweets/mes: API oficial, riesgos mínimos. Entre 10K y 50K tweets/mes: hybrid (API + scraping selectivo). Más de 50K tweets/mes: Bright Data si presupuesto lo permite; Scrapingdog + rotación frecuente de proxies si no.

Lo importante es que en 2026, no hay silver bullet. Ambas estrategias requieren mantenimiento, monitoreo, y asumir que X va a cambiar las defensas. Documentá el código, prepará fallbacks, y no confíes en nada 100%.

Fuentes

- Twitter API v2 vs Web Scraping in 2026: Which Should You Use? – Dev.to

- Precios de la API de X/Twitter 2026: Guía completa de todos los niveles y alternativas – GetLate

- Twitter API vs Scraping APIs: What Should You Use in 2026 – ScrapeBadger

- Best Twitter X Scrapers – Apify Blog

- Best Twitter/X Data Providers – Bright Data