25 mitos SEO que los developers siguen creyendo

Los mitos SEO que cometen developers son más comunes de lo que parece: según Semrush, la mayoría de los errores técnicos de posicionamiento no vienen de ignorar el SEO, sino de aplicar “conocimiento” que nunca fue cierto. Google ha desmentido explícitamente docenas de estas creencias, pero circulan igual porque alguien las leyó en un blog de 2012 y las copió sin verificar.

En 30 segundos

- Google no tiene ninguna métrica de “densidad de keywords” ideal: Matt Cutts lo desmintió en 2011 y el algoritmo nunca cambió en ese sentido.

- Domain Authority y Domain Rating son métricas de Moz y Semrush, respectivamente. Google afirmó explícitamente que no las usa.

- Las meta descriptions no afectan el ranking directo, pero sí el CTR en la SERP.

- JavaScript no destruye el SEO si se implementa bien: Googlebot renderiza JS desde hace años.

- El 55% de las páginas web tienen problemas con la jerarquía de encabezados H1-H6, uno de los pocos errores técnicos que SÍ importan.

SEO es el conjunto de técnicas y estrategias para mejorar la visibilidad orgánica de un sitio web en motores de búsqueda. Se desarrolla continuamente conforme evolucionan los algoritmos de Google y otros buscadores.

Los 25 mitos SEO que todo developer cree (pero son falsos)

El podcast “Grumpy SEO Guy” arranca cada episodio con la misma premisa: “nearly everything you know about SEO is wrong”. Suena provocador, pero si trabajás en desarrollo web y alguna vez implementaste SEO “por las buenas prácticas que leíste en algún lado”, probablemente aplicaste al menos tres mitos sin saberlo.

El problema no es la ignorancia. Es la acumulación de folklore técnico que circula como si fuera doctrina. Artículos de 2010 que siguen rankeando bien explican “trucos de densidad de keywords” como si Google fuera el mismo de hace 16 años. Foros de Stack Overflow donde alguien respondió con confianza algo incorrecto y la respuesta quedó ahí, con 200 votos positivos, para siempre.

Separar mito de realidad acá no es filosofía. Es plata, posicionamiento y tiempo de desarrollo que se tira a la basura.

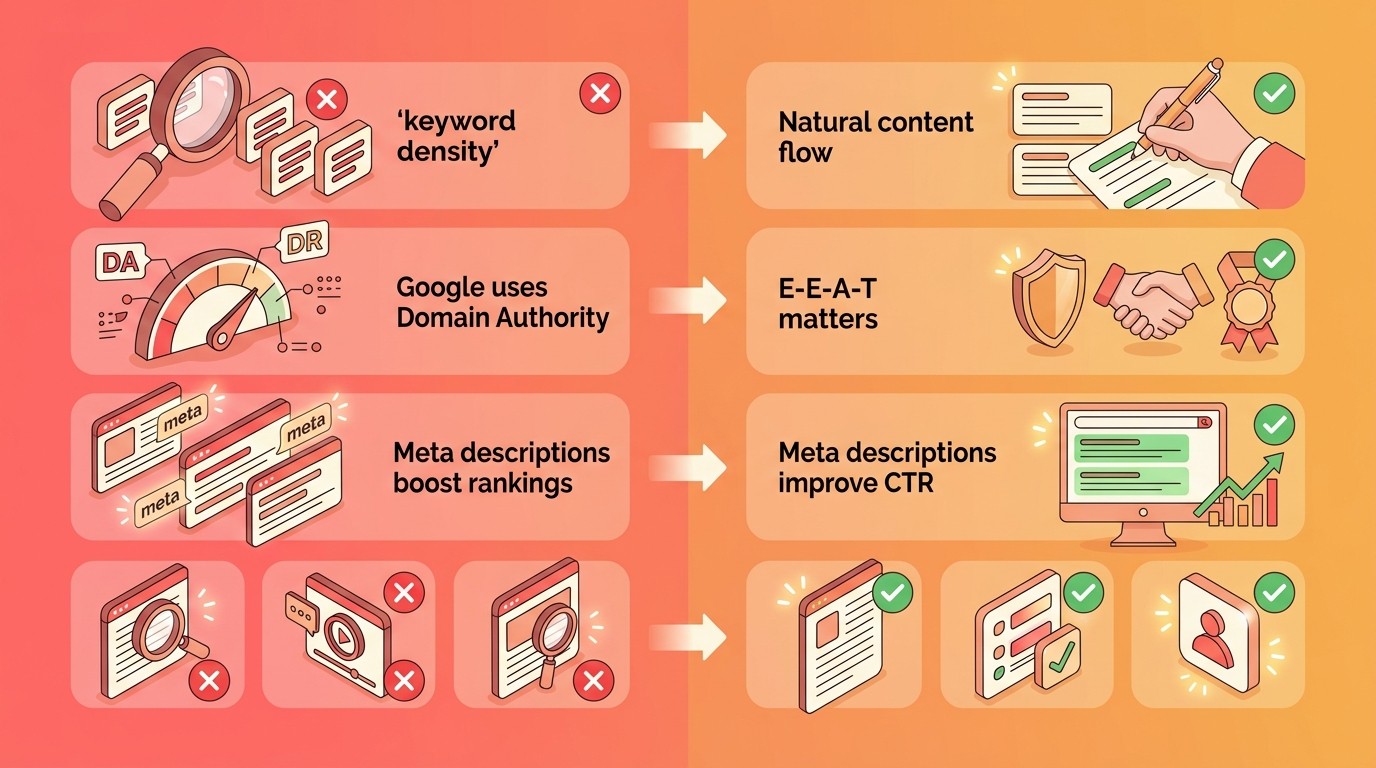

Mentira #1: Existe una densidad ideal de palabras clave

Ponele que abrís un plugin de SEO y te dice que tu densidad de keyword es 1.8% y debería ser 2-3%. Lo ajustás. El artículo queda raro, forzado, pero el indicador se pone verde. ¿Y qué ganaste? Nada verificable.

Matt Cutts, entonces jefe del equipo de webspam de Google, lo aclaró en 2011: no existe una densidad óptima de keywords. Google no tiene esa métrica. Lo que sí tiene es detección de keyword stuffing (inserción artificial y repetitiva de términos), que penaliza activamente. El contenido debe fluir de forma natural, y si la palabra clave aparece donde tiene sentido, aparece. Si no, no pasa nada.

Los plugins de SEO que muestran ese indicador lo hacen porque los usuarios lo piden, no porque Google lo evalúe. Complementá con configuración correcta del hreflang.

Mentira #2: Google usa Domain Authority o Domain Rating

Esto circula tanto que hay clientes que piden “mejorar el DA” como si fuera un objetivo de negocio real.

Domain Authority (DA) es una métrica de Moz. Domain Rating (DR) es de Semrush. Ambas son aproximaciones propias de esas herramientas para estimar la fuerza de un dominio basándose en backlinks. Son útiles para comparar sitios entre sí dentro de esas plataformas. Google, sin embargo, afirmó explícitamente: “We don’t use domain authority”.

Lo que Google SÍ evalúa en términos de autoridad es bastante diferente: E-E-A-T (Experiencia, Expertise, Autoridad y Confianza), relevancia temática del dominio para búsquedas específicas, y la calidad de los backlinks en contexto. Un sitio con DA 20 y autoridad real sobre un nicho puede rankear por encima de un DA 60 que publica sobre todo y nada.

Mentira #3: Las meta descriptions afectan el ranking

Las meta descriptions NO son factor de ranking directo. Google lo confirmó hace años. Lo que afectan es el CTR: una buena descripción en la SERP convence al usuario de hacer click, y más clicks con menor bounce rate sí señalan relevancia.

El 30% de los sitios tienen meta descriptions duplicadas y el 25% directamente no las tiene, según SE Ranking. El problema no es el ranking perdido por eso. El problema es que Google reescribe la snippet de todas formas, a veces con texto peor que el que habrías puesto vos.

Ojo: si Google reescribe tu meta description frecuentemente, es una señal de que tu descripción no responde bien a la intent del usuario. Ahí sí hay trabajo por hacer.

Mentira #4: JavaScript destruye el SEO

Este mito tiene raíces históricas legítimas. En 2015, Googlebot realmente tenía problemas para renderizar JavaScript. En 2026, no. Cubrimos ese tema en detalle en SEO en sectores especializados.

Un estudio de MERJ junto a Vercel demostró que JavaScript, cuando se implementa correctamente, no afecta negativamente el SEO y puede mejorar la experiencia de usuario, que sí es una señal indirecta de posicionamiento. Googlebot renderiza JavaScript (aunque con cierta latencia). La clave está en testear con Google Search Console usando el agente de Googlebot, no asumir que lo que ve Chrome es lo que ve el crawler.

Los problemas reales con JS y SEO son específicos: contenido crítico que solo se carga tras interacción del usuario, tiempos de renderizado que disparan el LCP (Largest Contentful Paint), o scripts que bloquean el hilo principal y deterioran Core Web Vitals. No es “JS = malo”. Es “JS mal implementado = problemas medibles”.

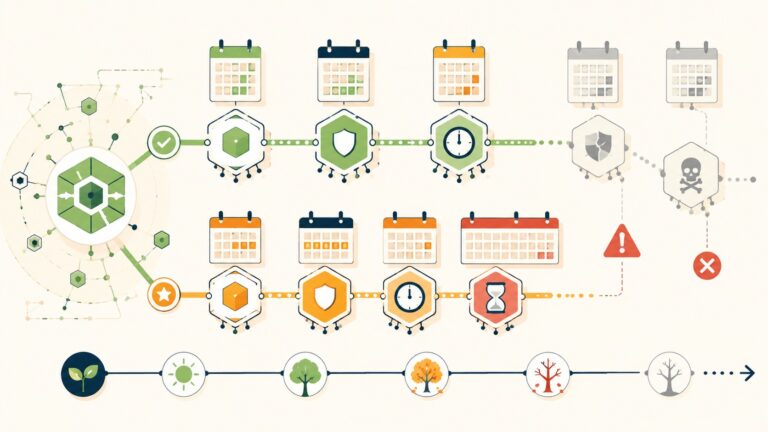

Mentira #5: Hacer SEO una sola vez es suficiente

Uno de los mitos más dañinos, especialmente en equipos donde el SEO lo implementa un dev en el sprint de lanzamiento y nadie lo toca más.

Google actualiza su algoritmo con frecuencia. Solo en 2025 hubo actualizaciones core confirmadas en marzo, junio y agosto, cada una redistribuyendo rankings de forma significativa. La competencia publica contenido nuevo. Los hábitos de búsqueda cambian (el crecimiento de búsquedas conversacionales por IA generativa transformó intent maps enteros en el último año).

¿Y qué pasó con los sitios que “hicieron SEO una vez” y no volvieron a revisarlo? Exacto: fueron bajando posiciones mientras otros subían, sin que nadie en el equipo entendiera bien por qué.

Las auditorías periódicas no son opcional para sitios que dependen del tráfico orgánico. Son infraestructura. Esto se conecta con lo que analizamos en conceptos fundamentales de SEO.

Otros mitos que circulan entre developers

La lista completa de misconcepciones SEO comunes sigue. Acá van algunas adicionales que se repiten bastante en equipos de desarrollo:

- HTTPS mejora ranking directamente: Es una señal de confianza, pero mínima. No compensá contenido pobre con SSL.

- Más páginas = más autoridad: Contenido duplicado o de baja calidad actúa como lastre. Calidad sobre cantidad siempre.

- Los backlinks de cualquier lado sirven: Un backlink de un sitio de spam puede ser activamente dañino. La relevancia y autoridad del que enlaza importan.

- Las redes sociales impactan directo el ranking: Google afirmó que los likes y shares no son señales de ranking directas. Lo que impactan es visibilidad y tráfico referencial.

- El sitemap.xml garantiza indexación: Le decís a Google qué URLs existen. No le garantizás que las indexe ni cuándo.

Los 5 errores técnicos que SÍ arruinan tu SEO

Diferente a los mitos anteriores, estos son problemas reales con impacto medible:

robots.txt mal configurado

El error más brutal y el más común en ambientes de staging que se van a producción: `Disallow: /` en el robots.txt. Bloqueás el crawler de todo el sitio. Google lo respeta. Desaparecés del índice. Lo vimos en proyectos reales, incluyendo un ecommerce que estuvo 3 semanas sin indexación porque el dev olvidó cambiar el robots.txt al pasar de staging a producción.

noindex en producción

Similar al anterior pero más difícil de detectar: una etiqueta `` olvidada en el template de producción. WordPress tiene una checkbox para esto (“Disuadir a los motores de búsqueda de indexar este sitio”) que puede quedar activada por error.

Canonical tags ausentes o incorrectas

Si tenés la misma URL accesible con y sin www, con y sin slash final, via HTTP y HTTPS, tenés contenido duplicado. Google divide el “link juice” entre todas las versiones. La canonical tag le indica cuál es la versión preferida. Sin ella, el algoritmo elige por su cuenta, y no siempre elige bien.

Jerarquía de encabezados rota

El 55% de las páginas web tienen problemas con la jerarquía H1-H6, según Search Engine Journal. Múltiples H1 en una página, saltos de H2 a H4 sin H3 en el medio, páginas sin H1. Google usa los encabezados para entender la estructura del contenido. HTML semántico no es un detalle estético.

Velocidad superior a 3 segundos en LCP

Core Web Vitals son señal de ranking desde 2021. El LCP (Largest Contentful Paint) debería estar bajo 2.5 segundos para considerarse “bueno”. Entre 2.5 y 4 segundos es “mejorar”. Más de 4 es “pobre”. Con Lighthouse o PageSpeed Insights podés medirlo en minutos. Lo que tarda en mejorarse es otro tema. Relacionado: lo que comenta la industria.

Checklist: qué SÍ importa en SEO para developers

| Factor | Importancia real | Herramienta para medirlo |

|---|---|---|

| Core Web Vitals (LCP, FID, CLS) | Alta — señal de ranking oficial desde 2021 | PageSpeed Insights, Lighthouse |

| Mobile-First Indexing | Alta — Google indexa la versión mobile primero | Google Search Console |

| HTML semántico (H1-H6, estructura) | Alta — determina cómo el crawler entiende el contenido | Inspección manual, validators |

| HTTPS | Media — señal de confianza, no de ranking fuerte | Browser + GSC |

| sitemap.xml | Media — facilita crawling, no garantiza indexación | Google Search Console |

| robots.txt | Alta (por riesgo) — un error bloquea todo el sitio | robots.txt tester en GSC |

| Canonical tags | Alta — evita contenido duplicado y dilución de autoridad | Site audit tools, GSC |

| Structured data (Schema.org) | Media-Alta — habilita rich snippets en SERP | Rich Results Test de Google |

| Meta descriptions | Media — afecta CTR, no ranking directo | GSC (CTR por página) |

| Densidad de keywords | Ninguna — mito desmentido. Escribí natural | No medir, no obsesionarse |

Errores comunes al implementar SEO técnico

Confiar en el puntaje verde del plugin. Yoast, RankMath y similares son útiles pero no son Google. Un artículo con todos los indicadores en verde puede no rankear bien si el contenido no responde la intent del usuario. Un artículo con algún indicador en amarillo puede rankear perfecto si responde exactamente lo que busca quien googlea.

Implementar structured data sin validarla. El 40% de los errores de rich results vienen de Schema.org mal implementado: propiedades requeridas ausentes, tipos incorrectos, JSON-LD con syntax errors. Usá el Rich Results Test de Google antes de dar por terminado.

Optimizar para Desktop ignorando Mobile. Desde 2019, Google indexa primero la versión mobile. Si tu versión desktop tiene el H1 y la versión mobile no, Google “ve” un H1 ausente. Si el contenido es diferente entre versiones, el contenido mobile es el que importa para el ranking.

Esto se conecta con 25 SEO Lies Web Devs Keep Repeating That Make SEOs Want to, donde cubrimos el tema en detalle.

Preguntas Frecuentes

¿Cuáles son los principales mitos SEO que circulan entre developers?

Los más comunes son: la creencia en una densidad ideal de keywords (no existe), que Google usa Domain Authority (es una métrica de Moz, no de Google), que las meta descriptions afectan el ranking directamente (afectan el CTR, no la posición), y que JavaScript destruye el SEO (Googlebot renderiza JS desde hace años). Todos estos fueron desmentidos por Google en declaraciones oficiales.

¿Google realmente usa Domain Authority para rankear?

No. Google lo afirmó explícitamente: “We don’t use domain authority”. Domain Authority es una métrica propietaria de Moz, y Domain Rating es de Semrush. Lo que Google sí evalúa es E-E-A-T (Experiencia, Expertise, Autoridad, Confianza) y la relevancia temática del sitio para búsquedas específicas.

¿Por qué mi sitio no rankea si tengo todas las etiquetas meta correctas?

Las etiquetas meta son condición necesaria pero no suficiente. El ranking depende principalmente de la relevancia del contenido para la intent del usuario, la autoridad del dominio sobre el tema, los Core Web Vitals, y la calidad de los backlinks. Un sitio con meta tags perfectas y contenido pobre o lento no rankea bien.

¿Qué errores técnicos de SEO tienen impacto real en el ranking?

Los más críticos son: robots.txt bloqueando el crawler, noindex activado en producción, canonical tags ausentes que generan contenido duplicado, jerarquía de encabezados rota (el 55% de las páginas falla aquí), y Core Web Vitals pobres, especialmente LCP superior a 4 segundos. Estos sí tienen impacto verificable y medible en Google Search Console.

¿Con qué frecuencia debo revisar el SEO de un sitio?

Mínimo trimestral para sitios que dependen de tráfico orgánico. Después de cada actualización core de Google (que ocurren varias veces por año), conviene revisar posiciones y comportamiento en GSC. Para sitios con mucho contenido o que compiten en nichos dinámicos, auditorías mensuales son razonables.

Conclusión

La brecha entre lo que circula como “buenas prácticas SEO” y lo que Google realmente evalúa es enorme, y el problema se perpetúa porque los mitos rankean bien: artículos viejos sobre densidad de keywords tienen autoridad acumulada y siguen apareciendo en búsquedas de developers que empiezan a implementar SEO.

Lo concreto para 2026: enfocate en Core Web Vitals medibles con Lighthouse, HTML semántico correcto, canonical tags en orden, robots.txt verificado, y contenido que responda bien la intent de búsqueda. Todo lo demás, preguntalo antes de implementarlo.

Si estás en la etapa de elegir hosting para un proyecto nuevo, opciones locales como donweb.com tienen planes con infraestructura optimizada para velocidad en Latinoamérica, que impacta directamente en los tiempos de LCP.