Los nodos que revolucionan workflows IA

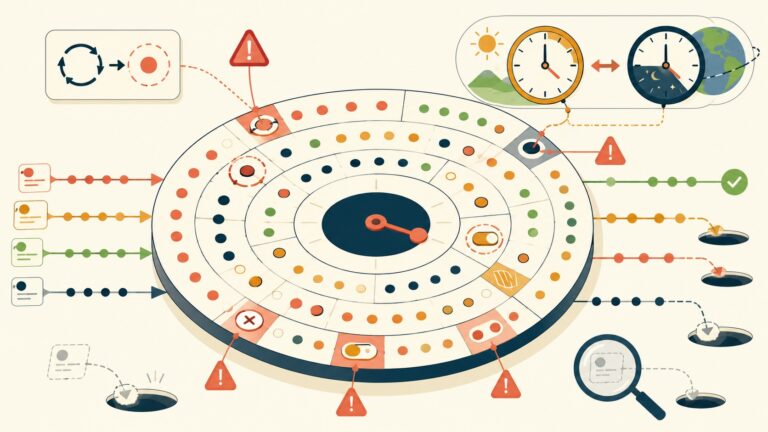

Los workflows de IA con nodos visuales se frustraban por un problema simple: cuando algo fallaba, no sabías dónde ni por qué. GitHub y plataformas como n8n acaban de lanzar dos mejoras clave que resuelven exactamente esto: visualización de outputs intermedios en tiempo real y validación automática de datos entre nodos. El resultado es que debuggear que antes llevaba horas ahora toma minutos, y los fallos silenciosos prácticamente desaparecen.

En 30 segundos

- Los nodos de workflows son bloques visuales que ejecutan acciones (llamadas a APIs, transformaciones de datos, ejecución de modelos) y se conectan formando un flujo lógico completo.

- El problema más frustrante era que cuando un workflow fallaba, no tenías visibilidad de qué datos exactamente pasaban entre nodos, generando horas de debugging a ciegas.

- La solución de visualización permite inspeccionar en tiempo real qué recibe y qué devuelve cada nodo, transformando debugging de “apagando incendios” a “entender qué pasó”.

- La validación automática de datos entre nodos previene que información malformada cause fallos en cascada silenciosos, capturando errores antes de que se propaguen.

- Plataformas como n8n, ComfyUI, Make y Krea ya implementan estas mejoras, aunque con enfoques ligeramente diferentes según su caso de uso principal.

Qué son los nodos en workflows de IA

Un nodo es un bloque de construcción en un workflow visual. Cada nodo hace una cosa específica: puede consultar una API, ejecutar un modelo de lenguaje, transformar JSON, validar datos, enviar un email, o guardar algo en una base de datos. Varios nodos conectados entre sí (donde la salida de uno alimenta la entrada del siguiente) forman un workflow completo.

Pensalo así: si vos estuvieras escribiendo el código directo, escribirías funciones, las llamarías en secuencia, y pasarías datos de una a otra. Los nodos son exactamente eso, pero sin escribir código, usando conexiones visuales. Arrastrás un nodo, lo conectás con el siguiente, configurás parámetros, y listo (en teoría).

Por qué debugging sin visibilidad fue siempre un dolor de cabeza

Acá viene el tema. Ponele que tenés un workflow que:

- Recibe un JSON de entrada

- Lo pasa a un primer modelo de IA para análisis

- Toma la salida y la transforma con un nodo de mapeo

- La envía a otro modelo para clasificación

- Guarda el resultado en una base de datos

Cuando algo se rompe, por ejemplo, el segundo modelo falla silenciosamente o el nodo final retorna un error genérico, la pregunta obvia es: ¿cuál fue el problema real? (spoiler: no es obvio). ¿El primer modelo devolvió un JSON malformado? ¿El nodo de mapeo perdió un campo importante? ¿La base de datos no pudo procesar el formato? Sin visibilidad de los datos que fluyen entre cada paso, estás debuggeando a ciegas, revisando código de cada nodo en la esperanza de encontrar dónde se rompió la cadena.

Las plataformas viejas (y algunas todavía hoy) no te mostraban qué exactamente pasaba en cada punto intermedio del workflow. Veías entrada y salida final, nada más. Era como tener un pipeline de producción donde solo podías ver el input inicial y el output final, pero nadie te dejaba mirar qué pasaba en el medio. Horrible. Esto se conecta con lo que analizamos en ejecutar agentes sin dependencias externas.

Las dos mejoras que cambiaron el juego

1. Visualización de outputs intermedios en tiempo real

La primera solución es simple pero transformadora: poder ver exactamente qué datos salen de cada nodo mientras ejecutas el workflow. Ejecutás el workflow, hace un run, y ahora cada nodo te muestra en su interfaz visual cuál fue su output.

Ejemplo concreto: tu primer modelo de IA devuelve un JSON. Antes, veías un círculo verde (listo) y nada más. Ahora, podés expandir ese nodo y ver exactamente el JSON que generó: `{“análisis”: “…”, “score”: 0.85}`. Ves de inmediato si el score es un número o un string (spoiler: si es string, el siguiente nodo va a fallar). Detectás el problema en segundos, no en horas.

n8n y Make ya lo tienen en versión estable. ComfyUI lo implementó hace poco con la visualización de preview en nodos de procesamiento de imágenes. GitHub anunció algo similar para sus Multi-Agent Workflows (aunque todavía está en preview limitado).

2. Validación y transformación automática entre nodos

La segunda mejora es más sofisticada. Nodos “validadores” que se interponen entre dos nodos normales, verificando que los datos que pasan cumplan un esquema esperado, antes de que lleguen al siguiente nodo.

Si el nodo A devuelve un JSON pero el nodo B espera que ciertos campos sean números, el validador detecta que un campo es un string y lo convierte automáticamente, o lanza un error claro en lugar de dejar que el nodo B falle silenciosamente más adelante. Evita el efecto cascada donde un pequeño error al inicio revienta todo el flujo porque nadie lo captó a tiempo. Te puede servir nuestra cobertura de proteger la privacidad de tus workflows.

Krea y Vellum tienen versiones de esto. n8n lo está mejorando constantemente con esquemas JSON más estrictos.

Dónde esta visibilidad importa más

No todos los workflows se benefician igual. Los simples (dos o tres nodos) siguen siendo triviales de debuggear. Pero hay casos donde la diferencia es enorme:

Pipelines de análisis de documentos

Recibís PDFs, los convertís a texto, pasás el texto por un modelo de OCR, luego por un modelo de NLP para extracción de entidades, y finalmente guardás los resultados. Cinco nodos, varios modelos. Si el OCR devuelve texto basura por un PDF escanear mal, ¿se nota en la salida final o se propaga como basura por todo el flujo? Con visibilidad, ves el problema en el nodo 2. Sin ella, ves que la entidad extraction falló y pensás que el modelo es malo.

Procesamiento de imágenes multi-paso

ComfyUI es el caso clásico. Generás una imagen, la pasás por un upscaler, luego por un style transfer, luego por un proceso de detalle. Siete u ocho nodos. Si alguno devuelve una imagen con dimensiones incorrectas, el siguiente explota. Ver exactamente qué imagen salió de cada paso es crítico para entender dónde se rompió la cadena.

Agentes que consultan múltiples APIs

Un agente que consulta Google Search, luego extrae datos con un modelo, luego consulta una base de datos interna, luego resume con otro modelo. Cuatro servicios externos, dos modelos. Si una API devuelve un formato inesperado, necesitás verlo de inmediato, no descubrirlo cuando el último nodo explota. Ya lo cubrimos antes en optimizar el rendimiento de tus nodos.

Plataformas node-based: estado actual del debugging

| Plataforma | Visualización de outputs | Validación de datos | Mejor para |

|---|---|---|---|

| n8n | ✅ Completa, expandible | ✅ Esquemas JSON | Workflows generales, APIs |

| Make (Integromat) | ✅ Completa, con modo Debug | ✅ Condicionales y filtros | Automatización empresarial |

| ComfyUI | ✅ Preview visual (imágenes) | ⚠️ Básica (tipos de datos) | Procesamiento de imágenes |

| Krea | ✅ Visualización integrada | ✅ Validación de esquemas | Workflows de IA generativa |

| Vellum | ✅ Tracing completo | ✅ Type checking estricto | LLM pipelines |

| GitHub Multi-Agent Workflows | ⚠️ Preview (aún limitado) | ⚠️ En desarrollo | Agentes con GPT |

Errores comunes al construir workflows sin estas mejoras

Asumir que el output de un modelo es lo que esperas

Llamas a un LLM esperando un JSON con estructura `{“name”: “…”, “age”: 25}`. A veces devuelve eso, a veces devuelve Markdown con bloques de código, a veces directamente texto plano con saltos de línea raros. Sin ver el output real del modelo, el siguiente nodo que intenta parsear JSON explota. Solución: ver exactamente qué devuelve el modelo, cada run.

No validar formatos de entrada temprano

Un campo llega como string cuando esperabas número. En lugar de fallar en el nodo que lo procesa (donde la causa sería obvia), falla tres nodos después cuando alguien intenta sumar o dividir. Dedicás dos horas a buscar el problema en la lógica, cuando en realidad estaba en el input. Validación temprana lo detecta al toque.

Crear workflows demasiado profundos sin testear cada sección

Armas un workflow de quince nodos sin probar cada uno aisladamente. Cuando algo falla, es un desastre. La regla es: testea cada nodo o grupo pequeño de nodos en aislamiento primero. Con visibilidad de outputs, esto es factible. Sin ella, es pesadilla.

Preguntas Frecuentes

¿Cómo construyo un workflow de IA desde cero sin que me explote a la primera?

Arrancá con uno o dos nodos máximo. Probá que funcionan, ves el output, documentá qué espera el siguiente nodo. Agregá un nodo más, hacé run, revisá output. Incrementalmente, no todo junto. Las plataformas modernas (n8n, Make) tienen modo de ejecución step-by-step exactamente para esto.

¿Qué nodos son más propensos a fallar silenciosamente?

Llamadas a APIs externas (si la API devuelve un status 200 pero con datos vacíos), modelos de IA (si el prompt es vago, el output puede ser impredecible), y transformaciones de datos (si un campo no existe en el JSON de entrada, la transformación devuelve null sin avisar). Validá después de cada uno de estos. Lo explicamos a fondo en elegir la plataforma de orquestación.

¿Cuál es la mejor plataforma de workflows para agentes IA en 2026?

Depende del caso. Si necesitás workflows generales con integración con muchas APIs, n8n. Si es más específicamente para LLMs (cadenas de prompts, memoria, múltiples modelos), Vellum o Krea. Si es procesamiento de imágenes, ComfyUI sigue siendo el estándar. GitHub Multi-Agent Workflows es prometedor pero aún está en preview limitado.

¿Puedo usar workflows node-based en producción o es solo para prototipado?

Sí, completamente. n8n, Make y ComfyUI lo hacen a escala. El punto es que necesitás monitoreo, logging, y alertas configuradas (¿qué pasa si un nodo falla? ¿quién se entera?). Las plataformas profesionales lo soportan. Los workflows caseros, depende si pusiste trabajo en eso.

¿Hay un overhead de performance por usar nodos en vez de código directo?

Sí, pero es marginal en la mayoría de casos. La ventaja de velocidad de desarrollo generalmente compensa. Si estás optimizando hasta el microsegundo, código directo. Si estás optimizando para “sacar algo funcionando en horas”, nodos ganan.

Conclusión

Los workflows de IA con nodos visuales no son nada nuevo, pero tenían un problema clásico: eran cajas negras. Ejecutabas, algo fallaba, y tenías que adivinar dónde. Las mejoras de visualización de outputs intermedios y validación automática de datos transforman eso. Ahora ves exactamente qué pasa en cada paso, y los errores se detectan donde ocurren, no tres nodos después.

Si estás construyendo workflows hoy, usá una plataforma que tenga estas dos cosas. Si aún no las tiene, presioná para que las agregue o busca otra. El tiempo que ahorres en debugging lo vas a notar de inmediato, especialmente cuando los workflows tengan más de cinco nodos y múltiples modelos o APIs en juego.

Para empresas y equipos en Latinoamérica que usan IA para automatización, esto es concreto: los workflows que antes demandaban 10 horas de debugging ahora toman 1-2 horas. Es mejora pura en velocidad de entrega.