Google Cloud x NVIDIA Meet Up: lo que van a mostrar

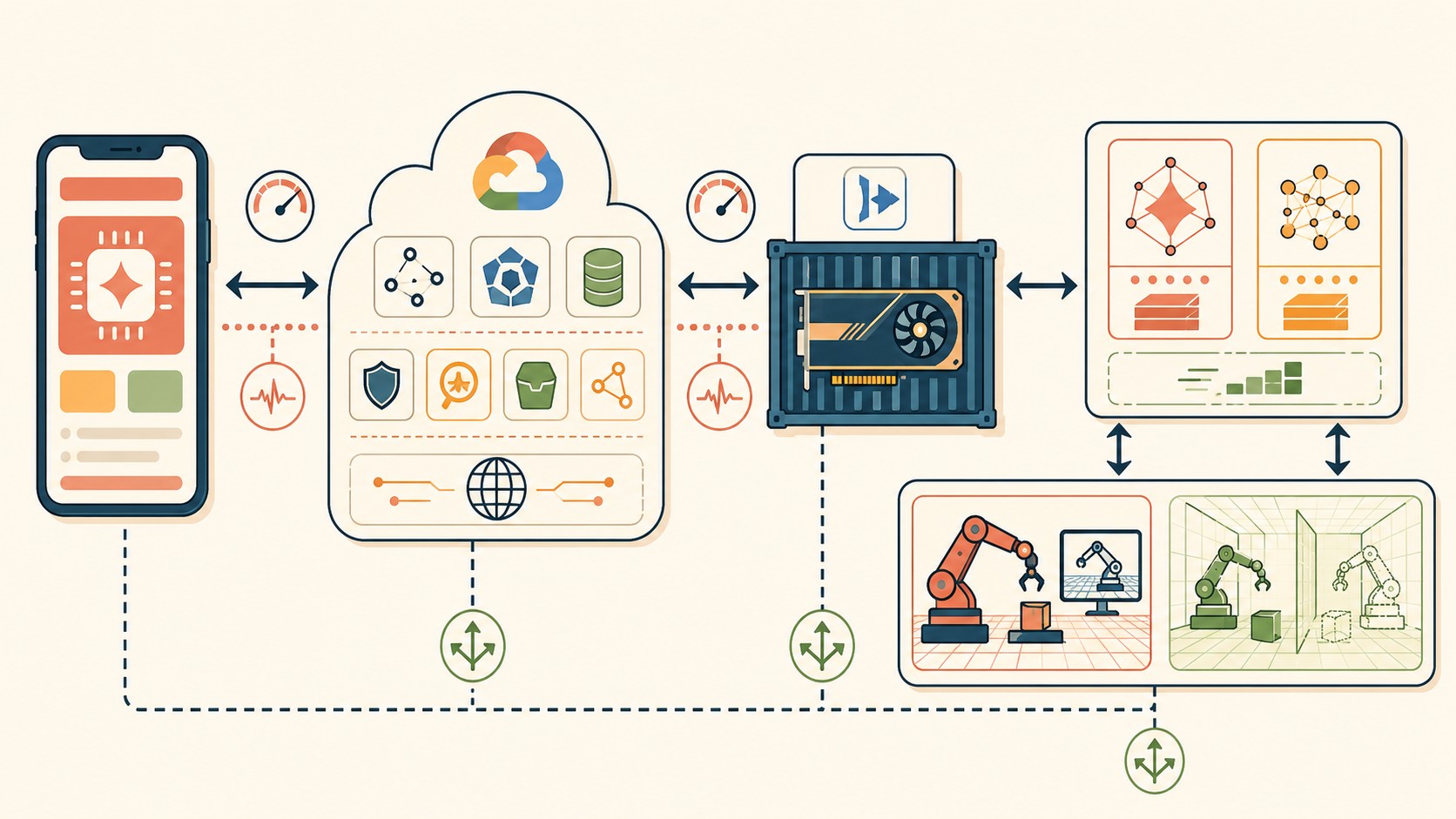

El 20 de mayo de 2026, Google Cloud y NVIDIA organizan un evento presencial en Mountain View, California, para mostrar en vivo cómo funciona la integración entre el ecosistema cloud de Google y el hardware de NVIDIA. El foco está en cinco tecnologías concretas: Gemma 4, Cloud Run con GPUs RTX 6000 Pro, ADK, Nemotron y Physical AI. Registro abierto en luma.com/GoogleNVIDIA.

En 30 segundos

- El evento es el 20 de mayo 2026 a las 5:30 PM en Mountain View, CA. Entrada gratuita con registro previo en luma.com/GoogleNVIDIA.

- Habrá demos en vivo de Gemma 4 (modelo abierto de Google con 256K tokens de contexto), Cloud Run con GPUs NVIDIA RTX 6000 Pro y Nemotron.

- Physical AI es uno de los temas centrales: IA aplicada a robots, manufactura y gemelos digitales con más de una década de colaboración entre ambas empresas.

- Google Cloud NVIDIA Gemma 2026 es el stack que se muestra: inferencia serverless con facturación por segundo y arranque en menos de 5 segundos.

- El evento celebra el primer aniversario de la comunidad conjunta de desarrolladores Google + NVIDIA, que ya supera los 90.000 miembros.

Google es una empresa multinacional estadounidense fundada en 1998 por Larry Page y Sergey Brin que desarrolla un motor de búsqueda, publicidad digital, software y servicios de computación en la nube. También ofrece Google Cloud Platform, servicios de computación en la nube para empresas.

Qué es el Google Cloud x NVIDIA Meet Up

El Google Cloud x NVIDIA Meet Up es un evento presencial de networking y demos técnicas organizado por Google Cloud y NVIDIA para desarrolladores activos, orientado a mostrar cómo se combinan el ecosistema cloud de Google con el hardware de NVIDIA en aplicaciones reales. La fecha es el 20 de mayo de 2026 a las 5:30 PM, en Mountain View, California.

No es una conferencia de marketing. El formato es distinto: llegás, te registrás, y durante casi dos horas tenés acceso directo a demos interactivas mientras hablás con ingenieros de Google, NVIDIA y Google Developer Experts (GDEs). El programa lo deja claro: de 6:30 a 8:00 PM es todo demos y conversaciones, sin paneles ni keynotes largas.

El contexto importa. Este evento marca el primer aniversario de la comunidad conjunta de developers Google + NVIDIA, que según el anuncio oficial en dev.to ya superó los 90.000 miembros. Ese número no es menor: hay demanda real de developers que quieren entender cómo meter estas tecnologías juntas en producción.

Si vas a I/O 2026 o no, el criterio para asistir es uno solo: ¿estás construyendo algo? Si la respuesta es sí, el evento es para vos.

Las cinco tecnologías en demostración

El evento gira en torno a cinco pilares técnicos. Acá va el panorama rápido antes de entrar en detalle en los más importantes: Relacionado: plataformas modernas de CI/CD.

- Gemma 4: familia de modelos abiertos de Google (licencia Apache 2.0), con variantes de 31B (densa) y 26B (MoE), contexto de 256K tokens y soporte multimodal.

- Cloud Run con GPUs NVIDIA RTX 6000 Pro: inferencia serverless con GPUs Blackwell de 96GB, facturación por segundo y escala a cero automática.

- ADK (Android Development Kit): integración de Gemini en apps Android con backend en Cloud Run GPU.

- Nemotron: modelos abiertos de NVIDIA optimizados para IA agéntica y casos industriales, disponibles en Google Cloud Marketplace.

- Physical AI: IA para sistemas físicos como robots, manufactura y gemelos digitales usando NVIDIA Isaac Sim y Omniverse sobre Google Cloud.

Gemma 4: modelos abiertos de Google Cloud NVIDIA Gemma 2026

Ponele que necesitás un modelo con contexto largo, soporte multimodal y origen en arquitectura de punta, pero sin pagar por API de terceros cada vez que lo usás en producción. Gemma 4 es la respuesta de Google para ese caso.

Según el blog oficial de Google Cloud, Gemma 4 viene en dos variantes principales: Gemma-4-31B (arquitectura dense) y Gemma-4-26B (arquitectura MoE). Ambas soportan contextos de 256K tokens, input multimodal con visión y audio, y 140 idiomas. La base arquitectónica viene de Gemini 3, lo que en la práctica significa que heredás las optimizaciones de ese entrenamiento.

La licencia es Apache 2.0. Podés usarlo, modificarlo y desplegarlo en producción sin restricciones comerciales. Está disponible en Vertex AI, GKE y Cloud Run, lo que te da flexibilidad para elegir el nivel de abstracción que mejor encaja con tu stack.

¿Y qué pasó cuando empezaron a correrlo en hardware real? Acá viene lo bueno: con fp8 quantization sobre las GPUs RTX 6000 Pro Blackwell, Gemma-4-31B corre sin degradación de calidad apreciable, según el codelab oficial de Google.

Cloud Run GPUs: inferencia serverless con NVIDIA RTX 6000 Pro

La GPU NVIDIA RTX 6000 Pro Blackwell tiene 96GB de memoria vGPU. Con eso encima y fp8 quantization, el modelo Gemma-4-31B entra cómodo sin sacrificar precisión. El codelab de Google documenta el proceso paso a paso con vLLM como motor de inferencia, aprovechando batching y KV-cache sharing para maximizar throughput.

Lo interesante es el modelo de costos. Cloud Run con GPUs factura por segundo, escala a cero cuando no hay solicitudes, y el startup tarda menos de 5 segundos, según Google Cloud. Para cargas de trabajo intermitentes, eso puede ser significativamente más barato que tener una instancia GPU corriendo 24/7.

Los casos de uso que Google lista para Cloud Run + GPUs van más allá de inferencia de LLMs: fine-tuning, procesamiento de video y 3D rendering también entran. El equipo de Google publicó un ejemplo concreto de fine-tuning de Gemma 4 para clasificación de razas de mascotas usando Cloud Run Jobs con GPUs RTX 6000 Pro, lo que muestra que no estamos hablando solo de demos de laboratorio. Te puede servir nuestra cobertura de la apuesta de Google en IA.

Nemotron y los modelos abiertos de NVIDIA

Nemotron es la familia de modelos abiertos de NVIDIA, diseñada con foco en IA agéntica y especialización industrial. La diferencia con Gemma no es que uno sea “mejor”: son arquitecturas distintas con casos de uso distintos, y lo interesante es que pueden coexistir en el mismo stack.

Están disponibles en Google Cloud Marketplace. Si en un pipeline necesitás Gemma 4 para comprensión multimodal y Nemotron para una tarea agéntica específica, podés encadenarlos sin salir del mismo ecosistema. El equipo de NVIDIA los llamó complementarios en su colaboración con Google, y por ahora eso es lo que parece ser (aunque habría que verlo en producción antes de afirmar que la integración es fluida de punta a punta).

Physical AI: del simulador a la fábrica

Physical AI es IA aplicada a sistemas físicos: robots, líneas de manufactura, logística, vehículos autónomos. No es un concepto nuevo, pero la colaboración entre Google y NVIDIA en este espacio lleva más de una década según el blog de NVIDIA, y el stack que ofrecen ahora sobre Google Cloud tiene dos herramientas clave: NVIDIA Isaac Sim para simulación robótica y Omniverse para gemelos digitales.

La idea es que podés simular un robot 1.000 veces antes de desplegarlo en producción. Eso suena a marketing hasta que te das cuenta de que entrenar un robot en el mundo real es caro, lento y lleno de variantes que no podés controlar. Con un gemelo digital en Google Cloud corriendo Omniverse y acelerado con GPUs Blackwell, podés generar datos de entrenamiento sintéticos a escala y luego transferir el modelo al hardware físico.

Las industrias que NVIDIA menciona como casos concretos: manufactura, aeroespacial, vehículos autónomos y maquinaria pesada. No es un stack para el desarrollador promedio de apps web, pero si trabajás en automatización industrial o robótica, vale la pena prestar atención a lo que van a mostrar el 20 de mayo.

ADK + Gemini: IA en apps Android con backend GPU

El Android Development Kit integrado con Gemini cierra el ciclo entre el dispositivo y el backend. La arquitectura es directa: la app Android llama a un endpoint en Cloud Run con GPU, donde corre Gemma 4 u otro modelo, y el resultado vuelve al dispositivo en tiempo real. En SEO multiidioma empresarial profundizamos sobre esto.

Gemini también corre en Google Distributed Cloud sobre GPUs Blackwell, y Nemotron está disponible para ADK. Eso le da al desarrollador de apps móviles opciones reales de modelo sin quedar atado a una sola API.

Tabla comparativa: Gemma 4 vs Nemotron en Google Cloud

| Característica | Gemma 4 | Nemotron |

|---|---|---|

| Origen | Google (arquitectura Gemini 3) | NVIDIA |

| Variantes disponibles | 31B (densa), 26B (MoE) | Múltiples (varía por versión) |

| Contexto máximo | 256K tokens | Depende del modelo |

| Soporte multimodal | Sí (visión y audio) | Limitado a texto en versiones base |

| Licencia | Apache 2.0 | Abierta (varía por versión) |

| Disponibilidad en Google Cloud | Vertex AI, GKE, Cloud Run | Google Cloud Marketplace |

| Caso de uso principal | Inferencia general, multimodal, RAG | IA agéntica, especialización industrial |

| Optimización con RTX 6000 Pro | Confirmada (fp8, vLLM) | Disponible vía Google Cloud |

Qué significa para equipos en Latinoamérica

Gemma 4 con licencia Apache 2.0 sobre Cloud Run con facturación por segundo es una combinación concreta para equipos que no pueden pagar por APIs de LLM a escala pero sí tienen picos de tráfico. El modelo de costos de Cloud Run (escala a cero, startup menor a 5 segundos) lo hace viable para productos con uso irregular.

Physical AI es el área más lejana para la mayoría de los equipos de la región, pero si trabajás en automatización industrial o tenés clientes en manufactura, el stack NVIDIA Isaac Sim + Omniverse sobre Google Cloud va a estar cada vez más en las conversaciones de infraestructura.

Para infraestructura cloud en Argentina, el ecosistema de Google Cloud tiene buena cobertura. Si encima de eso necesitás dominio o hosting para el proyecto, donweb.com tiene opciones locales para la parte más cercana al usuario final.

Errores comunes al arrancar con este stack

Usar Gemma-4-31B sin fp8 quantization en GPUs con menos de 80GB de VRAM. El modelo no entra y el error no siempre es claro. Si tu GPU no tiene 96GB como la RTX 6000 Pro, necesitás quantización antes de intentar correrlo. El codelab de Google documenta el flujo correcto con vLLM y fp8.

Esto se conecta con lo que cubrimos en Google Cloud x NVIDIA Meet Up – 5/20/26 @ 5:30pm, Mountain V.

Asumir que Cloud Run GPU siempre es más barato que una instancia dedicada. Para cargas de trabajo constantes y alto volumen, una instancia dedicada puede salir más barata. Cloud Run GPU brilla con cargas intermitentes. Calculá antes de migrar. Tema relacionado: Google frente a OpenAI.

Confundir Nemotron con un reemplazo de Gemma. Son modelos complementarios, no alternativas directas. Nemotron está optimizado para casos agénticos específicos. Usar uno donde encaja el otro puede darte resultados mediocres sin entender por qué.

Preguntas Frecuentes

¿Qué es el Meet Up de Google Cloud y NVIDIA del 20 de mayo?

Es un evento presencial de networking y demos técnicas que Google Cloud y NVIDIA organizan el 20 de mayo de 2026 a las 5:30 PM en Mountain View, California. El formato es abierto, con demos interactivas de Gemma 4, Cloud Run con GPUs, Nemotron y Physical AI, más networking con ingenieros y GDEs de ambas empresas. El registro es gratuito en luma.com/GoogleNVIDIA y el evento celebra el primer año de la comunidad conjunta de developers, que ya supera los 90.000 miembros.

¿Cómo despliego Gemma 4 en Cloud Run con GPUs NVIDIA?

El flujo documentado por Google usa vLLM como motor de inferencia con fp8 quantization sobre GPUs NVIDIA RTX 6000 Pro Blackwell de 96GB. Con esa configuración, Gemma-4-31B corre sin degradación de calidad apreciable. Google publicó un codelab completo en codelabs.developers.google.com que cubre el proceso paso a paso, incluyendo configuración de batching y KV-cache sharing para optimizar throughput en Cloud Run.

¿Cuál es la diferencia entre Gemma y Nemotron?

Gemma 4 es la familia de modelos abiertos de Google, con arquitectura basada en Gemini 3, soporte multimodal, contexto de 256K tokens y licencia Apache 2.0. Nemotron es la familia de modelos abiertos de NVIDIA, optimizada para IA agéntica y especialización industrial. No son alternativas directas sino modelos complementarios: podés usar Gemma para comprensión multimodal y Nemotron para tareas agénticas específicas dentro del mismo stack en Google Cloud.

¿Qué es Physical AI y cómo se aplica en desarrollo?

Physical AI es IA aplicada a sistemas físicos como robots, líneas de manufactura y vehículos autónomos. En el contexto de Google Cloud y NVIDIA, se implementa con NVIDIA Isaac Sim para simulación robótica y Omniverse para gemelos digitales, ambos corriendo sobre GPUs Blackwell en Google Cloud. La aplicación práctica es simular robots hasta 1.000 veces antes del deployment físico, generando datos de entrenamiento sintéticos a escala para reducir costos y riesgos en producción.

¿Dónde me registro para el evento de Google Cloud y NVIDIA?

El registro es en luma.com/GoogleNVIDIA. El evento es el 20 de mayo de 2026, 5:30 PM hora del Pacífico, en Mountain View, California. No hay costo de entrada. Está dirigido a developers activos que estén construyendo con tecnologías de Google Cloud o NVIDIA, independientemente de si van o no a Google I/O 2026.

Conclusión

El Meet Up del 20 de mayo es una oportunidad concreta para ver en vivo cómo funciona el stack Google Cloud + NVIDIA en condiciones reales, no en slides. Lo que cambió en 2026 es que la infraestructura para correr modelos grandes de forma serverless ya está madura: Cloud Run con GPUs RTX 6000 Pro, facturación por segundo y startup en menos de 5 segundos hacen que Gemma 4 sea deployable sin los costos fijos de antes.

Si estás en Latinoamérica y no podés ir a Mountain View, el codelab de Google sobre Cloud Run GPU + Gemma-4-31B con vLLM es el punto de entrada más directo para entender el stack. El evento lo van a grabar (o al menos eso se espera), pero las demos interactivas y las conversaciones con los ingenieros no se van a replicar online.