AWS caído: Bahrain y Dubai sin servicio 2026

Entre el 2-3 de marzo y el 1 de abril de 2026, Irán ejecutó ataques aéreos coordinados contra infraestructura de AWS en Bahrain y Dubai. Los drones y misiles impactaron al menos 3 facilities (2 en UAE, 1 en Bahrain), inhabilitando completamente servicios críticos como EC2, S3 y Lambda en la región ME-SOUTH-1 durante horas. Amazon waived todos los cargos de marzo para clientes afectados y fue el primer ataque deliberado a data centers comerciales durante una guerra moderna.

En 30 segundos

- Irán atacó 3 data centers de AWS (2 en UAE el 2-3 de marzo, 1 en Bahrain el 1 de abril 2026) con drones y misiles.

- Servicios como EC2, S3, DynamoDB, Lambda y RDS quedaron completamente caídos, afectando bancos emiratíes, Careem, Snowflake y otras 4+ empresas.

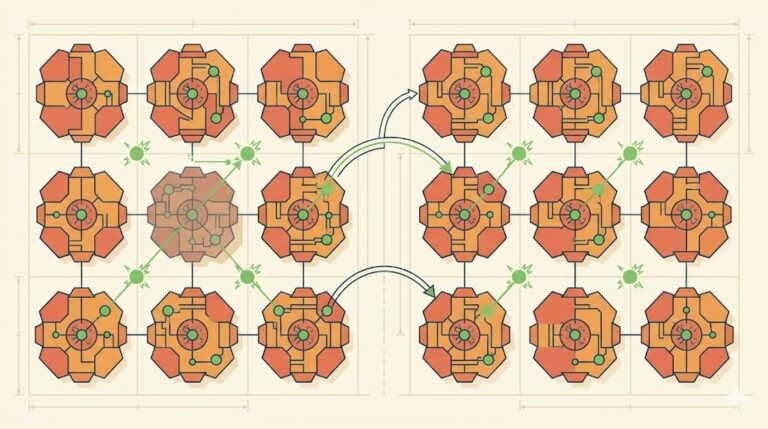

- El modelo Multi-AZ de AWS (redundancia dentro de una región) falló porque ambas Availability Zones fueron impactadas por el radio de daño del ataque.

- Amazon waived los cargos de marzo 2026 para todos los clientes en ME-SOUTH-1 y ME-CENTRAL-1; confirmó por primera vez un “hard down” status en data centers comerciales durante wartime.

- Lección: Multi-AZ protege contra fallos independientes. Para resistir desastres regionales o ataques, necesitás Multi-Región o infraestructura híbrida.

Un outage de AWS es cuando uno o más servicios en una región no responden a requests de usuarios. Puede ser por mantenimiento, falla de hardware, corte de energía o, en este caso (spoiler: por primera vez en wartime comercial), destrucción física. Multi-AZ es el modelo de redundancia de AWS donde los data centers están separados hasta 60 millas para que un desastre local no afecte ambos simultáneamente. La idea es buena. El problema es que un ataque aéreo tiene un radio de destrucción que puede pisar dos AZ al mismo tiempo.

¿Qué sucedió en Bahrain y Dubai? Cronología del ataque a AWS

A principios de marzo de 2026, la tensión geopolítica en Medio Oriente escaló a un punto que ninguno en la industria de cloud esperaba: un país decidió atacar deliberadamente data centers comerciales como objetivo militar.

Según el comunicado de Amazon en CNBC, el 2 de marzo dos facilities en Dubai y Abu Dhabi (ambas parte de la región ME-SOUTH-1) fueron impactadas por drones iraníes. El ataque no fue casual: los drones volaron sobre zonas militares y golpearon instalaciones de AWS de forma específica. Luego, el 1 de abril, Irán lanzó un segundo ataque más directo contra Bahrain, esta vez en la región ME-CENTRAL-1 (si es que eso cuenta como mejora en precisión).

Amazon confirmó que ambas Availability Zones en cada región fueron comprometidas, algo que teóricamente no debería pasar. La infraestructura estaba diseñada precisamente para evitar esto: dos AZ a suficiente distancia (hasta 60 millas) para que un evento local no las alcanzara a ambas. Pero la explosión de un misil tiene un radio de daño mucho mayor que un cortocircuito en un rack de servidores.

Impacto real: Qué servicios se cayeron y por cuánto tiempo

Cuando un data center principal se va, Amazon intenta failover automático a otra AZ dentro de la región. Acá está el problema: no había otra AZ disponible. Los servicios afectados incluyeron EC2 (máquinas virtuales), S3 (almacenamiento de objetos), DynamoDB (base de datos NoSQL), Lambda (funciones sin servidor), RDS (bases de datos relacionales) y CloudWatch (monitoreo). Traducción: si tu aplicación corría en ME-SOUTH-1 o ME-CENTRAL-1, estabas offline. Punto.

Las empresas impactadas fueron por lo menos: Abu Dhabi Commercial Bank, Emirates NBD, First Abu Dhabi Bank (acceso a pagos y transacciones bloqueado), Hubpay (procesador de pagos), Alaan (fintech), Snowflake (datos de clientes en la región), y Careem (el Uber de Medio Oriente). En algunos casos, como Careem, los drivers pudieron seguir operando offline, pero la backend estaba pateada. Los clientes en otras regiones del mundo se salvaron porque es poco probable que todas tus instancias estén en una sola zona.

La duración del outage fue de aproximadamente 4-6 horas para servicios críticos. Amazon subió la apuesta después: waived los cargos de todo marzo de 2026 para clientes en ME-SOUTH-1 y ME-CENTRAL-1. Eso es millones de dólares en descuento, una admisión tácita de que el SLA multi-AZ no valió la pena en este caso. Complementá con ejecutar agentes sin depender de la nube.

Por qué Multi-AZ falló: Las limitaciones del modelo de redundancia

Acá viene lo importante. AWS no cometió un error de arquitectura — cometió un error de supuestos, que es diferente (y más interesante).

Multi-AZ fue diseñado con esta premisa: “Los fallos de hardware, el mantenimiento de software y las caídas de red son independientes entre Availability Zones.” Un generador se quema en AZ-1, el tráfico va a AZ-2 automáticamente. Un update de kernel rompe AZ-2 a las 3 AM, AZ-1 sigue sirviendo. Eso funciona perfecto 99.99% del tiempo.

Pero un misil no es un fallo independiente, es un evento correlacionado: si cae en la zona media entre Dubai y Abu Dhabi (y el radio de daño es suficientemente grande), toca dos facilities a la vez. Según The Register, Amazon confirmó que el radio de daño del ataque fue lo suficientemente amplio como para impactar ambas AZ simultáneamente en UAE. La distancia de 60 millas que protege contra fallos normales no protege contra destrucción física a gran escala (recordá, estamos hablando de misiles).

Entonces, ¿cuál es el math detrás? Multi-AZ supone que P(fallo_AZ1) × P(fallo_AZ2) = muy bajo si los fallos son independientes. Pero si hay un evento correlacionado (guerra, terremoto mayor, ataque coordinado), P(ambas_caen) sube a casi 1.0, y todo el modelo se colapsa.

Limitaciones de la redundancia regional vs. multi-región

Es el momento para una tabla porque esto merece visualización clara.

| Métrica | Single AZ | Multi-AZ (misma región) | Multi-Región | Hybrid + Multi-Cloud |

|---|---|---|---|---|

| Protege contra: | Nada serio | Fallos de hardware, maintenance, datacenter local | Fallos regionales, ataques, desastres naturales | Caída de proveedor, ataques dirigidos, wartime |

| SLA (uptime) | 99.5% | 99.99% | 99.999% | Depende del failover |

| Latencia entre réplicas | N/A | <1ms (síncrono) | 200-500ms (asincrónico típicamente) | Variable, según cloud |

| Costo estimado (por GB/mes) | $0.023 | +20% storage | +100-150% storage + bandwidth | +200-300% storage + admin |

| Failover automático | No | Sí (segundos) | Manual o health check (minutos) | Complejo, suele ser manual |

| Caso de uso típico | Dev/test | Aplicaciones de negocio | Misión crítica, e-commerce, banking | Defensa contra superpotencias con misiles |

Mirá bien esa tabla. Multi-Región te costará 2-3 veces más en storage y transferencia de datos, pero protege contra lo que pasó en marzo. Hybrid + Multi-Cloud es el extremo, pero es lo que hacen los bancos más grandes (replicas en AWS, Azure, GCP, y servidores propios en el datacenter).

¿Cuál elegir? Depende. Si tu aplicación es un CRUD de poca criticidad, Multi-AZ alcanza. Si procesás dinero, transacciones, o datos médicos, necesitás Multi-Región. Si te preocupa que una guerra cierre tu negocio, Multi-Cloud.

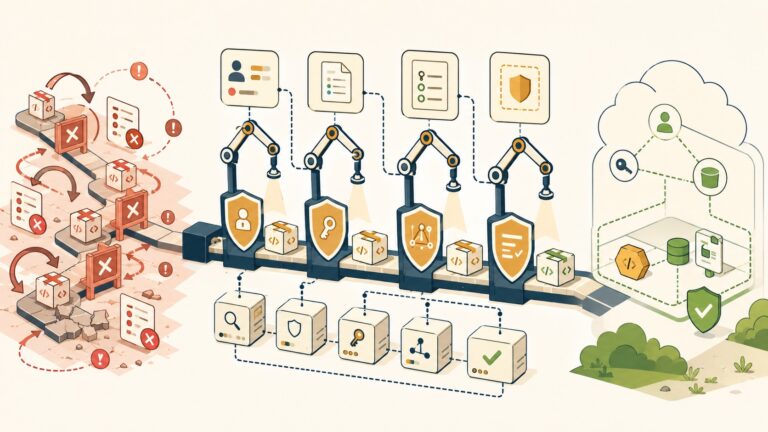

Cómo implementar Disaster Recovery que resista ataques o desastres mayores

Después de esto, varias empresas pivotaron su estrategia. Acá hay algunos patrones que funcionan:

1. Multi-Región activo-activo

Replicación síncrona de base de datos a otra región (ej: us-east-1 + eu-west-1). El tráfico se distribuye entre ambas con latencia global. Si una región cae, la otra sigue. El problema: latencia de replicación sincrónica es costosa. La solución: usa DynamoDB global tables (Multi-Región nativo) o Postgres con logical replication cross-region. Tema relacionado: alternativas más seguras para proteger tu código.

2. Multi-Región activo-pasivo

Región primaria en producción, región secundaria inactiva. Replicación asincrónica (S3 cross-region, RDS read replica). Si la primaria cae, promovés la secundaria a primaria (minutos de downtime). Más barato que activo-activo, pero requiere testing de failover cada tanto.

3. Multi-Cloud (AWS + Azure + GCP)

Distribuís la aplicación entre múltiples proveedores. Si AWS cae (sea por ataque, falla, o lo que sea), Azure y GCP siguen vivos. Código agnóstico a cloud (Kubernetes, Terraform multi-cloud). Caro de mantener, pero es la opción “nuclear” para aplicaciones where downtime = quiebra.

4. Edge caching + CDN

No es failover, pero mitiga: si usás CloudFront (CDN de AWS) o Cloudflare, la mayoría del contenido se sirve desde el edge sin tocar tu backend. Si el backend cae, al menos las páginas cacheadas siguen respondiendo. Hubpay y Alaan debieron hacer esto: cachear respuestas de API en un CDN global.

Lecciones para DevOps y arquitectos en Argentina

Ponele que estás corriendo un e-commerce en AWS. Hoy, sin esto, probablemente usás Single AZ (caro) o Multi-AZ (más caro pero standard). Después de ver bancos emiratíes cortando transacciones por horas, deberías repensar dos cosas.

Primero, Multi-AZ es el piso, no el techo. Una sola región es riesgo. Amazon construyó Multi-AZ para proteger contra fallos aleatorios, no contra eventos correlacionados (guerra, terremoto, ataque dirigido). Si tu aplicación es crítica, necesitás al menos una réplica en otra región AWS (us-east-1 + eu-west-1 es la típica).

Segundo, testea el failover. En serio. Empresas como Snowflake (que estaba en ME-SOUTH-1) probablemente tenían disaster recovery documentado, pero no testeado en condiciones reales. Cuando cae la región, no es el momento para descubrir que tu proceso de failover está roto. Simula fallos de región una vez al mes: descarga un snapshot de producción, lo restaurás en otra región, verificás que las conexiones funcionan.

Tercero, considerá hybrid o multi-cloud si tu uptime mínimo es 99.999%. En Argentina, la mayoría de empresas no llega a ese nivel de exigencia. Pero si hacés pagos en línea, seguros, o salud, sí. Acá en LATAM, donweb.com y otros hosters locales ofrecen opciones de redundancia multi-región, aunque el costo es considerable. Te puede servir nuestra cobertura de herramientas de IA que funcionan offline.

Cuarto, documentá la topología de tus datos: dónde estás, dónde se replican, cuánto lag hay entre réplicas. Un DBA debe saber esto de memoria.

El nuevo contexto geopolítico: Infraestructura como objetivo militar

Esto es lo que hace que el ataque de marzo sea histórico: es la primera vez en wartime moderno que un país ataca deliberadamente infraestructura de cloud comercial. No fue un colateral. Fue targeting selectivo.

Y Irán fue explícito sobre lo que vienen: según Fortune, los militares iraníes dieron aviso público de que también tienen en la mira a Nvidia (chip fabrication), Intel (semiconductores), y Oracle (cloud). Amenazas, todavía. Pero el patrón está claro: si controlas la infraestructura, controlas el poder económico.

Las implicaciones son brutas. Las locaciones de data center ahora importan geopolíticamente. Una empresa con presencia en Medio Oriente tiene riesgo mayor. Las naciones van a empezar a mapear dónde estás, y si llegan a ser enemigos, saben dónde golpear. AWS, Microsoft y Google ya están reposicionando inversión de regiones “calientes” a regiones “frías” (Canada, Islandia, Europa del Este).

Errores comunes después de este outage

Error 1: Pensar que Multi-AZ es suficiente para “crítico”

Multi-AZ protege contra 99.99% de los fallos. Los 0.01% restante incluyen guerras, terremotos mayores, y ataques aéreos. Si tu SLA promete 99.99%, Multi-AZ está bien. Si promete 99.999%, necesitás Multi-Región.

Error 2: Asumir que el failover automático va a funcionar cuando lo necesites

Muchas empresas tienen failover “configurado” pero nunca lo testearon. Resultado: el día que falla, descubren que el script de promoción de réplica está roto, el DNS tarda 30 minutos en actualizar, o la app no puede reconectarse a la nueva base de datos. Test el failover una vez al mes. En producción o en staging, pero test.

Error 3: Olvidar datos estáticos (images, binaries, assets)

Replicaste la base de datos multi-región, pero las imágenes están solo en S3 us-east-1. Cuando failover a eu-west-1, la app está viva pero sin imágenes. S3 tiene replicación cross-region, úsala. Cloudfront también, si querés caching global.

Preguntas Frecuentes

¿Qué pasó exactamente con AWS en Bahrain y Dubai en marzo 2026?

Irán lanzó drones y misiles contra dos data centers de AWS en Dubai/Abu Dhabi (2-3 de marzo) y uno en Bahrain (1 de abril). Los ataques fueron dirigidos y precisos. Ambas Availability Zones en cada región fueron dañadas, causando un “hard down” (no degradation, caída total) de servicios EC2, S3, Lambda y otros por 4-6 horas. Amazon waived los cargos de marzo para clientes afectados. Lo explicamos a fondo en plataformas de desarrollo más resilientes.

¿Qué empresas fueron impactadas?

Al menos 7: Abu Dhabi Commercial Bank, Emirates NBD, First Abu Dhabi Bank, Hubpay (procesador de pagos), Alaan (fintech), Snowflake (data warehouse), y Careem (ride-sharing). Las dos primeras perdieron capacidad de procesar transacciones durante horas. Careem siguió tomando requests de drivers pero no podía enrutarlos.

¿Por qué Multi-AZ no protegió contra esto si está diseñado para desastres?

Multi-AZ está diseñado para fallos independientes (un servidor se quema, un generador falla). Pero un ataque aéreo es un evento correlacionado: el radio de daño golpea ambas AZ simultáneamente si están lo suficientemente cerca. La distancia de 60 millas que protege contra fallos locales no protege contra misiles. Es una limitación del modelo, no un bug de AWS.

¿Cómo evitar un outage así si mi aplicación está en AWS?

Opciones en orden de costo/complejidad: 1) Multi-AZ en otra región de AWS (cross-region failover). 2) Multi-Región activo-pasivo (replica en standby, manual failover). 3) Multi-Cloud (AWS + Azure + GCP). 4) Hybrid (cloud + servidores propios). Testea el failover cada mes para estar seguro de que funciona.

¿Irán va a atacar más data centers?

Irán anunció públicamente que tiene en la mira a Nvidia, Intel y Oracle. Todavía son amenazas, no ataques confirmados. Pero el patrón está claro: infraestructura crítica es ahora un objetivo militar legítimo. Si operás en zonas geopolíticamente sensibles, considerá diversificar a regiones más estables (Canada, Europa, Singapur).

Conclusión

El ataque de marzo cambió algo fundamental: demostró que la redundancia en la nube no es garantía contra eventos correlacionados a gran escala. Multi-AZ sigue siendo estándar y recomendado, pero para “misión crítica” ya no alcanza.

La verdad es que esto aceleró una conversación que la industria venía teniendo: ¿cuánto estamos dispuestos a pagar por resilencia absoluta? Multi-Región cuesta el doble. Multi-Cloud cuesta el triple. Pero si un outage te cuesta millones (como a los bancos emiratíes), el ROI es obvio.

Si corres una aplicación en AWS, empieza acá: 1) Auditá dónde están tus datos. 2) Documentá el RTO (Recovery Time Objective) y RPO (Recovery Point Objective) que necesitás. 3) Si RTO < 30 minutos, necesitás Multi-Región. 4) Testea el failover. Una vez. Este mes. 5) Si operás en zonas “calientes” (Medio Oriente, Asia Oriental, Ucrania), considerá cambiar a regiones “frías” (Canada, Islandia, Irlanda).

La nube no es inmune a la realidad geopolítica. La infraestructura que creemos que es invisible está en mapas de militares en todo el mundo. Planificá con eso en mente.

Fuentes

- CNBC — Amazon says drone strikes damaged 3 facilities in UAE and Bahrain

- The Register — Amazon confirms outages in Middle East data centers following Iranian strikes

- Fortune — Iran’s attacks signal a new kind of war as AI plays strategic role

- InfoQ — AWS Multi-AZ Architecture under test during regional conflict

- NetworkWorld — Amazon waives entire month’s AWS charges after Iranian drone attack