Detecta Vulnerabilidades Automáticamente con MCP

Andy, investigador de seguridad en blog.zsec.uk, construyó desde early 2026 un sistema autónomo que usa Claude Code con Model Context Protocol (MCP) para buscar vulnerabilidades de forma continua. El sistema combina IA con herramientas especializadas en un lab purpose-built y ya encontró múltiples bugs reales en proyectos open source, MCP servers y la propia plataforma Claude Code. La efectividad supera a fuzzing manual porque el LLM razona sobre patrones de código, ejecuta tests, debuggea hallazgos y reporta resultados sin intervención humana entre ciclos.

En 30 segundos

- Andy (blog.zsec.uk) construyó desde early 2026 un sistema autónomo de vulnerability hunting que combina Claude Code + MCP para buscar bugs 24/7 sin intervención manual

- El sistema ya encontró vulnerabilidades reales en SQLite, MCP servers (SSRF en MarkItDown, RCE en Git), y token exfiltration en Claude Code files (CVE-2025-59536 según Checkpoint Research 2026)

- Es más efectivo que fuzzing tradicional porque el LLM razona, ejecuta código, debuggea y reporta en ciclos continuos, combinando la estrategia de Stephen Sims (2014) sin la intervención manual

- Riesgos: falsos positivos, token theft a través de MCP contexts, prompt injection, y ecosystem fragmentation (67K MCP servers públicos, 36.7% con vulnerabilidades latentes de SSRF)

Qué es la búsqueda autónoma de vulnerabilidades con MCP

Ponele que vos querés encontrar bugs en código pero no tenés 40 horas por semana para fuzzing manual. Ahí es donde entra Andy: desde early 2026 armó un sistema donde Claude Code y MCP trabajan juntos buscando vulnerabilidades de forma autónoma. No es simplemente “corrés fuzzer y esperás resultados”. Es IA ejecutando estrategias de testing, razonando sobre qué probar, debuggeando inconsistencias, y reportando hallazgos en tiempo real.

La diferencia con fuzzing tradicional (que Stephen Sims hacía en escala en 2014) es que ahora el LLM no solo genera inputs aleatorios: analiza el código, entiende patrones de seguridad, predice dónde podrían estar los bugs, y ejecuta tests inteligentes. Eso sí, requiere un lab purpose-built porque no podés dejar que el LLM se suelte en internet buscando bugs sin sandbox.

Andy invertió en Claude Max + hardware dedicado (probablemente una RTX o similar para ejecutar modelos locales si es necesario, aunque Claude Code corre en la nube). El ROI que menciona es interesante: ¿cuántas horas de investigación manual vale un modelo que corre 24/7 encontrando bugs reales?

Model Context Protocol (MCP): el protocolo que conecta IA con herramientas

MCP es el protocolo que Anthropic diseñó para que Claude (en cualquier forma: Claude Web, Claude Code, etc.) pueda conectarse con herramientas externas de forma estandarizada. Antes de MCP, integrar una herramienta custom con un LLM era quilombo: tenías que armar adapters, mantener conexiones, manejar state manualmente.

Con MCP, vos defines un “servidor MCP” (que puede ser un script Python, una API, lo que sea) y Claude se conecta a él como si fuera un tool nativo. Útil para security research porque podés conectar fuzzer tools, static analysis, debuggers, payload generators, todo en el mismo workflow. Tema relacionado: ejecutar agentes sin dependencias externas.

En la práctica, Andy puede decirle a Claude “ejecutá fuzzing en esta función” y Claude llama al MCP server de fuzzing, recibe resultados, analiza si hay crash, y reporta. Trail of Bits mantiene skills de Claude Code que implementan patrones de testing, y eso integra bien con MCP servers especializados.

El protocolo tiene vulnerabilidades propias (CVEs en MCP servers, SSRF en MarkItDown según reportes de 2026, RCE en implementations de Git/filesystem). Pero eso es tema aparte: el protocolo en sí es elegante.

Claude Code como IDE para security research

Claude Code es un IDE integrado en Claude donde vos podés escribir, ejecutar y debuggear código directamente sin salir de la interfaz. Para vulnerability hunting, es un gamechanger porque el LLM no solo “piensa” sobre bugs, sino que puede:

- Ejecutar código en un sandbox

- Ver outputs en tiempo real

- Debuggear si algo falla (examinar stack traces, variables, etc.)

- Pivotar estrategia sobre la marcha

- Generar reportes con screenshots y evidencia

Trail of Bits mantiene skills públicos en github.com/trailofbits/skills que documental patrones de testing útiles para seguridad. Si los importás en Claude Code, tenés acceso a patterns que otros investigadores ya validaron.

El problema es que Claude Code also tiene superficies de ataque. Checkpoint Research descubrió en 2026 que los project files (el contexto que subís a Claude Code) pueden leakear tokens si tenés MCP servers maliciosos o si hay prompt injection (CVE-2025-59536). Eso significa que si usás esto para hunting, necesitás cuidado extra con qué incluís en los files del proyecto.

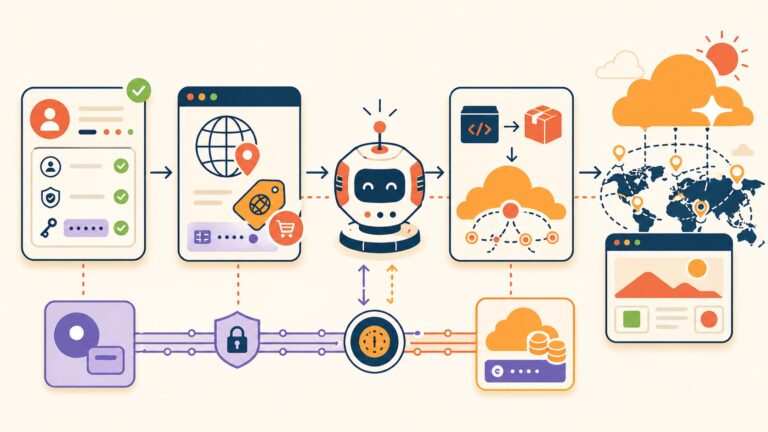

Arquitectura de un sistema autónomo: componentes y flujo

Andy dice que construyó esto “inicialmente en mi tiempo libre, la mayoría de noche cuando no podía dormir”. Eventualmente escaló a un workflow completo. La arquitectura básica tiene estos componentes:

| Componente | Función | Ejemplo |

|---|---|---|

| Discovery engine | Identifica targets (code repositories, APIs, binarios) | GitHub, registros de paquetes, APIs públicas |

| LLM (Claude) | Razona sobre qué probar, genera estrategias de testing | Claude 3.5 Sonnet via OpenRouter o Claude API |

| MCP servers | Herramientas especializadas (fuzzer, SAST, linters) | LibFuzzer via MCP, static analysis, payload generators |

| Lab sandboxed | Entorno aislado para ejecutar targets sin riesgos | Docker, máquinas virtuales, containers efímeros |

| Debugger | Analiza crashes, stack traces, comportamientos anómalos | GDB, LLDB, o análisis de salida |

| Reporting | Documenta hallazgos con CVE, PoC, severidad | Reports HTML/Markdown con evidencia, enlaces a código vulnerable |

El flujo es: discovery → selecciona target → Claude plantea estrategia → MCP servers ejecutan testing → se analiza output → si hay crash/comportamiento raro, se debuggea → si es bug real, se reporta. Todo en loop hasta que no hay targets nuevos. Para más detalles técnicos, mirá evaluá las opciones de seguridad disponibles.

Lo que lo hace “autónomo” es que no necesitas pararte a validar cada paso. El sistema entiende cuándo algo es positivo falso vs. real, cuándo seguir fuzzing vs. parar, cuándo escalar a un humano.

Vulnerabilidades reales encontradas por sistemas autónomos

Eso sí, fijate que no son especulativas. Hay bugs confirmados:

SQLite bugs (Google Project Zero): Google’s “Big Sleep” LLM-based fuzzer encontró vulnerabilidades reales en SQLite combinando LLM reasoning con fuzzing tradicional. No fueron hallazgos random: el LLM generó casos de test específicos basados en análisis de código.

MCP server vulnerabilities: Con el eco de MCP creciendo, aparecieron bugs en servidores públicos. MarkItDown MCP tenía SSRF (Server-Side Request Forgery), Git/filesystem MCP implementations tuvieron RCE. Esto alimentó el círculo vicioso: más MCP servers = más superficies de ataque = más oportunidades para automated hunting.

Claude Code project file token exfiltration (CVE-2025-59536): Checkpoint Research en 2026 reportó que si subís credenciales o tokens en los files del proyecto de Claude Code, un MCP server malicioso (o uno vulnerable con inyección) puede extraerlos. Esto es crítico para researchers usando Claude Code para hunting: no podés poner secrets sin protección extra.

Lo interesante es que estos bugs no son teóricos. Algunos los encontró Andy mismo con su sistema, otros fueron reportados independientemente (Big Sleep, Checkpoint). El patrón es claro: la IA + MCP + sandbox = hallazgos reales.

Limitaciones y riesgos de la búsqueda autónoma de vulnerabilidades

Acá viene lo que no te venden en los anuncios. Usar IA para hunting tiene tradeoffs reales: Relacionado: potenciá tu análisis con herramientas de IA.

Falsos positivos y coverage limitada: El LLM puede reportar “esto se ve como un bug” cuando no lo es. Requiere análisis humano posterior para validar. Además, la estrategia de testing del LLM es solo tan buena como su conocimiento de patrones vulnerables: si no vio un tipo de bug en su training, no lo va a buscar.

Token exfiltration y supply chain: Hay 67K MCP servers públicos en ecosistemas comunitarios, y según análisis, 36.7% tienen vulnerabilidades latentes de SSRF o RCE. Cada server es potencial risk. El “confused deputy problem” (donde Claude confunde cuál es MCP server amistoso vs. malicioso) es real.

Prompt injection y tool poisoning: Si tu target contiene payloads de prompt injection diseñados para romper el LLM, puede zafar del sandbox. Si un MCP server está comprometido, puede retornar datos falsos que el LLM incorpora en su razonamiento.

El tema es que para research profesional, necesitas validación humana después. No podés simplemente publicar “el sistema encontró bug X”. Tenés que reproducir, entender root cause, generar PoC limpio.

Primeros pasos: herramientas y recursos para implementar

Si te interesa armar algo parecido:

Paso 1: Claude Code + skills: Necesitás acceso a Claude Code (incluido en Claude Pro/Max, USD 20/mes o USD 200/mes según el plan). Trail of Bits publica skills de testing en github.com/trailofbits/skills. Revisá cuál aplica a tu lenguaje/target.

Paso 2: MCP servers especializados: Para fuzzing, buscá LibFuzzer MCP o AFL MCP. Para análisis estático, hay MCP wrappers de tools como Semgrep. Validá que cada server sea de fuente confiable (Trail of Bits, Cyera, comunidades verificadas).

Paso 3: Lab sandboxed: Docker es lo mínimo. Podés armar contenedores efímeros que se lanzan, ejecutan el test, y se destruyen. Si es fuzzing agresivo, mejor máquinas virtuales completamente aisladas. Complementá con cumplidores de estándares de seguridad reconocidos.

Paso 4: Security checklist antes de deployar: ¿Tenés secrets en los files del proyecto? No. ¿Validaste que los MCP servers vienen de fuentes confiables? Sí. ¿El sandbox está verdaderamente aislado de tu red? Sí. ¿Tenés monitoreo de crashes/hangs? Sí.

Recursos: blog.zsec.uk documenta el journey de Andy, Detection at Scale tiene workflows prácticos, y la comunidad de Trail of Bits aporta patterns.

Preguntas Frecuentes

¿Qué es MCP y cómo se usa para buscar vulnerabilidades automáticamente?

MCP (Model Context Protocol) es el estándar de Anthropic que permite a Claude conectarse con herramientas externas. Para vulnerability hunting, vos defines servidores MCP que encapsulan fuzzing tools, static analysis, debuggers, etc., y Claude los invoca automáticamente en su razonamiento. El LLM decide qué tool usar, cuándo, y cómo interpretar resultados sin intervención manual entre ciclos.

¿Cómo Claude Code ayuda en la búsqueda de vulnerabilidades de seguridad?

Claude Code es un IDE donde el LLM puede escribir, ejecutar, debuggear y reportar todo en un loop. Para security research, permite que Claude lance tests, vea outputs en vivo, analice crashes, pivote estrategia en tiempo real, y genere reportes con evidencia sin salir de la interfaz. Además, Trail of Bits mantiene skills públicos con patrones validados de testing.

¿Cuáles son las ventajas y riesgos de usar IA para security research?

Ventajas: corre 24/7, razona sobre patrones sin fatiga, detecta correlaciones que fuzzing manual perdería, y genera hallazgos documentados automáticamente. Riesgos: falsos positivos (requiere validación humana), token exfiltration si credenciales se incluyen en proyecto files, prompt injection si el target es adversarial, y supply chain risk (67K MCP servers públicos, muchos con vulnerabilidades latentes). Necesitás sandbox fuerte y checklist de seguridad.

¿Qué vulnerabilidades reales ha encontrado la búsqueda autónoma con IA?

Big Sleep (fuzzer de Google con LLM) encontró bugs en SQLite. Andy y otros hallaron SSRF en MarkItDown MCP, RCE en Git/filesystem MCP implementations, y token exfiltration en Claude Code files (CVE-2025-59536). No son teóricos: son confirmados y reportados formalmente. El patrón muestra que IA + MCP + testing = hallazgos reales cuando se hace bien.

¿Cómo armar un lab de vulnerability hunting con Claude Code y MCP?

Necesitás: acceso a Claude Max (USD 200/mes), skills de Trail of Bits importados, MCP servers de fuentes confiables (LibFuzzer, Semgrep, etc.), y un sandbox (Docker mínimo, VMs mejor). Antes de deployar: validá que no hay secrets en proyecto files, que los MCP servers son de fuentes verificadas, que el sandbox es verdaderamente aislado, y que tenés monitoreo. Empezá con un target pequeño para validar workflow.

Conclusión

Andy probó desde early 2026 que combinar Claude Code + MCP + un lab especializado = vulnerability hunting efectivo y continuo. No reemplaza investigadores humanos (los falsos positivos y validación final sigue siendo manual), pero automatiza ciclos que de otro modo tomarían semanas.

El valor está en escala: si tu empresa mantiene proyectos open source o APIs, un sistema como este corre 24/7 buscando bugs sin esperar a que un humano tenga tiempo. El costo inicial (Claude Max + infra) se recupera con el primer hallazgo real que previene un exploit.

Ojo: el ecosistema MCP creció rápido, y muchos servers están mal auditados. Requiere disciplina en security (validar sources, sandboxing, monitoring). Pero para research serio, es la herramienta que estábamos esperando.

Fuentes

- Autonomous Vulnerability Hunting with MCP – blog.zsec.uk — Andy documenta cómo construyó un sistema autónomo desde early 2026 combinando Claude Code, MCP y un lab especializado

- CVE-2025-59536: Token Exfiltration in Claude Code – Checkpoint Research 2026 — Análisis de vulnerabilidades en Claude Code project files cuando se integran MCP servers

- Trail of Bits Claude Code Skills – GitHub — Colección de skills públicos para testing y security patterns en Claude Code

- AI Threat Hunting with MCP Workflows – Detection at Scale — Workflows prácticos para implementar hunting autónomo

- Discovering Vulnerabilities with LLM – Telefónica Tech — Análisis de Project Zero (Big Sleep) y hallazgos en SQLite