¿Confianza en código abierto? La verdad que nadie te dice

A inicios de 2026, ataques como TeamPCP infiltraron herramientas de seguridad populares con malware. La conclusión de expertos: el código abierto nunca fue sobre confiar, sino sobre pragmatismo. Los desarrolladores lo usan porque es útil, gratis y rápido, no porque confíen ciegamente en la revisión comunitaria.

En 30 segundos

- TeamPCP comprometió cinco proyectos críticos en cinco días: herramientas de seguridad como Trivy y KICS, más LiteLLM en PyPI con malware autoejecutable.

- Los atacantes priorizan infiltrar herramientas defensivas primero para escalar a otros ecosistemas mediante cascadas en npm, PyPI y GitHub Actions.

- El code review comunitario no alcanza: cambios constantes, complejidad masiva, y ahora hay AI slop (código generado sin revisar) que oculta malware más fácil.

- La cadena de suministro (npm, PyPI, Docker Hub, GitHub Actions) es el verdadero talón de Aquiles: un ataque compromete miles de aplicaciones dependientes.

- Defensas reales: SBOM (Software Bill of Materials), escaneo automático de dependencias, auditorías regulares, aislamiento en CI/CD, y actualización constante.

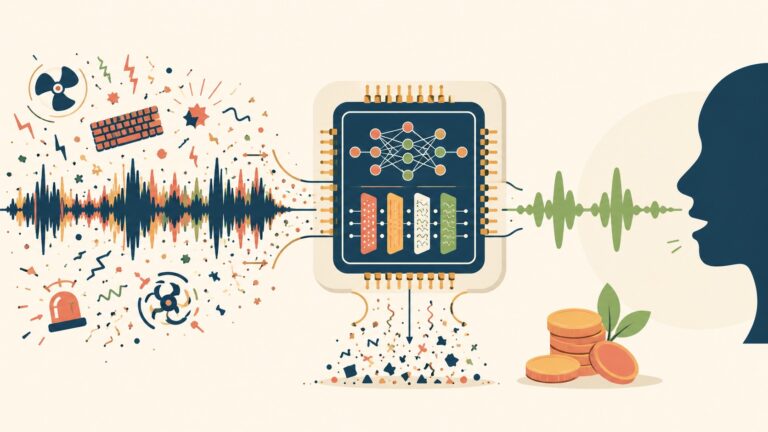

El código abierto es software cuyo código fuente está disponible públicamente para que cualquiera pueda ver, modificar y redistribuir. A diferencia de lo que muchos creen, su valor no es una garantía de seguridad, sino de transparencia y reutilización. Eso es todo. El resto es ilusión.

Código abierto nunca fue sobre confianza

Fijate la tesis de OpenSourceSecurity: el open source no le importa si lo confían o no. Simplemente existe. Si vos confías en él, dale. Si no, usá código cerrado (que tampoco es más seguro). El punto es que la gente usa software abierto no porque confíe ciegamente, sino porque es gratis, disponible, rápido, y puede revisar qué hace si le importa. Eso es todo.

Lo que cambió es que ahora los atacantes descubrieron que el open source es el mejor lugar para esconderse. No porque sea menos revisado — es al revés. Es porque está tan atomizado, tan distribuido, tan dependido por todo el mundo, que un ataque en un proyecto es un ataque a miles de aplicaciones sin que nadie lo note hasta que es demasiado tarde (spoiler: es demasiado tarde).

Los ataques de 2026 que sacudieron la comunidad

Empecemos con lo concreto. TeamPCP fue un grupo coordinado que en cuestión de días comprometió herramientas de seguridad en cinco ecosistemas distintos: Trivy (auditor de imágenes Docker), KICS (escaner de infraestructura como código), y LiteLLM en PyPI (librería que facilita acceso a modelos de lenguaje). No fueron cambios sutiles. Fue malware que se auto-ejecutaba al instalar la dependencia.

Después vinieron los reportes sobre XZ Utils. La vulnerabilidad, según Unit42 de Palo Alto Networks, fue insertada directamente en el repositorio con un CVSS de 10 (máximo riesgo). Estamos hablando de una librería de compresión que está en la mayoría de servidores Linux. Luego Axios, el cliente HTTP más popular en JavaScript, vio su cuenta npm comprometida.

¿Y Anthropic? Anunció cambios en sus modelos que, según reportes, introducen nuevas clases de vulnerabilidades. Ojo: no estamos hablando de bugs. Estamos hablando de cambios deliberados en modelos que luego usan miles de desarrolladores para generar código.

Cómo los atacantes infiltran proyectos de seguridad

El modus operandi de TeamPCP fue impecable. Comprometen una herramienta defensiva primero. Suena contraproducente, pero es estrategia pura: si vos filtras una vulnerabilidad en código abierto, ¿qué hace el desarrollador afectado? Busca una herramienta de seguridad para auditarlo. Si esa herramienta está comprometida, la consigna es: no se entera nadie. Luego, desde la herramienta comprometida, escalan a otros ecosistemas robando credenciales de CI/CD.

Pensá bien: si tenés acceso a las credenciales que usa un proyecto para publicar en npm, podés publicar cualquier cosa. Podés meter malware en las 50 siguientes versiones y nadie se entera. O mejor: lo metés en la versión más inocua posible, donde la mayor parte del código es legítimo, y el malware está escondido en una rama que solo se activa en producción, no en desarrollo. Tema relacionado: ejecutar agentes localmente sin dependencias externas.

La ilusión del code review comunitario

Acá viene la parte incómoda. La comunidad de open source vive de un supuesto: que hay suficientes ojos revisando el código. “Muchos ojos hacen bugs superficiales”, dicen. Excepto que no es verdad. O al menos no es verdad a escala.

Trivy, uno de los proyectos que comprometieron, tiene decenas de cambios por semana. ¿Alguien revisa todos? No. ¿Alguien revisa uno de cada diez? Tal vez. Y ahora agregale una capa más de complicación: AI slop. GitHub está inundado de código generado por IA. Cambios, fixes, incluso features completas que alguien tiró a un LLM, copió la salida, y lo mandó a producción sin leerlo. Eso significa que el malware ahora puede esconderse detrás de código que se ve como si fuera generado por una máquina (porque lo fue), haciendo que sea aún más invisible.

La cadena de suministro como talón de Aquiles

El verdadero problema no es un proyecto individual. Es que todo está conectado.

Vos escribís una API en Node.js. Usás Express (dependencia directa). Express usa body-parser. Body-parser usa compression. Compression usa alguna otra cosa. Siguiendo la cadena, tu aplicación tiene cientos de dependencias indirectas. Cada una es un potencial punto de entrada. Un ataque en una sola de esas dependencias te infecta sin que lo sepas.

Los registros centralizados (npm con 2 millones de paquetes, PyPI con 500 mil) son infraestructuras críticas. Un ataque bien colocado propaga al instante a todo el ecosistema. Eso es lo que pasó con TeamPCP. No fue un ataque a un sitio. Fue un ataque a la arquitectura misma que sostiene el desarrollo moderno.

Pragmatismo sobre confianza: el verdadero debate

Acá está lo que los medios no dicen: nadie en la industria cree que el open source es totalmente seguro. Los desarrolladores lo usan de todas formas. ¿Por qué? Porque el riesgo de una vulnerabilidad en open source es conocido y cuantificable. El riesgo de una vulnerabilidad en código cerrado que no podés auditar es desconocido e infinito. Elegiría el primero.

La verdad es más fría. Los desarrolladores compran un cálculo: “esta librería me ahorra dos semanas de trabajo, y el riesgo de que esté comprometida es bajo”. Si fuera alto, no la usarían. Pero ese cálculo cambió en 2026 porque los ataques son más sofisticados, más coordinados, y —acá está lo importante— ya no apuntan al código, sino a las herramientas que usan para revisar el código. Lo explicamos a fondo en alternativas de privacidad frente a plataformas centralizadas.

Estrategias defensivas: SBOM, escaneos y auditorías

¿Qué hacés entonces? Primero: aceptá que no podés confiar. Segundo: audita lo que usás.

Un SBOM (Software Bill of Materials) es un inventario de todas tus dependencias. Herramientas como CycloneDX generan un archivo que dice exactamente qué versión de cada paquete estás usando. Desde ahí, podés monitorear vulnerabilidades. Hay servicios que te alertan cuando una dependencia tuya tiene un CVE publicado.

Segundo: escanea en CI/CD. Herramientas como Trivy (sí, la que fue atacada, pero post-compromiso los maintainers le devolvieron la integridad) pueden verificar tus dependencias antes de que se deplieguen a producción. No es perfecto, pero es mejor que nada.

Tercero: auditorías regulares. No cada cambio — eso es insostenible. Pero cuando upgradeas una dependencia crítica, revisá el changelog. Si hay cambios sospechosos, investigá. Si es código generado por IA sin explicación, cuestioná.

Cuarto: aislamiento. Tus dependencias no deberían tener acceso completo a tu infraestructura. Límitalas a lo que necesitan. Si una librería no necesita acceso a la base de datos, no le des acceso. Si no necesita conectarse a internet, bloquealo.

Quinto: actualización constante. Los maintainers de open source arreglan vulnerabilidades en el momento que las detectan. Si vos estás en una versión de hace seis meses, ya pasaste las ventanas de riesgo. Algunas vulnerabilidades tienen meses entre la publicación del bug y el primer ataque. Si actualizás regularmente, te escapas.

Tabla comparativa: Ataques de 2026 en código abierto

| Ataque | Proyecto afectado | Fecha | Método de infiltración | Alcance | Impacto |

|---|---|---|---|---|---|

| TeamPCP | Trivy, KICS, LiteLLM | Abril 2026 | Compromiso de cuenta desarrollador + malware auto-ejecutable | 5 ecosistemas (npm, PyPI, GitHub Actions) | Cadena de suministro comprometida, miles de apps afectadas |

| XZ Utils | xz (librería de compresión) | Marzo-Abril 2026 | Inyección directa en repositorio + cambios oscuros en build | Millones de servidores Linux | CVSS 10 (máximo riesgo), acceso remoto a sistemas críticos |

| Axios | Axios (cliente HTTP JS) | Abril 2026 | Compromiso de credenciales npm de maintainer | 2+ millones de descargas/semana | Potencial inyección de código en cualquier web moderna |

| AI slop en GitHub | Múltiples proyectos | Continuo desde 2025 | Código generado por IA sin revisar = malware invisible | Indeterminado (cientos de miles de cambios) | Auditoría imposible, detección tardía |

Errores comunes sobre seguridad en open source

Asumir que “muchos ojos” revizan todo automáticamente

No. Los proyectos grandes reciben decenas de cambios por semana. A lo sumo, dos o tres personas revisan cada PR. Y de esas, probablemente no leyeron el diff completo. El malware cabe en 5 líneas. Es invisible. Cubrimos ese tema en detalle en herramientas de IA completamente de código abierto.

Usar librerías porque tienen muchas estrellas en GitHub

Popularidad no es seguridad. Trivy, uno de los proyectos atacados, es de los más usados en infraestructura. Las estrellas son un indicador de confianza comunitaria, no de que esté seguro. Trivy es excelente, pero eso no lo hizo inmune.

No actualizar dependencias porque “si funciona, no lo toques”

Eso es cavar tu propia tumba. Las actualizaciones incluyen parches de seguridad. Si estás en una versión vieja, estás nadando en vulnerabilidades conocidas públicamente. TeamPCP se aprovecha exactamente de eso: desarrolladores que nunca actualizan.

Asumir que un ataque a una librería es problema de alguien más

Falso. Si usás esa librería como dependencia indirecta (a través de otra que la usa), igualmente estás infectado. La cascada es automática. No lo sabés hasta que lo sabés.

Dejar de usar open source por miedo

Irracional. El código cerrado no es más seguro. Es menos auditable. Volvés a 2005 cuando escribías todo desde cero. No, gracias.

Preguntas Frecuentes

¿Es realmente seguro usar código open source?

Tan seguro como cerrado, y más auditable. El riesgo existe, es conocido, y es mitigable. Los desarrolladores lo calculan y aceptan. Si el riesgo fuera inaceptable, nadie lo usaría, y obvio que se usa.

¿Cómo sé si una dependencia está comprometida?

Monitorea CVEs publicados, usa escaneos automáticos en CI/CD (Trivy, Snyk, npm audit), y revisa el changelog de actualizaciones. Si une librería tiene cambios sospechosos o de repente la revierten, investigá. No es ciencia exacta, pero baja el riesgo. En comparación de opciones sin dependencias de proveedores profundizamos sobre esto.

¿Qué es un SBOM y por qué debería importarme?

Un SBOM (Software Bill of Materials) es un inventario detallado de todas tus dependencias, versiones incluidas. Te permite saber exactamente qué estás usando y vigilar si alguno tiene vulnerabilidades reportadas. Es un mapa de tu cadena de suministro.

¿Cómo protejo mi aplicación de ataques en la cadena de suministro?

Aislamiento, auditoría, escaneo automático, actualización regular. No existe defensa perfecta, pero en combinación reducen el riesgo dramáticamente. Limita permisos de dependencias, verifica cambios antes de actualizar, y monitorea CVEs.

¿Es TeamPCP un riesgo actual o ya fue contenido?

Fue identificado en abril 2026 y los proyectos revirtieron cambios comprometidos. Pero el patrón de ataque — herramientas defensivas como punto de entrada — es ahora el estándar para atacantes sofisticados. Es una clase de ataque que seguirá. El riesgo no fue contenido, fue documentado.

Conclusión

El código abierto nunca fue cuestión de confiar. Es cuestión de pragmatismo. Los desarrolladores lo usan porque es útil, gratis, rápido, auditable, y el riesgo es conocido. Los ataques de 2026 (TeamPCP, XZ, Axios, AI slop) no invalidan eso; simplemente demuestran que el riesgo es más sofisticado de lo que imaginábamos.

Lo que cambió es que ahora los atacantes no apuntan al código — apuntan a las herramientas que usamos para revisar el código. Eso significa que las defensas tradicionales (auditoría comunitaria, revisión de PRs) no alcanzan más. Necesitás defensas adicionales: SBOM, escaneo automático, aislamiento, actualización constante.

¿Deberías dejar de usar open source? No. Deberías confiar menos, auditar más, y aceptar que la seguridad en 2026 es un juego de capas, no de fe ciega.

Fuentes

- Open source was never about trust – OpenSourceSecurity.io: análisis crítico sobre la naturaleza pragmática del open source y reflexión sobre los ataques recientes.

- TeamPCP Targeting Security Tools Across OSS Ecosystem – Socket.dev: detalles sobre cómo TeamPCP comprometió herramientas defensivas en cinco ecosistemas simultáneamente.

- TeamPCP Supply Chain Attacks – Unit42 Palo Alto Networks: análisis técnico de la cascada de ataques en la cadena de suministro.

- LiteLLM Supply Chain Attack – Xygeni: cómo TeamPCP infiltró infraestructura de IA mediante LiteLLM en PyPI.

- Ataques a la cadena de suministro: XZ Utils y vulnerabilidades críticas – We Live Security: análisis de vulnerabilidades críticas en librerías fundamentales.