¿DeepSeek V4 ya está entre nosotros? El misterio de Hunte…

DeepSeek V4 es el próximo modelo de inteligencia artificial de DeepSeek, y las evidencias técnicas indican que ya se encuentra en pruebas públicas encubiertas bajo el nombre Hunter Alpha en OpenRouter. Este modelo anónimo opera con 1 billón de parámetros, contexto de 1 millón de tokens y patrones de razonamiento idénticos a DeepSeek V3, mientras el lanzamiento oficial se estima para abril de 2026.

DeepSeek V4 Hunter Alpha podría estar ya disponible de forma encubierta. Un modelo anónimo llamado Hunter Alpha apareció el 11 de marzo de 2026 en OpenRouter con 1 billón de parámetros, contexto de 1 millón de tokens y acceso gratuito. En cuestión de días procesó más de 160 mil millones de tokens, y múltiples pistas técnicas apuntan a que se trata de una prueba secreta de DeepSeek V4.

En 30 segundos

- Hunter Alpha es un modelo de IA anónimo que apareció en OpenRouter el 11 de marzo de 2026 con especificaciones descomunales: 1 billón (trillion) de parámetros y ventana de contexto de 1 millón de tokens.

- Se autodescribe como “modelo chino entrenado en chino” y comparte el cutoff de entrenamiento y patrones de razonamiento con DeepSeek, lo que alimenta la teoría de que es DeepSeek V4 en modo stealth.

- Existe una hipótesis alternativa: el mismo proveedor anónimo lanzó antes “Pony Alpha”, que resultó ser GLM-5 de Zhipu AI, no de DeepSeek.

- El lanzamiento oficial de DeepSeek V4 se estima para abril de 2026. Si Hunter Alpha efectivamente es V4, ya estaría siendo probado a escala masiva sin que la mayoría lo sepa.

Hunter Alpha es un modelo de inteligencia artificial de gran escala que apareció sin atribución en la plataforma OpenRouter, etiquetado como “stealth model”. Sus especificaciones —1 billón de parámetros en arquitectura Mixture of Experts (MoE) y contexto de 1 millón de tokens— coinciden con los rumores previos sobre DeepSeek V4, aunque su autoría no fue confirmada oficialmente por ninguna empresa.

Qué es Hunter Alpha: el modelo anónimo que sacude OpenRouter

El 11 de marzo de 2026, un modelo sin firma apareció en OpenRouter bajo el nombre “Hunter Alpha”. Sin logo, sin empresa visible, sin comunicado de prensa. Solo una etiqueta de “stealth model” y acceso gratuito para cualquiera que quisiera probarlo. En una plataforma donde los modelos llevan la marca de OpenAI, Anthropic, Google o Meta, eso ya era raro. Pero las especificaciones eran lo verdaderamente llamativo.

Según el análisis publicado en Medium, Hunter Alpha opera con 1 billón (trillion, en la nomenclatura anglosajona) de parámetros, una ventana de contexto de 1 millón de tokens y capacidades avanzadas de razonamiento con cadena de pensamiento (Chain of Thought). Para dimensionarlo: GPT-4 tiene un estimado de 1.8 billones de parámetros en su versión MoE, y Claude 3.5 Sonnet no reveló su cifra, pero se presume bastante menor. Hunter Alpha juega en esa liga superior.

Lo que sorprendió a la comunidad técnica fue la velocidad de adopción. En menos de una semana, el modelo procesó más de 160 mil millones de tokens. Esa cifra implica que herramientas automatizadas —agentes de IA como OpenClaw, pipelines de generación de código, sistemas de testing— se volcaron masivamente a probarlo. El acceso gratuito ayudó, claro, pero un modelo mediocre no genera ese volumen de uso ni aunque lo regales.

Hunter Alpha no llegó solo. Del mismo proveedor anónimo apareció otro modelo: Healer Alpha, descrito como omnimodal (texto, imagen, código) con una ventana de contexto de 262.000 tokens. Ambos comparten la misma cuenta sin identificar en OpenRouter, lo que sugiere que vienen de la misma organización y probablemente del mismo laboratorio de investigación.

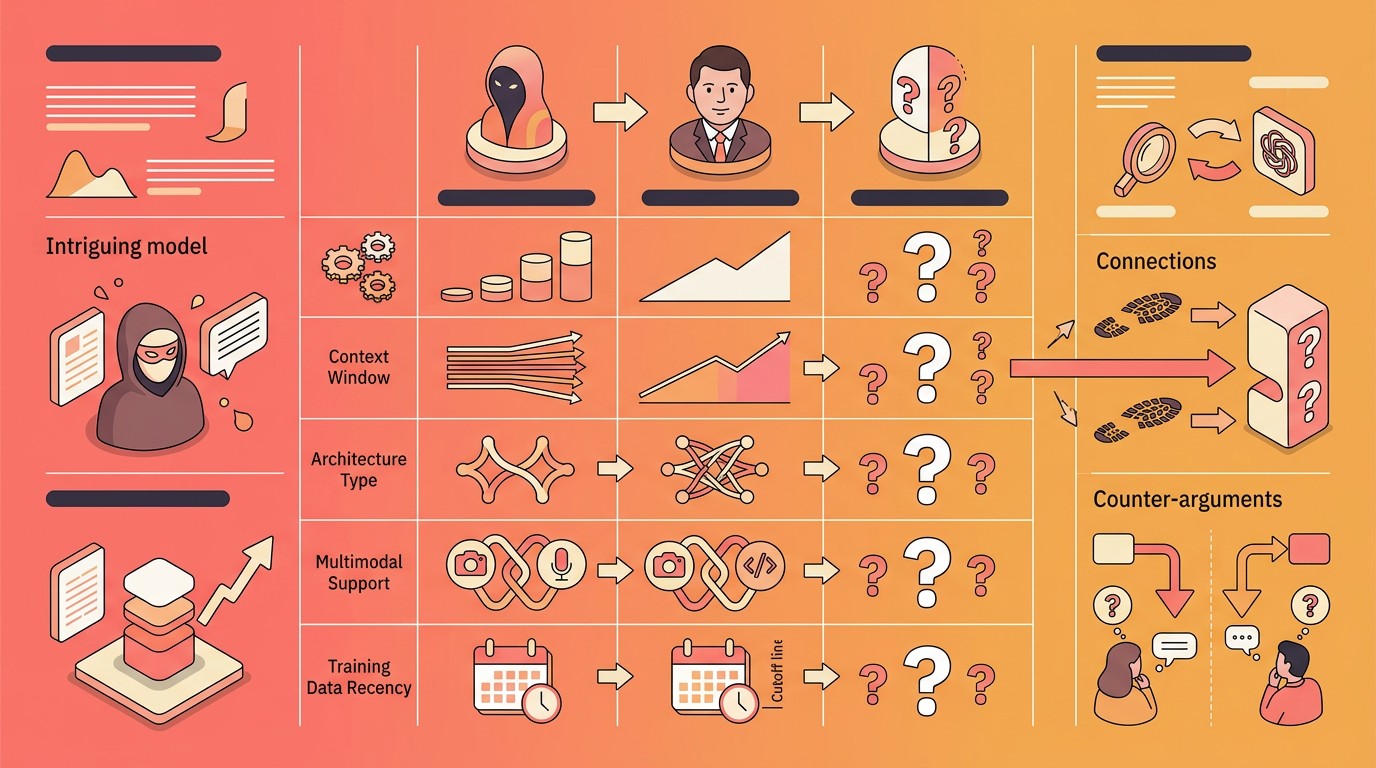

Las pistas que apuntan a DeepSeek V4

La comunidad de desarrolladores no tardó en empezar a buscar huellas digitales. Y encontraron varias que apuntan en una dirección bastante concreta.

Primero, el autoconocimiento del modelo. Cuando se le pregunta directamente qué es, Hunter Alpha se describe como “un modelo chino entrenado principalmente en chino”. No dice “soy DeepSeek”, pero tampoco se identifica con ningún otro laboratorio. Esa respuesta es consistente con los modelos de DeepSeek, que históricamente se autoidentifican de manera similar.

Segundo, el cutoff de datos de entrenamiento. Según Geeky Gadgets, Hunter Alpha reporta un corte de conocimiento en mayo de 2025, idéntico al de DeepSeek V3 y V3.2. Si fuera un modelo de otro laboratorio —digamos, de Google o de una startup nueva—, lo más probable es que tuviera un cutoff diferente.

Tercero, el estilo de razonamiento. Desarrolladores que analizaron las respuestas de Hunter Alpha notaron patrones en la cadena de pensamiento que son característicos de DeepSeek. Frases como “Hmm, the user said…” al inicio de la deliberación interna, una estructura de CoT que coincide con V3.2. No es prueba definitiva, pero es un fingerprint difícil de replicar accidentalmente.

Cuarto, la cronología. Días antes de que Hunter Alpha apareciera en OpenRouter, una referencia a “DeepSeek V4 Lite” se filtró brevemente en el sitio web oficial de DeepSeek. Fue removida rápido, pero las capturas circularon. Que V4 Lite aparezca y desaparezca del sitio oficial justo antes de que un modelo anónimo con especificaciones de V4 aparezca en OpenRouter es, como mínimo, una coincidencia muy conveniente.

Y quinto, las especificaciones técnicas. Los rumores sobre DeepSeek V4 que circulaban desde enero de 2026 hablaban de una arquitectura MoE de 1 billón de parámetros con activación optimizada a 32 mil millones, contexto de 1 millón de tokens y capacidades multimodales. Hunter Alpha cumple con todo esto excepto la parte multimodal —pero para eso está Healer Alpha, que sí es omnimodal.

Los argumentos en contra: ¿podría ser otro modelo?

Acá es donde conviene frenar el entusiasmo. Porque hay un precedente directo que debería poner en guardia a cualquiera.

El mismo proveedor anónimo de OpenRouter —la misma cuenta sin identificar— lanzó anteriormente otro modelo stealth llamado “Pony Alpha”. La comunidad especuló durante días que era un modelo de DeepSeek. Resultó ser GLM-5, de Zhipu AI, un laboratorio chino con menos prensa internacional pero con capacidades técnicas serias. El patrón se repitió: modelo anónimo, especificaciones impresionantes, especulación de que era DeepSeek, y al final era otra empresa.

Eso abre una hipótesis alternativa que varios analistas están considerando: que Hunter Alpha sea en realidad GLM-6 de Zhipu AI, y que Healer Alpha sea GLM-5V (la versión vision/multimodal). Las especificaciones de GLM-6 no son públicas, pero Zhipu venía trabajando en un modelo de escala similar. Y el modus operandi del proveedor anónimo ya tiene antecedente con Zhipu, no con DeepSeek.

También hay diferencias técnicas sutiles. Algunos analistas señalaron que el comportamiento de tokenización de Hunter Alpha no coincide exactamente con los tokenizadores conocidos de DeepSeek. Es un detalle menor, pero cuando estás tratando de identificar un modelo por sus huellas, los detalles menores importan.

Ni DeepSeek ni OpenRouter confirmaron ni desmintieron nada. OpenRouter tiene una política explícita de no revelar la identidad de los modelos stealth hasta que el proveedor lo autorice. Y DeepSeek, fiel a su estilo, no emitió comunicado alguno. Así que por ahora, todo es inferencia. Inferencia bien fundamentada, pero inferencia al fin.

Qué se sabe de DeepSeek V4: especificaciones y fecha de lanzamiento

Independientemente de si Hunter Alpha es o no DeepSeek V4, lo cierto es que V4 se viene. Y lo que se sabe de sus especificaciones es relevante para entender por qué la conexión es tan tentadora.

Según Devdiscourse, DeepSeek V4 apunta a una arquitectura Mixture of Experts con 1 billón de parámetros totales, pero con activación eficiente de solo 32 mil millones por inferencia. Eso significa que aunque el modelo es masivo en capacidad, no requiere activar todos sus parámetros para cada consulta. Es la misma estrategia que usó DeepSeek V3, pero escalada unas 3x.

El soporte multimodal nativo es otro pilar. V4 manejaría imagen, video y texto en un mismo flujo de procesamiento, algo que DeepSeek recién incorporó de manera limitada en V3.2. La ventana de contexto de 1 millón de tokens sería estándar —siguiendo la tendencia de Gemini 1.5 y Claude, que ya ofrecen ventanas similares o mayores.

Un detalle técnico interesante es la arquitectura “Engram”, presentada por Liang Wenfeng (fundador de DeepSeek) en enero de 2026. Engram es un sistema de gestión de memoria a largo plazo que permitiría al modelo mantener contexto persistente entre sesiones. No es RAG tradicional: es una capa de memoria integrada en la arquitectura del modelo. Si V4 implementa Engram, sería una diferenciación real frente a la competencia.

La fecha de lanzamiento estimada es abril de 2026. No hay fecha exacta, pero las filtraciones y el ritmo de desarrollo apuntan a la primera mitad del mes. Si Hunter Alpha efectivamente es V4 en testing, significa que DeepSeek estaría haciendo una prueba de estrés a escala masiva antes del lanzamiento público —algo que tendría mucho sentido desde el punto de vista de ingeniería.

Capacidades demostradas de Hunter Alpha en pruebas reales

Más allá de la especulación sobre su origen, Hunter Alpha mostró capacidades concretas que vale la pena evaluar por separado.

Un ejemplo específico: desarrolladores en la comunidad de OpenRouter reportaron que Hunter Alpha generó una aplicación web funcional de gestión de tareas (tipo Trello simplificado) en una sola pasada de prompt, con autenticación, base de datos SQLite y deploy a Cloudflare Workers. El código era funcional sin correcciones manuales. Para un modelo gratuito sin marca, eso es un nivel de competencia que pocos alcanzan.

Otro caso fue con Healer Alpha, el modelo omnimodal del mismo proveedor. Usuarios lo probaron para generar dashboards HTML completos a partir de capturas de pantalla de diseños en Figma. Los resultados fueron comparables a lo que producen Claude 3.5 Sonnet y GPT-4o en tareas similares, con la ventaja de que Healer Alpha era gratuito durante el período de testing.

La plataforma de agentes autónomos OpenClaw fue uno de los mayores consumidores de tokens de Hunter Alpha. La usaron como backbone para agentes de desarrollo de software que escriben, testean y despliegan código con mínima intervención humana. La velocidad de procesamiento de Hunter Alpha, combinada con su ventana de contexto de 1 millón de tokens, lo hace particularmente apto para este tipo de tareas donde el agente necesita mantener contexto de proyectos completos. Si te interesa, podes leer mas sobre integrar APIs de modelos de IA.

Eso sí: no hay benchmarks independientes formales todavía. Todo lo que se sabe de su rendimiento viene de pruebas anecdóticas de la comunidad. Sin evaluaciones estandarizadas (MMLU, HumanEval, MATH), es difícil ubicar a Hunter Alpha con precisión en el ranking de modelos. Y eso es algo que me parece un problema: un modelo que procesa 160 mil millones de tokens en días debería tener evaluaciones formales publicadas, no solo vibes de Twitter.

Tabla comparativa: Hunter Alpha vs modelos conocidos

| Característica | Hunter Alpha | DeepSeek V3 | GPT-4o | Claude 3.5 Sonnet |

|---|---|---|---|---|

| Parámetros totales | ~1 billón (MoE) | 671 mil millones (MoE) | ~1.8 billones (estimado, MoE) | No revelado |

| Contexto máximo | 1M tokens | 128K tokens | 128K tokens | 200K tokens |

| Multimodal | Solo texto (Healer Alpha = multimodal) | Texto + código | Texto, imagen, audio | Texto, imagen |

| Cadena de pensamiento (CoT) | Sí, estilo DeepSeek | Sí | Sí (o1/o3) | Sí (extended thinking) |

| Acceso gratuito | Sí (durante testing) | Sí (API gratuita limitada) | No | No |

| Origen confirmado | No (anónimo) | DeepSeek | OpenAI | Anthropic |

| Cutoff de entrenamiento | Mayo 2025 | Mayo 2025 | Octubre 2023 (original) | Abril 2024 |

Impacto en el ecosistema de modelos de IA abiertos

Lo que está pasando con Hunter Alpha trasciende la pregunta de si es DeepSeek V4 o no. El hecho de que un modelo de esta escala aparezca gratis, sin marca y en una plataforma abierta dice algo sobre hacia dónde va la industria.

OpenRouter funciona como un gateway de IA: una API unificada que da acceso a modelos de múltiples proveedores. Su sistema de “stealth models” permite que laboratorios suban modelos de forma anónima para obtener feedback real de usuarios sin el sesgo que genera una marca conocida. Si un modelo es bueno, los usuarios lo adoptan sin importar quién lo hizo. Es la versión IA de un blind test.

Esto tiene implicancias directas para la competencia. OpenAI, Anthropic y Google invierten fortunas en marketing y posicionamiento de marca. Pero si un modelo chino anónimo puede captar millones de usuarios en días solo por mérito técnico, la marca importa menos de lo que estas empresas quisieran. Para los equipos de desarrollo que eligen modelos basándose en costo-rendimiento, la identidad del proveedor es secundaria si el output es bueno y el precio es cero.

El tema es que “gratis durante testing” no es lo mismo que “gratis para siempre”. Si Hunter Alpha es DeepSeek V4, eventualmente tendrá un pricing. Pero el período gratuito genera lock-in: desarrolladores que integran Hunter Alpha en sus pipelines durante el testing después tienen que migrar o pagar. Es una estrategia de adquisición agresiva que DeepSeek ya usó con V3.

Qué significa para empresas y equipos en Latinoamérica

Si sos desarrollador o liderás un equipo técnico en la región, esto tiene dos ángulos prácticos.

El primero es de costos. DeepSeek V3 ya era significativamente más barato que GPT-4o y Claude para tareas de código y razonamiento. Si V4 mantiene esa política de precios —y todo indica que sí—, vas a tener acceso a un modelo de primer nivel por una fracción de lo que cobran OpenAI o Anthropic. Para startups y pymes latinoamericanas que operan con presupuestos ajustados en dólares, eso no es menor.

El segundo es de dependencia. Usar un modelo chino implica que tus datos pasan por infraestructura que opera bajo regulaciones distintas a las de Estados Unidos o Europa. Para proyectos internos o de desarrollo no es un problema real. Para aplicaciones que manejan datos sensibles de usuarios, es algo que tu equipo legal debería evaluar. No es un argumento para no usarlo, pero sí para tomar la decisión con los ojos abiertos.

Ahora bien, si tu stack incluye infraestructura propia —por ejemplo, con un hosting como Donweb para tus aplicaciones en la región—, podés integrar estos modelos vía API sin mover tus datos de servidor. La latencia a los endpoints de OpenRouter desde servidores en Latinoamérica es razonable para la mayoría de los casos de uso que no requieren streaming en tiempo real.

Qué está confirmado

- Hunter Alpha apareció el 11 de marzo de 2026 en OpenRouter como modelo anónimo (stealth model) con acceso gratuito.

- Sus especificaciones incluyen ~1 billón de parámetros, contexto de 1M tokens y capacidades de razonamiento con cadena de pensamiento.

- Procesó más de 160 mil millones de tokens en sus primeros días de disponibilidad.

- Healer Alpha, del mismo proveedor anónimo, es un modelo omnimodal con contexto de 262K tokens.

- El mismo proveedor anónimo publicó anteriormente “Pony Alpha”, que resultó ser GLM-5 de Zhipu AI.

- Una referencia a “DeepSeek V4 Lite” apareció brevemente en el sitio oficial de DeepSeek antes del lanzamiento de Hunter Alpha.

Qué todavía no está confirmado

- La identidad del proveedor detrás de Hunter Alpha y Healer Alpha. Ni DeepSeek, ni Zhipu AI, ni OpenRouter revelaron la autoría.

- Si Hunter Alpha es efectivamente DeepSeek V4, GLM-6 de Zhipu, o un modelo de un tercer laboratorio.

- La fecha exacta de lanzamiento de DeepSeek V4 (se estima abril 2026, pero no hay confirmación oficial).

- Benchmarks formales e independientes de Hunter Alpha en evaluaciones estándar.

- El modelo de pricing que tendrá una vez que finalice el período de testing gratuito.

Qué esperar en las próximas semanas

La ventana clave es abril de 2026. Si DeepSeek V4 se lanza oficialmente en ese período y sus especificaciones coinciden con Hunter Alpha, la conexión quedaría prácticamente confirmada. Si V4 aparece con especificaciones distintas, la hipótesis de Zhipu AI gana fuerza.

Si querés profundizar, cubrimos en detalle cómo Modelo misterioso en OpenRouter genera especulaciones sobre el futuro de los modelos.

Esto se conecta con nuestro artículo sobre el Modelo misterioso en OpenRouter genera especulaciones sobre la batalla entre estos modelos.

Si querés saber más, mirá nuestro artículo sobre Modelo misterioso en OpenRouter genera especulaciones sobre la IA en Google.

Si te interesa, podes leer mas sobre Modelo misterioso en OpenRouter genera especulaciones sobre .

Esto se conecta con Modelo misterioso en OpenRouter genera especulaciones sobre el futuro de la IA y sus implicancias en las plataformas digitales.

Esto se conecta con lo que analizamos en Modelo misterioso en OpenRouter genera especulaciones sobre el futuro del hardware dedicado para IA.

Esto se conecta con lo que analizamos en Modelo misterioso en OpenRouter genera especulaciones sobre los movimientos recientes en el ecosistema de IA.

OpenRouter podría revelar la identidad del proveedor en cualquier momento, aunque históricamente esperan a que la empresa lo autorice. Con Pony Alpha, la revelación llegó unas dos semanas después del lanzamiento stealth.

También hay que mirar a Tencent. Su modelo HunYuan está programado para una actualización mayor en abril de 2026. Con tres posibles lanzamientos de peso en el mismo mes (DeepSeek V4, GLM-6 de Zhipu y HunYuan actualizado), abril se perfila como un mes intenso para los modelos de IA chinos. La competencia interna entre laboratorios chinos está siendo tan intensa como la que tienen con los estadounidenses.

Las evaluaciones independientes de terceros son lo que realmente va a definir dónde se ubica Hunter Alpha. Los blind tests anecdóticos de la comunidad son útiles, pero hasta que no haya resultados en MMLU, HumanEval, MATH-500 y GPQA publicados por evaluadores independientes, no se puede hacer una comparación seria. Si sos de los que basan decisiones en datos, esperá a los benchmarks antes de migrar tus pipelines.

Errores comunes

Asumir que Hunter Alpha es DeepSeek V4 como hecho

La evidencia circunstancial es fuerte, pero no hay confirmación. El antecedente de Pony Alpha (que todos asumieron que era DeepSeek y resultó ser Zhipu) debería ser suficiente para no repetir el error. Tratalo como lo que es: una hipótesis bien fundada, no un hecho. Si estás tomando decisiones de infraestructura basadas en esta suposición, esperá a la confirmación oficial.

Confundir “1 billón de parámetros” con “mejor modelo del mundo”

La cantidad de parámetros no determina la calidad por sí sola. La arquitectura MoE activa solo una fracción de esos parámetros por inferencia (~32B en este caso). Lo que importa es la calidad del entrenamiento, los datos y el fine-tuning. Un modelo de 70B bien entrenado puede superar a uno de 1T mal optimizado. Evaluá por output, no por parámetros.

Integrar Hunter Alpha en producción durante el testing gratuito

El acceso gratuito es temporal y el modelo podría desaparecer, cambiar de nombre o modificar su API sin aviso. Si lo usás para experimentar, perfecto. Pero montarlo como dependencia en un producto que ya tiene usuarios es arriesgado. No sabés quién lo opera, no tenés SLA, y cuando termine el testing vas a tener que migrar de urgencia.

Esto se relaciona con Modelo misterioso en OpenRouter genera especulaciones sobre la estrategia de las grandes empresas de IA en el ecosistema open source.

Preguntas Frecuentes

¿Qué es Hunter Alpha y por qué lo relacionan con DeepSeek V4?

Hunter Alpha es un modelo de IA anónimo que apareció en la plataforma OpenRouter el 11 de marzo de 2026 con 1 billón de parámetros y contexto de 1 millón de tokens. Lo relacionan con DeepSeek V4 porque se autodescribe como “modelo chino”, comparte el cutoff de entrenamiento de mayo 2025 con DeepSeek, y sus especificaciones coinciden con los rumores previos sobre V4. Sin embargo, la autoría no fue confirmada oficialmente.

¿Cuándo se lanza oficialmente DeepSeek V4?

No hay fecha oficial confirmada, pero las filtraciones y el ritmo de desarrollo apuntan a abril de 2026. Una referencia a “DeepSeek V4 Lite” apareció brevemente en el sitio oficial de DeepSeek en marzo, lo que sugiere que el lanzamiento está cerca. Si Hunter Alpha es efectivamente V4, significaría que el modelo ya está en fase de prueba pública encubierta.

¿Qué es Healer Alpha y qué relación tiene con Hunter Alpha?

Healer Alpha es otro modelo anónimo del mismo proveedor en OpenRouter. A diferencia de Hunter Alpha (solo texto), Healer Alpha es omnimodal: procesa texto, imagen y código, con una ventana de contexto de 262.000 tokens. Todo indica que ambos forman parte del mismo paquete de lanzamiento, posiblemente representando el modelo base (Hunter) y el modelo multimodal (Healer) de una misma familia.

¿Podría Hunter Alpha ser de otra empresa y no de DeepSeek?

Sí, es una posibilidad concreta. El mismo proveedor anónimo lanzó antes “Pony Alpha”, que la comunidad asumió era DeepSeek y resultó ser GLM-5 de Zhipu AI. La hipótesis alternativa más fuerte es que Hunter Alpha sea GLM-6 de Zhipu y Healer Alpha sea GLM-5V. Hasta que el proveedor o alguna de estas empresas confirme, no hay certeza.

Conclusión

Hunter Alpha ya cambió algo concreto: demostró que un modelo de escala masiva puede aparecer de la nada en una plataforma abierta, acumular 160 mil millones de tokens de uso en días y generar más discusión técnica que muchos lanzamientos oficiales con conferencia y marketing incluido.

Si es DeepSeek V4, estamos ante un laboratorio que eligió probar su modelo a escala global antes de ponerle el nombre. Una estrategia que prioriza el feedback real sobre el hype de marca. Si es Zhipu AI con GLM-6, la conclusión es igual de interesante: hay al menos dos laboratorios chinos produciendo modelos que compiten de igual a igual con lo mejor de OpenAI y Anthropic.

Lo que conviene hacer ahora: probá Hunter Alpha si tu caso de uso lo permite, pero no lo pongas en producción. Seguí las novedades de DeepSeek y Zhipu AI durante abril. Y cuando se publiquen benchmarks independientes, ahí sí vas a tener datos reales para decidir si migrar o esperar.

Fuentes

- Medium – The Mystery of Hunter Alpha: análisis técnico del modelo anónimo en OpenRouter

- Geeky Gadgets – DeepSeek V4 stealth models: evidencia y especulaciones

- Devdiscourse – Mystery AI model sparks speculation of DeepSeek’s stealth launch

- DeepSeekV4.app – OpenRouter stealth models y la filtración de DeepSeek V4

- OpenRouter – Catálogo de modelos disponibles

![[P] Built GPT-2, Llama 3, and DeepSeek from scratch in PyTorch - open source code + book - ilustracion](https://donweb.news/wp-content/uploads/2026/04/construir-llm-desde-cero-pytorch-gpt2-llama3-deepseek-hero-768x429.jpg)