Crearon un Juego para Pelear contra Bots IA con Leyes Reales

Fix AI es un juego gratuito de navegador en fixai.dev donde enfrentás bots corporativos de inteligencia artificial usando leyes reales de defensa del consumidor. Con 37 casos basados en situaciones reales — vuelos cancelados, seguros denegados, decisiones laborales automatizadas — el juego enseña a argumentar legalmente contra sistemas de IA que rechazan reclamos, citando normativas como el GDPR, el EU AI Act y la Regulation 261/2004.

En 30 segundos

- Fix AI es un juego de navegador gratuito con 37 casos donde usás leyes reales (GDPR, AI Act, DSA) para vencer bots corporativos que niegan reclamos de consumidores

- Cada caso simula una situación real: una aerolínea que rechaza compensación automáticamente, un seguro que deniega cobertura por algoritmo, una visa rechazada sin explicación humana

- El juego funciona como herramienta educativa: aprendés qué artículos legales citar y cómo argumentar contra decisiones automatizadas de empresas como AWS, Amazon o Google

- En Argentina, la Ley de Defensa del Consumidor 24.240 y la disposición SSDCYLC 892/2025 abren camino para impugnar decisiones de IA, aunque los vacíos legales todavía son grandes

- El EU AI Act, que entra en vigencia plena en agosto de 2026, va a obligar a las empresas a clasificar sus sistemas de IA por riesgo y garantizar transparencia en decisiones automatizadas

Qué es Fix AI: el juego derechos consumidor IA que enseña a pelear contra bots corporativos

Fix AI es una aplicación web que convierte la defensa del consumidor frente a inteligencia artificial en una mecánica de juego. Entrás a fixai.dev, elegís uno de los 37 casos disponibles y te encontrás cara a cara con un bot corporativo que te niega un reclamo. Tu arma: argumentos legales reales.

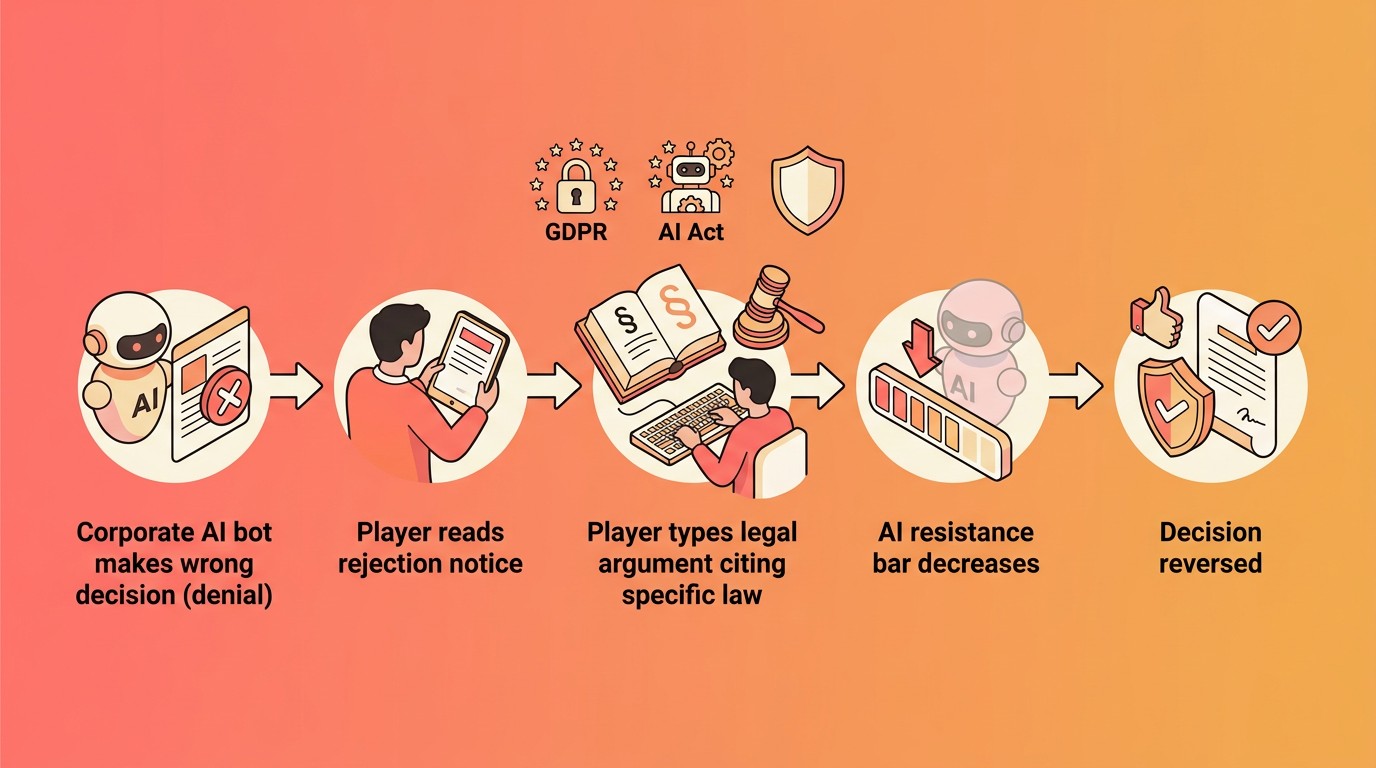

La mecánica es directa. Cada bot tiene una barra de “resistencia” que representa su confianza en la denegación. Vos seleccionás argumentos legales — artículos específicos de leyes reales — y si elegís el correcto para ese caso, la barra baja. El bot responde con objeciones corporativas típicas (“nuestra política establece que…”, “el sistema determinó automáticamente que…”) y vos tenés que contrarrestarlas con la normativa que corresponda.

Los 37 casos cubren situaciones que cualquiera puede enfrentar: una aerolínea que te rechaza la compensación por vuelo cancelado usando un chatbot, una aseguradora que deniega cobertura porque “el algoritmo determinó riesgo elevado”, una plataforma de empleo que descarta tu CV por filtro automatizado, una visa rechazada sin intervención humana. No son hipotéticos — están basados en patrones reales de reclamos documentados en Europa y Estados Unidos.

Las leyes que aparecen en el juego son reales y vigentes: el GDPR (especialmente el Artículo 22 sobre decisiones automatizadas), la Regulation 261/2004 de la UE para compensaciones aéreas, el Americans with Disabilities Act, el Digital Services Act y las disposiciones del EU AI Act que entran en vigencia progresiva durante 2026. Cada caso te enseña no solo qué ley citar, sino por qué aplica y cómo formular el argumento.

Por qué las grandes tech necesitan que no conozcas tus derechos

El contexto detrás de Fix AI no es menor. Empresas como Amazon, Google y Microsoft despliegan sistemas automatizados de atención al cliente que procesan millones de reclamos sin intervención humana. La lógica es simple: si el bot rechaza tu reclamo y vos no sabés que podés apelar, la empresa se ahorra el costo de resolver el caso. Según estimaciones del sector, más del 70% de los reclamos rechazados por sistemas automatizados nunca reciben una segunda revisión porque el usuario desiste.

AWS es un caso interesante para analizar en este contexto. Como infraestructura detrás de una porción enorme de internet, sus decisiones automatizadas afectan no solo a consumidores finales sino a empresas enteras. Según reportes de Tom’s Hardware, Amazon tuvo que convocar ingenieros para resolver incidentes causados por herramientas de IA generativa, con lo que la propia empresa describió como “high blast radius” — afectando servicios que dependen de su infraestructura cloud.

El problema de fondo es estructural. Cuando un sistema de IA toma una decisión — denegarte un servicio, cancelar tu cuenta, rechazar un reclamo — la empresa se escuda en que “fue el algoritmo”. Pero un algoritmo no es una entidad legal. La responsabilidad sigue siendo de la empresa que lo despliega. Eso es exactamente lo que Fix AI intenta que la gente entienda: que el bot no tiene la última palabra, y que hay leyes diseñadas para protegerte de decisiones automatizadas arbitrarias.

Lo que me parece más preocupante es que muchas de estas empresas publican documentos de “responsible AI” — AWS tiene el suyo — pero en la práctica, el consumidor promedio no tiene manera de saber cómo se tomó la decisión que lo afecta, ni por qué, ni cómo impugnarla. La asimetría de información es enorme.

Las leyes reales detrás del juego: GDPR, AI Act y más

Fix AI no inventa legislación. Cada argumento legal que usás en el juego corresponde a una ley vigente o en proceso de implementación. Acá va el desglose de las principales.

GDPR — Artículo 22: derecho a no ser objeto de decisiones automatizadas

El Reglamento General de Protección de Datos de la UE es probablemente el arma legal más poderosa que tiene un consumidor frente a la IA corporativa. El Artículo 22 establece que tenés derecho a no ser objeto de una decisión basada únicamente en tratamiento automatizado que produzca efectos jurídicos o te afecte significativamente. En la práctica, esto significa que si un algoritmo te deniega un préstamo, un seguro o un servicio, podés exigir que un humano revise la decisión. También tenés derecho a que te expliquen la lógica detrás de la decisión automatizada — lo que se conoce como “derecho a explicación”. Si te interesa, podés leer más sobre vulnerabilidades recientes en GitHub Actions.

EU AI Act: clasificación por riesgo y transparencia obligatoria

El EU AI Act es la regulación más ambiciosa del mundo en materia de inteligencia artificial. Su implementación es progresiva: las prohibiciones de sistemas de riesgo inaceptable ya están vigentes, y las obligaciones de transparencia para sistemas de alto riesgo entran en efecto pleno en agosto de 2026. Los sistemas de IA que evalúan crédito, seleccionan personal, gestionan seguros o toman decisiones sobre servicios públicos se clasifican como “alto riesgo” y van a tener que cumplir requisitos estrictos de documentación, supervisión humana y explicabilidad.

Regulation 261/2004: compensación por vuelos

Esta regulación europea establece compensaciones de entre 250 y 600 euros para pasajeros afectados por cancelaciones o retrasos significativos. Es una de las leyes más usadas en Fix AI porque las aerolíneas frecuentemente usan chatbots para rechazar reclamos automáticamente, citando “circunstancias extraordinarias” cuando en realidad el retraso fue operativo. El juego enseña a distinguir entre excusas válidas y maniobras corporativas para evitar el pago.

Digital Services Act (DSA)

El DSA obliga a las plataformas a dar explicaciones claras cuando moderan o remueven contenido, y establece mecanismos de apelación. Si una IA te baja un post, te cierra una cuenta o te restringe un servicio, la plataforma tiene que explicarte por qué y darte una vía para apelar ante una persona real. Fix AI incluye casos basados en esta ley, especialmente los relacionados con cierre de cuentas y denegación de servicios digitales.

| Ley / Regulación | Alcance geográfico | Qué protege | Artículo clave | Vigencia |

|---|---|---|---|---|

| GDPR | Unión Europea (+ efecto extraterritorial) | Derecho a no ser objeto de decisiones 100% automatizadas | Art. 22 | Vigente desde 2018 |

| EU AI Act | Unión Europea | Transparencia y supervisión humana en IA de alto riesgo | Título III | Plena: agosto 2026 |

| Regulation 261/2004 | Vuelos desde/hacia la UE | Compensación por cancelaciones y retrasos aéreos | Art. 5, 7 | Vigente desde 2005 |

| DSA | Unión Europea | Explicación y apelación ante moderación automatizada | Art. 17, 20 | Vigente desde 2024 |

| Ley 24.240 (Argentina) | Argentina | Trato digno, información veraz, resolución de reclamos | Art. 8 bis, 4 | Vigente desde 1993 |

Gamificación como herramienta de educación en derechos digitales

La pregunta obvia es: ¿por qué un juego? La respuesta corta es que nadie lee legislación por voluntad propia. El GDPR tiene 99 artículos y 173 considerandos. El EU AI Act supera las 400 páginas. Esperar que un consumidor promedio se siente a estudiar eso para saber sus derechos es irreal.

Fix AI resuelve esto con una mecánica que genera engagement natural. Cuando ganás un caso contra un bot corporativo, sentís la satisfacción de haber “vencido al sistema” — y en el proceso internalizás qué ley aplica a cada situación. Es aprendizaje por experiencia, no por lectura pasiva. La barra de resistencia del bot funciona como feedback inmediato: si citás la ley correcta, la barra baja; si errás el argumento, el bot refuerza su posición con una objeción que tenés que resolver.

Hay un aspecto que me parece particularmente inteligente: los 37 casos están diseñados para cubrir las situaciones más comunes en las que un consumidor se encuentra frente a una IA corporativa. No son ejercicios teóricos — son escenarios que replican lo que pasa cuando llamás al servicio técnico de una empresa grande y te atiende un bot que te da vueltas sin resolver nada. La diferencia es que acá, en vez de frustrarte, aprendés la herramienta legal para salir de esa situación.

Otros proyectos educativos sobre derechos digitales existen — la EFF publica guías, la UE tiene portales informativos — pero tienden a ser estáticos, densos y poco accesibles para quien no tiene formación legal. Fix AI no reemplaza la consulta con un abogado, pero sí nivela un poco la cancha: te da el vocabulario y el marco legal básico para que tu reclamo no se pierda en el primer filtro automatizado.

Situación en Argentina y Latinoamérica: qué derechos tenemos frente a la IA

Acá la situación es bastante distinta a Europa. Argentina tiene la Ley de Defensa del Consumidor 24.240, que establece derechos fundamentales como trato digno (Art. 8 bis), información veraz y detallada (Art. 4) y mecanismos de resolución de conflictos. Lo que no tiene es una regulación específica para decisiones automatizadas.

La disposición SSDCYLC 892/2025 actualizó el Sistema Nacional de Arbitraje de Consumo (SNAC) y abrió la puerta a la presentación digital de reclamos. El chatbot TINA, implementado por la Secretaría de Comercio, atiende consultas iniciales de consumidores y deriva a canales humanos cuando corresponde. Es un uso de IA al servicio del consumidor, aunque con limitaciones — TINA puede orientarte, pero no tiene capacidad resolutiva real. Si te interesa, podés leer más sobre malware oculto en repositorios de código.

El vacío más grande está en la falta de equivalente al Artículo 22 del GDPR. Si una empresa en Argentina usa un algoritmo para denegarte un servicio, no hay una norma que te garantice explícitamente el derecho a una revisión humana de esa decisión. La Ley 25.326 de Protección de Datos Personales tiene algunas disposiciones sobre decisiones automatizadas, pero su alcance es limitado y su enforcement, débil. Según análisis de Ribon.es, la discriminación algorítmica es un problema creciente que la legislación latinoamericana todavía no aborda de forma integral.

En el resto de Latinoamérica el panorama es similar. Brasil tiene la LGPD, que incluye algunas protecciones frente a decisiones automatizadas (Art. 20), pero su implementación es desigual. Chile avanzó con su nueva ley de datos personales. México y Colombia están en fases más tempranas. La brecha con Europa es grande, y mientras no se cierre, los consumidores latinoamericanos dependen de leyes generales de consumo que no fueron pensadas para lidiar con inteligencia artificial.

Cómo reclamar contra una decisión automatizada: guía práctica

Esto es lo que Fix AI enseña y lo que podés aplicar en la vida real. El proceso tiene una lógica clara, y cuanto más específico seas en tu argumento, más chances tenés de que el reclamo avance.

Paso 1: Identificá qué tipo de decisión automatizada enfrentás. No es lo mismo un chatbot de atención al cliente que un algoritmo que decide si te aprueba un crédito. El chatbot es una interfaz; el algoritmo de scoring es una decisión sustantiva. Tu reclamo tiene que apuntar a la decisión, no a la interfaz.

Paso 2: Determiná qué jurisdicción y qué ley aplica. Si la empresa opera en la UE o procesa datos de residentes europeos, el GDPR aplica — incluso si vos estás en Argentina. Para vuelos desde o hacia la UE, la Regulation 261/2004 aplica sin importar la nacionalidad de la aerolínea. Para servicios contratados en Argentina, la Ley 24.240 es tu base.

Paso 3: Citá el artículo específico. No alcanza con decir “tengo derechos”. Tenés que decir “conforme al Artículo 22(1) del GDPR, tengo derecho a no ser objeto de una decisión basada únicamente en tratamiento automatizado que produzca efectos jurídicos sobre mi persona”. La especificidad obliga al equipo legal de la empresa a tomarte en serio.

Paso 4: Exigí la intervención humana por escrito. El reclamo tiene que quedar documentado. Si estás en un chat, pedí número de ticket. Si mandás un mail, usá correo certificado o al menos guardá evidencia de envío. Solicitá explícitamente que un agente humano revise la decisión y te proporcione la lógica detrás del resultado automatizado.

Paso 5: Escalá si no hay respuesta. En Argentina, podés presentar reclamo ante la Dirección Nacional de Defensa del Consumidor. En la UE, cada país tiene su autoridad de protección de datos (DPA). Para reclamos contra AWS o Amazon, Baker McKenzie publicó una guía sobre el marco legal aplicable a chatbots e IA en Estados Unidos, útil para entender las vías disponibles en esa jurisdicción.

Ejemplo concreto 1: Supongamos que Ryanair te cancela un vuelo Madrid-Buenos Aires y el chatbot te ofrece un voucher en vez de compensación en efectivo. Citás el Artículo 7 de la Regulation 261/2004, que establece una compensación de 600 euros para vuelos de más de 3.500 km. El bot te dice que la cancelación fue por “circunstancias extraordinarias”. Vos respondés pidiendo que especifiquen la circunstancia concreta, porque la carga de la prueba recae en la aerolínea según jurisprudencia del Tribunal de Justicia de la UE. En un porcentaje alto de casos, la aerolínea termina pagando porque no puede documentar la “circunstancia extraordinaria”. Si te interesa, podés leer más sobre integrar inteligencia artificial en tus proyectos.

Ejemplo concreto 2: Una plataforma de empleo descarta tu CV automáticamente. Si la empresa opera en la UE, invocás el Artículo 22 del GDPR y solicitás: (a) confirmación de que se usó un proceso de decisión automatizado, (b) información sobre la lógica involucrada, y (c) las consecuencias previstas de dicho procesamiento. La empresa está legalmente obligada a proporcionarte esa información en un plazo máximo de 30 días.

El futuro: regulación de IA corporativa en 2026 y más allá

Agosto de 2026 es una fecha bisagra. Ahí entran en plena vigencia las obligaciones del EU AI Act para sistemas de alto riesgo: evaluaciones de impacto obligatorias, supervisión humana documentada, registros de decisiones automatizadas accesibles para los usuarios. Las empresas que operen en la UE — o que ofrezcan servicios a ciudadanos europeos — van a tener que cumplir o enfrentar multas de hasta el 7% de su facturación global.

En Estados Unidos, la regulación avanza por estados. Illinois tiene la Artificial Intelligence Video Interview Act, que regula el uso de IA en procesos de selección. Texas aprobó legislación sobre transparencia algorítmica. La guía de la Casa Blanca sobre IA Bill of Rights plantea principios — protección contra discriminación algorítmica, privacidad de datos, aviso y explicación — pero sin fuerza legal vinculante.

AWS, por su parte, declara soportar 143 estándares de compliance en su infraestructura cloud, según su blog de machine learning. La pregunta real es si ese compliance se traduce en protecciones concretas para el consumidor final o si se queda en certificaciones internas que el usuario nunca ve ni puede invocar. Mi impresión es que todavía falta bastante para que las políticas de “responsible AI” de las big tech se traduzcan en derechos ejecutables para las personas.

La tendencia global, eso sí, es clara: más regulación, más transparencia obligatoria, más derechos del consumidor frente a decisiones automatizadas. Proyectos como Fix AI se adelantan a esa curva. Si la regulación va a obligar a las empresas a explicar sus decisiones de IA, tiene sentido que los consumidores empiecen a entender qué preguntar y cómo preguntar.

Qué significa para empresas y equipos en Latinoamérica

Si administrás servicios web o gestionás atención al cliente automatizada en la región, hay algo que conviene internalizar: la tendencia regulatoria europea tiene efecto cascada. Las empresas que operan globalmente — o que usan infraestructura cloud como AWS, Azure o GCP — van a tener que cumplir con el EU AI Act si procesan datos de usuarios europeos. Y esos mismos estándares tienden a convertirse en el piso mínimo que adoptan las legislaciones locales eventualmente.

Para quienes tienen sitios en WordPress o manejan ecommerce en la región, el impacto es más directo de lo que parece. Si usás plugins de chat automatizado, sistemas de scoring de clientes o herramientas de moderación con IA, tu responsabilidad como operador del servicio sigue vigente aunque la decisión la tome el algoritmo. Si necesitás infraestructura para correr estos servicios con compliance adecuado, Donweb ofrece planes de hosting y cloud con data centers en Latinoamérica, lo que simplifica la cuestión de jurisdicción de datos para la región.

El consejo práctico: auditá qué decisiones automatizadas tomás sobre tus usuarios y asegurate de tener un mecanismo de revisión humana accesible. No porque hoy la ley argentina lo exija explícitamente, sino porque va a exigirlo — y porque es mejor adelantarse que correr después.

Errores comunes

Creer que si un bot te rechaza un reclamo, la decisión es definitiva

Es el error más frecuente y el que más le conviene a las empresas. Un chatbot de atención al cliente no tiene autoridad legal para resolver un reclamo de forma definitiva. Su respuesta es una primera instancia automatizada, no un fallo judicial. Siempre podés escalar: pedí revisión humana, presentá reclamo formal ante la empresa, o acudí a la autoridad de consumo correspondiente. El hecho de que un bot diga “su reclamo fue evaluado y denegado” no significa que se haya evaluado realmente. Si te interesa, podés leer más sobre la batalla entre gigantes tecnológicos por la IA.

Pensar que el GDPR solo aplica si vivís en Europa

El GDPR tiene efecto extraterritorial. Si una empresa europea procesa tus datos — o si una empresa de cualquier parte del mundo ofrece servicios a residentes de la UE — el GDPR aplica. Si contrataste un servicio de una empresa con sede en la UE, o si tu proveedor cloud almacena datos en servidores europeos, podés invocar el GDPR independientemente de tu ubicación física. Eso sí: el enforcement depende de que la autoridad de protección de datos correspondiente actúe, lo cual no siempre es ágil.

Asumir que la empresa es responsable solo si intervino un humano

Una idea errónea bastante difundida: “si fue el algoritmo, la empresa no es responsable”. Incorrecto. La empresa que despliega un sistema de IA es legalmente responsable de las decisiones que ese sistema toma. No importa si ningún humano vio tu caso específico. La responsabilidad legal recae en quien implementa y opera el sistema automatizado. Tanto el GDPR como el EU AI Act dejan esto claro, y la Ley de Defensa del Consumidor argentina (Art. 40) establece responsabilidad solidaria en toda la cadena de comercialización.

Acá tenés un juego donde enfrentás bots de IA corporativos: I built a browser game where you fight corporate AI bots usi.

Esto se relaciona con lo que exploramos en I built a browser game where you fight corporate AI bots usi.

Si querés saber más sobre los desafíos legales, mirá I built a browser game where you fight corporate AI bots usi.

Si querés profundizar, I built a browser game where you fight corporate AI bots usi trata el tema en detalle.

Mirá, tenemos un artículo sobre esto: I built a browser game where you fight corporate AI bots usi.

Si querés ver cómo juega y funciona la IA corporativa, revisá I built a browser game where you fight corporate AI bots usi.

Si el tema te interesa, explorá I built a browser game where you fight corporate AI bots usi en profundidad.

Si querés saber más del tema, tenemos un artículo en I built a browser game where you fight corporate AI bots usi.

Podés leer más al respecto en I built a browser game where you fight corporate AI bots usi.

Preguntas Frecuentes

¿Qué es Fix AI y cómo funciona el juego de derechos del consumidor?

Fix AI es un juego gratuito de navegador disponible en fixai.dev con 37 casos donde argumentás legalmente contra bots corporativos que niegan reclamos. Seleccionás argumentos basados en leyes reales (GDPR, EU AI Act, Regulation 261/2004) y si citás la normativa correcta para cada situación, reducís la “barra de resistencia” del bot hasta vencerlo. Funciona como una herramienta educativa que enseña qué leyes citar y cómo formular reclamos contra decisiones automatizadas.

¿Se puede reclamar legalmente contra una decisión tomada por inteligencia artificial?

Sí. La empresa que opera el sistema de IA es legalmente responsable de sus decisiones. En la UE, el Artículo 22 del GDPR te da derecho a exigir intervención humana, expresar tu punto de vista y impugnar la decisión. En Argentina, la Ley 24.240 de Defensa del Consumidor establece que tenés derecho a trato digno y a información veraz, independientemente de si quien te atiende es un humano o un bot.

¿Qué derechos tengo como consumidor frente a chatbots y sistemas automatizados en Argentina?

La Ley 24.240 te protege con derecho a información clara (Art. 4), trato digno (Art. 8 bis) y resolución efectiva de conflictos. La disposición SSDCYLC 892/2025 actualizó el SNAC para reclamos digitales. Lo que todavía falta es una norma equivalente al GDPR que garantice específicamente el derecho a revisión humana de decisiones automatizadas. Podés presentar reclamos a través de la plataforma de Defensa del Consumidor o del chatbot TINA.

¿Cómo uso el GDPR para impugnar decisiones de IA corporativas?

Invocá el Artículo 22(1) y solicitá por escrito: confirmación de que la decisión fue automatizada, la lógica utilizada, y revisión por un humano. La empresa tiene 30 días para responder. Si no responde o la respuesta no es satisfactoria, podés presentar queja ante la autoridad de protección de datos del país europeo donde opera la empresa. El GDPR aplica incluso si no vivís en la UE, siempre que la empresa procese datos bajo jurisdicción europea.

Conclusión

Fix AI pone en evidencia algo que debería ser obvio pero que las empresas prefieren que no sepas: las decisiones de IA corporativa no son inapelables. Hay leyes vigentes — GDPR, EU AI Act, regulaciones de aviación, normas de consumo — que te dan herramientas concretas para impugnar decisiones automatizadas. El juego convierte esas herramientas en algo accesible y practicable.

Lo que cambió concretamente es que ahora existe un recurso educativo gratuito con 37 casos reales que te enseña la mecánica de argumentación legal contra bots corporativos. No reemplaza a un abogado, pero te da el vocabulario y el marco para que tu reclamo no muera en el primer filtro automático. Para quienes estamos en Argentina y Latinoamérica, el gap regulatorio frente a Europa sigue siendo grande, pero la Ley de Defensa del Consumidor ya ofrece un piso mínimo de protección que muchos desconocen.

Conviene seguir de cerca la implementación plena del EU AI Act en agosto de 2026 — va a marcar el estándar que eventualmente adopte el resto del mundo. Mientras tanto, probá Fix AI en fixai.dev. Aunque sea un juego, los argumentos legales que aprendés son reales. Y la próxima vez que un bot te diga que tu reclamo fue “evaluado y denegado”, vas a saber que eso no es el final de la conversación.

Fuentes

- Fix AI – Juego de derechos del consumidor contra bots corporativos de IA

- Comisión Europea – Marco regulatorio para la inteligencia artificial (EU AI Act)

- AWS Machine Learning Blog – Protección del consumidor y regulación de IA responsable

- Defensa del Consumidor Argentina – Secretaría de Comercio

- Baker McKenzie – Marco legal de chatbots y asistentes de IA en Estados Unidos (2026)