NVIDIA libera su driver GPU para Kubernetes al open source

NVIDIA donó su Dynamic Resource Allocation (DRA) Driver para GPUs a la Cloud Native Computing Foundation (CNCF) durante KubeCon Europe 2026 en Amsterdam, transfiriendo el control de la orquestación GPU en Kubernetes del vendor a la comunidad open source. AWS, Google Cloud, Microsoft, Red Hat y otras empresas ya colaboran en el código.

En 30 segundos

- NVIDIA transfirió la propiedad de su DRA Driver para GPUs a la CNCF, permitiendo que cualquier desarrollador contribuya sin depender del vendor

- El driver soporta GPU sharing con MPS y MIG, interconexiones NVLink multi-nodo y reconfiguración dinámica en runtime

- AWS, Google Cloud, Microsoft, Red Hat, Canonical, Broadcom, Nutanix y SUSE participan del desarrollo colaborativo

- El KAI Scheduler fue aceptado como proyecto Sandbox de la CNCF, sumando colas jerárquicas y gang scheduling para IA

- También se anunció soporte GPU para Kata Containers, extendiendo computación confidencial a cargas de trabajo con aceleración de hardware

Qué anunció NVIDIA en KubeCon Europe 2026

Amsterdam, marzo de 2026. NVIDIA subió al escenario de KubeCon Europe con una serie de anuncios que apuntan todos en la misma dirección: soltar el control.

El movimiento principal fue la donación del DRA Driver for GPUs a la CNCF. Según Phoronix, la intención de NVIDIA es “hacer que la orquestación GPU de alto rendimiento sea accesible para todos”. Pero no fue lo único. También donó el KAI Scheduler como proyecto Sandbox de la CNCF, anunció soporte GPU para Kata Containers y siguió empujando proyectos open source que había presentado la semana anterior en GTC: NVSentinel para remediación de fallos en GPUs, el framework agentic Grove, y herramientas como NemoClaw y OpenShell.

Muchos anuncios juntos. ¿Por qué importa?

Porque la gran mayoría de las cargas de trabajo de IA aceleradas por GPU en entornos empresariales ya corren sobre Kubernetes, según Help Net Security. Que el driver que conecta Kubernetes con las GPUs deje de estar controlado por un solo vendor cambia las reglas de juego para cualquier equipo que opere infraestructura de IA.

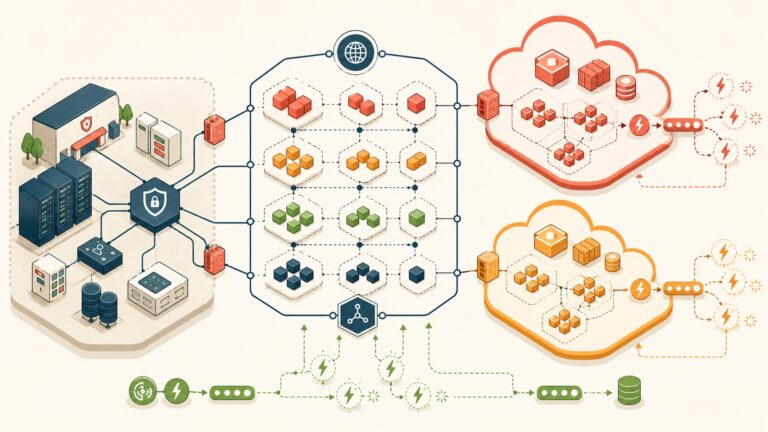

Qué es el DRA Driver y por qué importa

Dynamic Resource Allocation (DRA) es un mecanismo relativamente nuevo en Kubernetes para solicitar, configurar y compartir dispositivos de hardware como GPUs. El DRA Driver se ubica entre Kubernetes y el hardware GPU, manejando cómo se asignan los recursos de cómputo a los contenedores. Si te interesa, podés leer más sobre soluciones de hosting en la nube.

Antes existía el Device Plugin framework. El problema con ese enfoque era simple y frustrante: un contenedor monopolizaba una GPU entera. Tenías una A100 de 80GB corriendo un modelo que necesitaba 10GB y los otros 70GB quedaban ahí, calentando aire. Con DRA, el paradigma cambia. En vez de pedir “quiero 2 GPUs”, podés usar ResourceClaims para especificar capacidades concretas: “necesito una GPU con 16GB+ de memoria y capacidades de cómputo específicas”. Es la diferencia entre pedir “un auto” y pedir “un auto con tracción integral y 300 caballos”.

El driver también soporta ComputeDomains, que permiten comunicación NVLink multi-nodo. En la práctica, esto hace que workloads distribuidos en múltiples nodos funcionen como si tuvieran una sola GPU masiva, algo crítico para los sistemas Grace Blackwell GB200 de NVIDIA.

Capacidades técnicas del driver donado

El código ya está disponible en GitHub (NVIDIA/k8s-dra-driver-gpu). No es un anuncio de intenciones, es código funcional con estas capacidades:

- GPU sharing mediante Multi-Process Service (MPS): múltiples contenedores comparten una GPU con aislamiento de procesos

- Multi-Instance GPU (MIG): particiona una GPU física en instancias aisladas, cada una con cómputo y memoria dedicados

- Soporte nativo para interconexiones NVLink multi-nodo

- Reconfiguración dinámica de hardware en runtime (sin reiniciar pods)

- Solicitudes granulares de configuraciones de memoria e interconexión específicas

Ponele que tenés un cluster con 8 GPUs A100 corriendo inferencia. Con MIG, cada A100 puede particionarse en hasta 7 instancias aisladas. Eso sí: no todas las particiones son iguales, y configurar MIG a mano es un proceso que cualquiera que lo haya intentado sabe que consume más tiempo del que debería. El DRA Driver automatiza esa gestión. Si te interesa, podés leer más sobre la KubeCon Europe 2026 en Amsterdam.

Las empresas detrás del esfuerzo colaborativo

Acá viene lo interesante. No es solo NVIDIA soltando código y esperando que alguien lo adopte.

AWS, Broadcom, Canonical, Google Cloud, Microsoft, Nutanix, Red Hat y SUSE ya están trabajando en el driver. Los tres grandes cloud providers integran DRA en sus servicios gestionados de Kubernetes: Google Cloud en GKE, Microsoft en AKS, AWS lo demostró con instancias EC2 P6e-GB200. Canonical destacó la integración con Charmed Kubernetes.

¿Qué significa en la práctica? Que si usás Kubernetes gestionado en cualquier nube grande, el soporte para DRA ya está en camino. No vas a depender de que NVIDIA mergee tu PR.

KAI Scheduler: orquestación inteligente de GPUs para IA

El KAI Scheduler fue aceptado como proyecto Sandbox de la CNCF. Construye sobre el GPU Operator y el DRA Driver, agregando una capa de inteligencia al scheduling que Kubernetes por sí solo no tiene. Si te interesa, podés leer más sobre comparativa de rendimiento Apple vs Nvidia.

Tres funcionalidades clave: asignación fraccionada de GPUs (podés asignar 0.5 GPUs a un pod), colas jerárquicas para priorizar workloads, y gang scheduling para entrenamiento distribuido. El gang scheduling resuelve un problema muy específico: cuando un job de entrenamiento necesita 32 GPUs, arranca solo cuando las 32 están disponibles. Sin eso, terminás con 28 GPUs reservadas esperando las 4 que faltan, bloqueando recursos sin hacer nada.

Contenedores confidenciales con GPU: Kata Containers

NVIDIA anunció soporte GPU para Kata Containers, en colaboración con la comunidad Confidential Containers de la CNCF. Kata son VMs livianas que actúan como contenedores pero con aislamiento de hardware, no solo de kernel.

Agregar GPU a ese entorno aislado extiende la aceleración de hardware a escenarios donde los datos son sensibles. Pensá en modelos de IA que procesan datos médicos, financieros o legales: necesitás la GPU para que el modelo corra a velocidad razonable, pero también necesitás garantías de aislamiento que un contenedor estándar no te da. Para equipos que trabajan con compliance estricto (HIPAA, PCI-DSS), esto desbloquea cargas de trabajo que antes quedaban relegadas a CPU. Si te interesa, podés leer más sobre el enfrentamiento entre Nvidia y OpenAI.

Grove y Dynamo: orquestación declarativa de IA

Grove es una API open source de Kubernetes, parte del ecosistema Dynamo de NVIDIA. Permite definir sistemas de inferencia complejos en un solo recurso declarativo, con tres conceptos centrales:

- PodCliques: roles dentro del sistema (prefill worker, decode leader, frontend service)

- PodCliqueScalingGroups: escalado coordinado entre componentes relacionados

- PodCliqueSets: workloads multi-componente con orden de arranque y gang scheduling

Se integra con el stack de inferencia llm-d y puede usarse standalone o con Dynamo. En la práctica, si estás armando un pipeline de inferencia con múltiples modelos que se comunican entre sí, Grove te deja declararlo en YAML en vez de orquestar manualmente cada pieza.

DRA Driver vs GPU Operator vs Device Plugin

| Característica | Device Plugin (legacy) | GPU Operator | DRA Driver (nuevo) |

|---|---|---|---|

| GPU sharing | No (1 GPU = 1 contenedor) | Sí, con configuración manual | Sí, nativo con MPS y MIG |

| Solicitudes granulares | Solo cantidad (“nvidia.com/gpu: 2”) | Limitado | ResourceClaims con capacidades específicas |

| Multi-nodo NVLink | No | Parcial | Sí, via ComputeDomains |

| Reconfiguración en runtime | No | No | Sí |

| Propiedad del código | NVIDIA | NVIDIA | CNCF (comunidad) |

| Quién puede contribuir | Solo NVIDIA | Solo NVIDIA | Cualquier desarrollador |

| Soporte cloud providers | Sí | Sí | AWS, GCP, Azure ya integran |

Impacto para equipos DevOps y MLOps en producción

La combinación DRA + KAI + Grove ofrece un stack completo open source para orquestación de GPU en Kubernetes. Eso es nuevo. Hasta ahora, armar algo así requería mezclar componentes de NVIDIA con configuraciones manuales y scripts propios.

Si tu equipo corre workloads de IA en Kubernetes y todavía usa el Device Plugin framework, evaluar la migración al DRA Driver tiene sentido ahora que el código es comunitario y los tres grandes cloud providers ya trabajan en él. El Device Plugin no va a desaparecer mañana, pero tampoco va a recibir las funcionalidades nuevas. Si te interesa, podés leer más sobre nuestra guía sobre GPUs para inteligencia artificial.

Para empresas en Latinoamérica que operan clusters on-premise o en proveedores regionales como donweb.com, la adopción del DRA Driver significa acceder a las mismas capacidades de orquestación GPU que antes solo estaban disponibles configurando todo a mano o usando servicios gestionados de los hyperscalers.

Errores comunes

Asumir que el DRA Driver reemplaza al GPU Operator

Son complementarios. El GPU Operator maneja la instalación de drivers, toolkit y monitoreo de GPUs en el nodo. El DRA Driver gestiona cómo Kubernetes asigna y comparte esas GPUs entre pods. Necesitás los dos.

Configurar MIG sin planificar las particiones

MIG no permite cualquier combinación de particiones. Una A100 de 80GB soporta perfiles específicos (1g.10gb, 2g.20gb, 3g.40gb, 7g.80gb, entre otros) y no todos son compatibles entre sí. Si particionás mal, terminás con fragmentación de memoria que desperdicia más recursos de los que ahorrás.

Ignorar el gang scheduling para entrenamiento distribuido

Lanzar un job de entrenamiento que necesita 16 GPUs sin gang scheduling puede resultar en deadlock: el scheduler asigna 12 GPUs, el job queda esperando las 4 restantes, y esas 12 quedan bloqueadas sin hacer nada. Con KAI Scheduler, el job solo arranca cuando todos los recursos están disponibles. Si te interesa, podés leer más sobre la relación entre Microsoft y GitHub.

Si te interesa, podés leer más en nuestro artículo sobre NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Si querés saber cómo esto impacta tu infraestructura, mirá NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Si querés profundizar, mirá NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Esto se conecta directamente con NVIDIA dona su driver GPU para Kubernetes a la comunidad ope, donde cubrimos el tema en detalle.

Esto se vincula con NVIDIA dona su driver GPU para Kubernetes a la comunidad ope, donde cubrimos el tema en profundidad.

En la misma línea, tenemos NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Hablamos del tema en profundidad acá: NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Esto va de la mano con lo que cubrimos en NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Relacionado con esto, NVIDIA dona su driver GPU para Kubernetes a la comunidad ope muestra cómo la industria apuesta a lo open source.

Si te interesa profundizar, mirá NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Para más detalles técnicos, revisá nuestro artículo sobre NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Podés ampliar la perspectiva en NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Mirá NVIDIA dona su driver GPU para Kubernetes a la comunidad ope para conocer cómo el gigante tecnológico apoya al open source.

Esto lo cubrimos con más detalle en NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Tenés más detalles sobre esto en NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Para más contexto, leé nuestro artículo sobre NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Esto se conecta con NVIDIA dona su driver GPU para Kubernetes a la comunidad ope, donde tocamos infraestructura abierta.

En otro artículo cubrimos NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Esto se conecta directamente con NVIDIA dona su driver GPU para Kubernetes a la comunidad ope, donde analizamos la infraestructura cloud.

Esto se cruza directamente con NVIDIA dona su driver GPU para Kubernetes a la comunidad ope, donde cubrimos todo sobre despliegues optimizados.

Esto se conecta directo con NVIDIA dona su driver GPU para Kubernetes a la comunidad ope, donde profundizamos en la optimización de gastos.

Esto se vincula con lo que cubrimos sobre NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Relacionado con esto, tenemos un análisis detallado sobre NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Si querés profundizar en DevOps, mirá nuestro artículo sobre NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

En la misma línea, NVIDIA dona su driver GPU para Kubernetes a la comunidad ope profundiza más en el tema.

Para ampliar sobre esto, echá un vistazo a NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Esto se conecta con nuestro análisis sobre NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Para profundizar en cómo optimizar tus clusters, mirá NVIDIA dona su driver GPU para Kubernetes a la comunidad ope.

Preguntas Frecuentes

¿Qué es el DRA Driver de NVIDIA y por qué lo donó a la CNCF?

El DRA Driver es el componente que conecta Kubernetes con las GPUs, permitiendo asignar, compartir y reconfigurar recursos de cómputo GPU de forma dinámica. NVIDIA lo donó para que la comunidad open source tenga propiedad total del código, eliminando la dependencia de un solo vendor para proponer cambios al scheduling de GPU en Kubernetes.

¿Qué diferencia hay entre el GPU Operator y el DRA Driver?

El GPU Operator se encarga de instalar y mantener los drivers NVIDIA, el container toolkit y las herramientas de monitoreo en cada nodo del cluster. El DRA Driver opera una capa más arriba, gestionando cómo Kubernetes reparte y comparte las GPUs entre los pods. Son piezas distintas del mismo stack.

¿Puedo usar el DRA Driver hoy en producción?

El código está disponible en GitHub y AWS, Google Cloud y Microsoft ya integran DRA en sus servicios gestionados. La madurez del driver para producción depende de tu caso de uso, pero el respaldo de los tres hyperscalers y la CNCF acelera su adopción. Evaluá en un cluster de staging antes de migrar.

¿Qué es el KAI Scheduler y cómo mejora la orquestación GPU?

KAI Scheduler agrega asignación fraccionada de GPUs, colas jerárquicas y gang scheduling sobre Kubernetes. Resuelve problemas concretos como la subutilización de GPUs caras y los deadlocks en entrenamiento distribuido. Fue aceptado como proyecto Sandbox de la CNCF, lo que le da gobernanza comunitaria y un path de adopción claro.

Conclusión

NVIDIA pasó de controlar la orquestación de GPUs en Kubernetes a entregarla a la comunidad. Con el DRA Driver bajo la CNCF, el KAI Scheduler como sandbox, y los tres grandes cloud providers ya integrando el código, el ecosistema de IA sobre Kubernetes gana un stack de orquestación GPU que no depende de un solo vendor. Si tu equipo opera infraestructura de IA en Kubernetes, este es el momento de evaluar la migración del Device Plugin al DRA Driver y explorar KAI Scheduler para optimizar la utilización de GPUs que, seamos honestos, no son baratas.

Fuentes

- NVIDIA Blog – Anuncio oficial de NVIDIA en KubeCon Europe 2026

- Help Net Security – NVIDIA puts GPU orchestration in community hands

- Phoronix – NVIDIA talks up expanding the open-source horizon around AI and Kubernetes

- GitHub – Repositorio oficial del DRA Driver for GPUs

- The New Stack – NVIDIA open sources KAI Scheduler for GPU utilization