Portkey liberó gratis su Gateway de IA: 1 billón tokens/día

Portkey liberó como open source su Gateway de IA completo, incluyendo gobernanza, observabilidad y control de costos que antes requerían suscripción de pago. El gateway ya procesa más de 1 billón de tokens y 120 millones de requests por día en producción, y lo usan más de 24.000 organizaciones a nivel global.

En 30 segundos

- Portkey hizo open source todo su Gateway de IA, incluyendo funcionalidades enterprise que antes eran exclusivas del SaaS pago

- Procesa 1T+ tokens diarios y gestiona más de $180 millones en gasto de IA anualizado para 24.000+ organizaciones

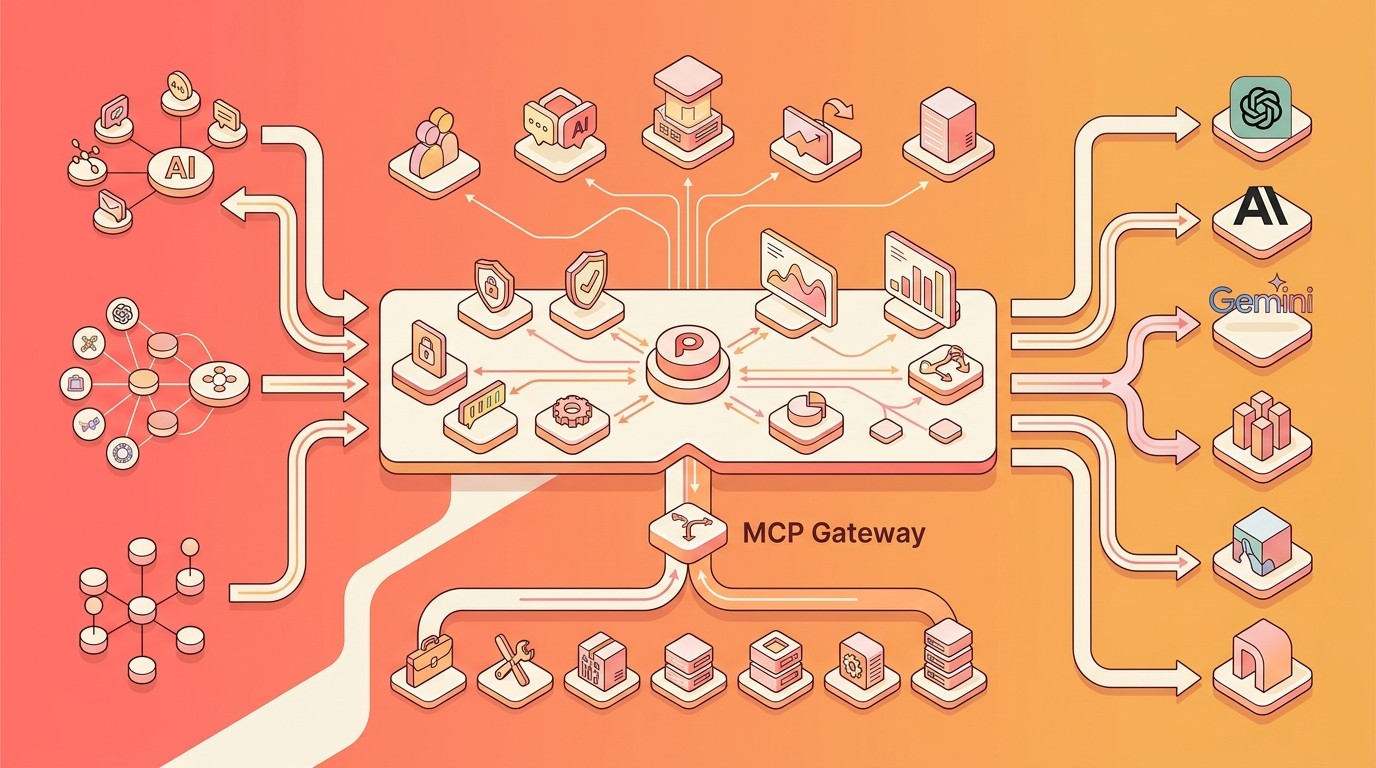

- Nuevo MCP Gateway para gobernar agentes de IA: registro centralizado, autenticación unificada y observabilidad end-to-end

- Soporta 200+ LLMs y 1.600+ modelos con latencia menor a 1ms y un footprint de apenas 122kb

- Disponible gratis en GitHub (Portkey-AI/gateway) para self-hosting o despliegue cloud

Qué es Portkey Gateway y por qué importa que sea open source

Un AI gateway es, en criollo, un proxy inteligente que se pone entre tu aplicación y los proveedores de modelos de lenguaje. En vez de que tu código hable directamente con OpenAI, Anthropic o Gemini, le habla al gateway, y el gateway se encarga del enrutamiento, los reintentos, el balanceo de carga, el cacheo y —lo más importante en producción— el control de quién usa qué, cuánto gasta y qué pasa si algo se rompe.

Portkey venía ofreciendo esto desde hace un tiempo, pero con un modelo freemium: el gateway básico era open source y las funcionalidades enterprise iban por SaaS. A partir del 24 de marzo de 2026, eso cambió. Todo el paquete —gobernanza, observabilidad, autenticación OAuth 2.1, control de costos— quedó abierto.

¿Por qué importa? Porque no estamos hablando de un proyecto chico. Portkey gestiona más de $180 millones en gasto de IA anualizado. La empresa, fundada por Rohit Agarwal, cerró una Serie A de $15 millones en febrero de 2026 liderada por Elevation Capital con participación de Lightspeed. Tenían un negocio SaaS rentable y decidieron abrir todo. Eso no se ve todos los días.

Funcionalidades clave del Gateway unificado

Lo que antes requerías pagar ahora viene incluido en el paquete open source. Fijate el alcance: Si te interesa, podés leer más sobre la crisis de bots IA en proyectos open source.

- Enrutamiento universal: 200+ LLMs, 1.600+ modelos. Eso incluye OpenAI, Anthropic, Mistral, Google Gemini, Cohere, Hugging Face, AWS Bedrock, Azure OpenAI, Ollama y modelos custom enterprise

- Rendimiento: latencia agregada menor a 1 milisegundo. El footprint del gateway es de 122kb — lo podés correr en prácticamente cualquier cosa

- Políticas de uso: límites por modelo, reglas de acceso por equipo, cuotas de gasto

- Métricas en tiempo real: costo por request, latencia, uso de tokens, todo observable desde el momento cero

- Resiliencia: load balancing, reintentos automáticos, fallbacks configurables entre proveedores

- Caché semántico: si dos requests son semánticamente equivalentes, devuelve la respuesta cacheada sin gastar tokens

- Guardrails: más de 50 integrados, incluyendo filtrado de contenido y redacción de PII

- Autenticación: OAuth 2.1 y 2.0 nativos

El soporte multimodal también está: texto, visión, audio, imagen. Todo pasa por el mismo gateway con la misma observabilidad.

MCP Gateway: gobernanza para agentes de IA

Acá viene lo más interesante del anuncio. El MCP Gateway es una capa nueva pensada específicamente para la era de agentes autónomos. MCP es el Model Context Protocol, un estándar que permite que los agentes de IA se conecten con herramientas externas — bases de datos, APIs, servicios internos. El problema es que sin gobernanza, cada agente hace lo que quiere.

¿Qué resuelve el MCP Gateway?

Registro y descubrimiento centralizado

Todos los servidores MCP de tu organización se registran en un solo lugar. Podés descubrir, gestionar y versionar cada servidor MCP desde una interfaz unificada. Cuando tenés 30 equipos usando 150 herramientas distintas, esto deja de ser un nice-to-have.

Autenticación y control de acceso

Una sola capa de autenticación para toda la cadena agente → LLM → herramienta. Control de acceso granular por equipos y usuarios. Si el equipo de marketing puede usar el agente de generación de contenido pero no el de acceso a base de datos de producción, eso se configura acá.

Observabilidad end-to-end

Podés trazar la cadena completa: qué agente llamó a qué modelo, que a su vez usó qué herramienta, con qué parámetros, cuánto costó y cuánto tardó. Para debugging en producción, esto es crítico. Portkey además anunció una asociación con Lasso para agregar seguridad enterprise específica al flujo MCP. Si te interesa, podés leer más sobre modelos open source como Mistral Small 4.

Arquitectura técnica y despliegue

Dos opciones: self-hosted o cloud. Para self-hosted, clonar el repo de GitHub y desplegar. Según los benchmarks de la propia empresa, el setup toma menos de 5 minutos.

Lo piola del diseño es que soporta despliegues híbridos. Ponele que tu equipo usa GPT-4 de OpenAI para tareas generales pero tiene un modelo fine-tuneado corriendo en Ollama para casos específicos. Ambos pasan por el mismo gateway, con las mismas métricas, los mismos guardrails, las mismas políticas. No necesitás dos stacks separados.

El gateway corre en 90+ regiones a nivel global. Para equipos que necesitan compliance con residencia de datos, eso importa.

Portkey vs LiteLLM vs Helicone: comparativa de gateways IA open source

Portkey no es el único gateway open source. Veamos cómo se compara con las alternativas principales.

| Criterio | Portkey Gateway | LiteLLM | Helicone |

|---|---|---|---|

| Modelos soportados | 200+ LLMs, 1.600+ modelos | 100+ LLMs | Proxy compatible OpenAI |

| Latencia agregada | <1ms | ~3-5ms | <1ms (Rust) |

| Guardrails integrados | 50+ | Básicos | Limitados |

| MCP Gateway | Sí (nativo) | No | No |

| Caché semántico | Sí | Sí | Sí |

| Observabilidad | Completa (nativa) | Callbacks | Completa (nativa) |

| Setup inicial | <5 min | 15-30 min (YAML) | ~10 min |

| Gobernanza enterprise | Completa (open source) | Básica | Parcial |

| Footprint | 122kb | Variable | Ligero (Rust) |

| Precio | Gratis (open source) | Gratis (open source) | Freemium |

Ojo con LiteLLM: en marzo de 2026 sufrió un ataque de supply chain donde las versiones 1.82.7 y 1.82.8 del paquete fueron comprometidas con malware. Si lo estás usando, verificá que tu versión sea posterior a esas y que la hayas descargado de una fuente limpia. Esto no invalida el proyecto, pero sí muestra los riesgos de dependencias en infraestructura crítica.

Helicone tiene la ventaja de estar escrito en Rust, lo que le da un rendimiento nativo excelente y load balancing eficiente. Ahora bien, no tiene nada parecido al MCP Gateway de Portkey, y su modelo de gobernanza es más limitado. Si te interesa, podés leer más sobre nuestra guía de herramientas para IA.

También están Kong AI Gateway (enterprise, integrado con su API gateway existente) y OpenRouter (que agrega un 5% de markup sobre los costos de los proveedores). Cada uno tiene su nicho.

Casos de uso reales y escala de producción

Los números de Portkey no son teóricos. Hay un caso documentado de una plataforma de delivery que opera con más de 1.000 ingenieros, 350+ workspaces y 150+ modelos en producción simultánea. Tráfico distribuido entre Anthropic, OpenAI y Vertex AI, con un uptime reportado de 99.99%.

Los casos de uso van desde detección de fraude hasta automatización de atención al cliente y herramientas internas de productividad. Un patrón que se repite: equipos que arrancan usando un solo proveedor de LLM, escalan, necesitan fallbacks y control de costos, y terminan necesitando un gateway. Es más barato ponerlo desde el principio.

El caché semántico tiene un impacto directo en costos de testing. Si corrés una suite de tests que hace 500 llamadas a la API de OpenAI, y 300 de esas llamadas son semánticamente idénticas a las del run anterior, el gateway las resuelve desde caché. Eso se traduce en plata.

Qué significa para equipos de desarrollo en Latinoamérica

Para un equipo de IA en Argentina, Colombia o México, tener acceso gratuito a infraestructura de este nivel cambia las cuentas. Antes, si querías gobernanza enterprise sobre tu gasto en APIs de IA, pagabas un SaaS o lo armabas a mano. Ahora podés self-hostear Portkey Gateway en un VPS de donweb.com o en cualquier cloud y tener las mismas herramientas que usan empresas con presupuestos de millones.

El control de costos es particularmente relevante. Cuando tu startup está gastando $2.000 o $5.000 por mes en APIs de OpenAI y Anthropic, cada dólar importa. Poder poner límites por equipo, cachear respuestas y tener visibilidad real de qué modelo conviene para cada tarea no es un lujo — es supervivencia. Si te interesa, podés leer más sobre comparativa de seguridad en plataformas de código.

Cómo empezar: cloná el repo desde GitHub, configurá tus proveedores de LLM como variables de entorno, y desplegá. En menos de 5 minutos tenés el gateway corriendo.

Errores comunes

Llamar a la API del proveedor directamente desde cada microservicio

Cuando tenés 10 servicios llamando a OpenAI por su cuenta, perdés toda visibilidad centralizada. No sabés cuánto gasta cada uno, no tenés fallbacks compartidos, y si OpenAI tiene una caída, se te caen los 10. Un gateway centralizado resuelve esto desde el día uno.

No configurar límites de gasto antes de ir a producción

Un bug en un loop que hace llamadas a GPT-4 puede generarte una factura de miles de dólares en horas. Portkey permite setear cuotas por modelo, por equipo y por período. Configuralo antes de que pase, no después.

Asumir que open source significa que no hay soporte

Portkey sigue ofreciendo soporte enterprise pago y una versión cloud gestionada. Que el gateway sea open source no significa que estés solo. Dicho esto, la documentación y la comunidad en GitHub son lo suficientemente activas como para resolver la mayoría de los problemas sin contrato. Si te interesa, podés leer más sobre la competencia entre Nvidia y OpenAI.

Esto se conecta con Portkey libera su Gateway de IA como open source: procesa 1 , donde cubrimos el tema en detalle.

Esto se vincula directamente con nuestro artículo sobre Portkey libera su Gateway de IA como open source: procesa 1.

Podés leer más al respecto en Portkey libera su Gateway de IA como open source: procesa 1.

Esto conecta directamente con Portkey libera su Gateway de IA como open source: procesa 1 , que abordamos en profundidad.

Si querés profundizar en esto, tenemos Portkey libera su Gateway de IA como open source: procesa 1.

Si querés profundizar en esto, tenemos un artículo detallado sobre Portkey libera su Gateway de IA como open source: procesa 1.

Preguntas Frecuentes

¿Es realmente gratis Portkey Gateway ahora que es open source?

Sí, el gateway completo incluyendo gobernanza, observabilidad y control de costos es gratuito para self-hosting. Portkey sigue ofreciendo una versión cloud gestionada de pago para quienes prefieren no administrar la infraestructura, pero todas las funcionalidades del gateway están disponibles sin costo en el repositorio de GitHub.

¿Qué diferencia hay entre Portkey Gateway y LiteLLM?

Portkey incluye gobernanza enterprise completa, MCP Gateway para agentes y más de 50 guardrails integrados de fábrica. LiteLLM ofrece mayor personalización pero requiere más configuración manual (15-30 minutos de YAML vs menos de 5 minutos). Además, LiteLLM sufrió un ataque de supply chain en marzo de 2026 que comprometió dos versiones del paquete.

¿Cómo funciona el MCP Gateway para gestionar agentes de IA?

El MCP Gateway actúa como punto central de registro, autenticación y observabilidad para todos los servidores MCP de una organización. Cada vez que un agente de IA interactúa con una herramienta externa, esa interacción pasa por el MCP Gateway, donde se aplican políticas de acceso, se registran métricas y se ejecutan guardrails como redacción de PII o filtrado de contenido.

¿Qué proveedores de LLM soporta Portkey Gateway?

Soporta más de 200 proveedores y 1.600 modelos. Entre los principales: OpenAI, Anthropic, Google Gemini, Mistral, Cohere, Hugging Face, AWS Bedrock, Azure OpenAI y Ollama. También permite integrar modelos custom enterprise y despliegues locales bajo el mismo gateway.

Conclusión

Portkey acaba de subir la vara para lo que se espera de un gateway de IA open source. Que una empresa con $15M de funding y un negocio SaaS funcional decida abrir toda su infraestructura enterprise, incluyendo el MCP Gateway para agentes, es una señal clara de hacia dónde va el mercado: la capa de infraestructura se comoditiza y el valor se mueve hacia arriba, hacia la orquestación y la gobernanza de agentes.

Si estás construyendo con LLMs en producción y todavía no tenés un gateway centralizado, este es un buen momento para implementar uno. El repo está en GitHub, el setup toma minutos, y el costo es cero.